Excel w SEO pełni przede wszystkim rolę narzędzia do porządkowania informacji i sprawnego wyciągania wniosków z rozbudowanych zestawień. Najlepiej działa wtedy, gdy trzeba złożyć w jeden roboczy widok eksport z Google Search Console, dane z crawla, listę adresów URL, meta dane oraz informacje techniczne. W takim układzie szybciej widać, które podstrony mają ruch, ale wymagają optymalizacji, gdzie pojawiają się duplikaty oraz które kwestie najsilniej wpływają na wynik. Największą wartość daje nie sama formuła, ale dobrze zaprojektowany arkusz z jednym spójnym identyfikatorem rekordu, zwykle pełnym URL. To właśnie ten porządek przesądza, czy analiza wskaże realny problem, czy jedynie ujawni bałagan w danych. W praktyce Excel skraca drogę od surowych eksportów do listy konkretnych działań.

Jak Excel wspiera SEO w praktyce

W praktyce Excel wspiera SEO przez łączenie danych z wielu źródeł, ich czyszczenie oraz przekładanie wyników na listę decyzji do wdrożenia. Najczęściej pracuje się na eksportach z Google Search Console, crawlera, CMS, analityki oraz na wewnętrznych listach URL. Każde z tych źródeł pokazuje inny wycinek sytuacji, a dopiero zestawienie ich w jednym miejscu daje pełniejszy obraz. To pozwala wychwycić na przykład strony z ruchem i słabym CTR, błędne canonicale na stronach indeksowalnych albo podstrony bez sensownego tytułu.

Podstawową jednostką pracy pozostaje zwykle adres URL albo znormalizowana ścieżka. To po niej spina się kliknięcia, wyświetlenia, statusy odpowiedzi, meta dane, H1, informacje o indeksowalności oraz linkowaniu wewnętrznym. Jeśli identyfikator rekordu nie jest spójny, wyniki łączenia będą fałszywe, nawet gdy formuła działa poprawnie. W SEO ten błąd pojawia się często przez różnice między http i https, końcowy slash, parametry, wielkość liter albo subdomenę.

Excel bywa szczególnie przydatny tam, gdzie nie ma jeszcze potrzeby budowania pełnego dashboardu BI, a jednocześnie trzeba szybko znaleźć wzorce w dużej tabeli. W kilka kroków da się odfiltrować strony 404 z linkami wewnętrznymi, policzyć liczbę stron bez H1 w konkretnym katalogu albo sprawdzić, które adresy generują wyświetlenia, lecz nie mają dopasowanej treści. Taki tryb pracy skraca dystans między analizą a rekomendacją. Zamiast ręcznie przekopywać dane, budujesz prosty model, który sam grupuje problemy.

W praktyce końcowym efektem pracy w Excelu nie jest sam arkusz, tylko uporządkowany wynik. Może to być mapa przekierowań, lista URL do poprawy, arkusz kanibalizacji, mapowanie fraz do stron albo backlog z priorytetami. Dobrze przygotowany plik powinien prowadzić do decyzji: co poprawić, gdzie, w jakiej kolejności i na podstawie jakich danych. To odróżnia użyteczny arkusz SEO od zbioru przypadkowych eksportów.

Aktualne narzędzia i techniki w Excelu dla SEO

W Excelu w pracy SEO najczęściej wygrywają Power Query, tabele Excela, filtrowanie, formatowanie warunkowe oraz nowsze formuły do łączenia i segmentowania danych. To one na co dzień przynoszą największą oszczędność czasu. Umożliwiają przygotowanie pliku, który można odświeżać i rozbudowywać bez ręcznego przeklejania danych po każdym kolejnym eksporcie. W SEO ma to spore znaczenie, bo te same zestawy analiz wracają regularnie.

Power Query najlepiej wykorzystać do importu i wstępnego porządkowania danych, zanim trafią do głównego arkusza. Da się tam ujednolicić nazwy kolumn, wyrzucić puste rekordy, ustawić typy danych, przyciąć spacje i przygotować wspólny format URL. Jest to szczególnie istotne przy CSV, gdzie separator, kodowanie albo format daty potrafią wywrócić analizę do góry nogami. Jeśli plik zaczyna ważyć za dużo, czyszczenie i transformacje lepiej przenieść do Power Query, zamiast dokładać kolejne formuły w arkuszu.

Do łączenia źródeł w praktyce najwygodniejsze są dziś XLOOKUP, a w bardziej klasycznym podejściu INDEX z MATCH. Takie formuły pomagają przenosić metryki i atrybuty między tabelami, na przykład kliknięcia z GSC do listy adresów z crawla albo status HTTP do mapy przekierowań. Dobrą praktyką jest też dodanie obsługi błędów, żeby brak dopasowania nie rozjeżdżał dalszych wyliczeń. Warto przy tym pamiętać, że pusty wynik nie zawsze oznacza brak danych, często chodzi po prostu o niespójny format URL.

Współczesny Excel dobrze radzi sobie również z segmentacją i agregacją. Funkcje takie jak TEXTBEFORE, TEXTAFTER, LEFT, MID czy SUBSTITUTE ułatwiają wydzielenie katalogu, parametru albo typu strony z adresu URL, a UNIQUE, FILTER, SORT, SUMIFS i COUNTIFS pozwalają szybko budować widoki robocze. Dzięki temu w kilka minut można policzyć skalę problemu w konkretnym katalogu albo rozdzielić brand od non-brand. Najlepszy efekt daje praca na tabelach Excela, bo zakresy rosną automatycznie wraz z nowym importem i nie trzeba stale poprawiać odwołań.

W takim podejściu ważna jest także architektura pliku. Dane surowe, transformacje i końcowy wynik warto rozdzielić na osobne warstwy, aby nie mieszać źródła z interpretacją. Ułatwia to kontrolę jakości, przyspiesza aktualizacje i ogranicza ryzyko, że ktoś nadpisze import ręczną poprawką. W SEO, gdzie dane bywają niepełne albo przychodzą z opóźnieniem, taki podział pomaga utrzymać porządek i jasno oddzielić fakty od wniosków analitycznych.

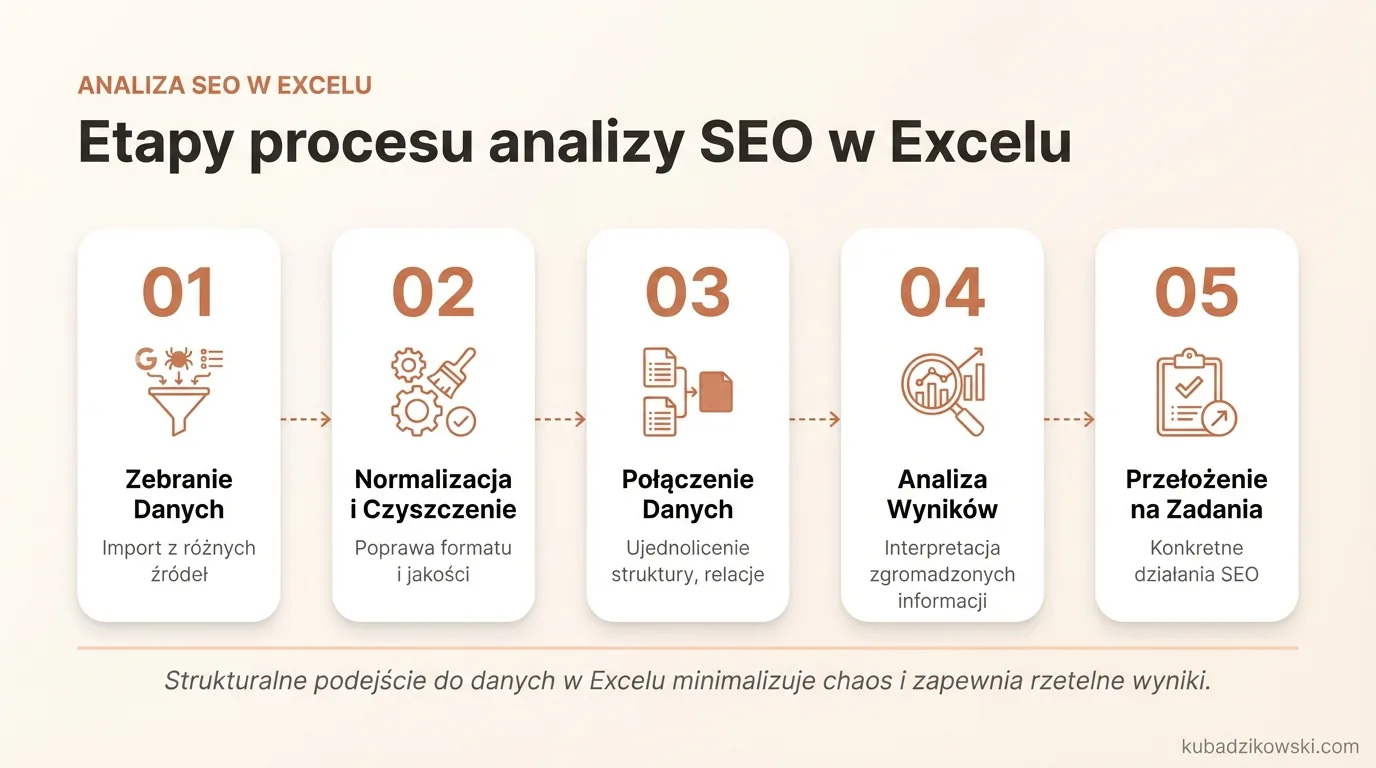

Etapy procesu analizy SEO w Excelu

Proces analizy SEO w Excelu obejmuje zebranie danych, ich normalizację, czyszczenie, połączenie, analizę oraz przełożenie wyników na konkretne zadania. Taka kolejność ogranicza chaos, który zwykle pojawia się wtedy, gdy od razu zaczyna się filtrować i liczyć na surowych eksportach. W praktyce każdy krok ma własny cel, a dopiero razem składają się na wynik, któremu można zaufać.

Pierwszy etap obejmuje import danych z odrębnych źródeł, zwykle z Google Search Console, crawla, CMS, listy URL oraz eksportów technicznych. Już na tym kroku warto dopilnować separatora CSV, kodowania znaków i formatu daty, bo niepoprawny import potrafi zepsuć późniejsze dopasowania. Sprawdza się zasada, by każde źródło trzymać w osobnej tabeli, bez ręcznego mieszania rekordów.

Drugi etap to ujednolicenie struktury danych. Kluczowe są spójne nazwy kolumn, właściwe typy danych oraz jednolity format adresów URL. Najczęstszy realny problem nie wynika z SEO, tylko z tego, że ten sam URL występuje w kilku wariantach: z innym protokołem, subdomeną, końcowym slashem albo parametrami.

Trzeci etap dotyczy czyszczenia i wzbogacania danych. Usuwa się duplikaty, puste rekordy, nadmiarowe spacje i znaki ukryte, a następnie dodaje kolumny pomocnicze, takie jak katalog, typ strony, głębokość URL czy informacja o obecności parametrów. Jeśli nie masz stabilnego identyfikatora rekordu, najlepiej pełnego URL albo znormalizowanej ścieżki, dalsze łączenie danych będzie zawodne.

Czwarty etap to połączenie źródeł i właściwa analiza. Na tym etapie zestawia się metryki widoczności z danymi technicznymi i treściowymi, aby namierzyć konkretne problemy. Wtedy wychodzą na jaw na przykład strony z kliknięciami, ale słabym title, adresy indeksowalne z błędnym canonical albo grupy fraz, którym nie przypisano strony docelowej.

Piąty etap to decyzja, czyli przełożenie analizy na priorytety. Nie każda nieprawidłowość ma tę samą wagę, dlatego dobrze jest oceniać problemy pod kątem wpływu biznesowego, skali, łatwości wdrożenia oraz zależności technicznych. Dobra analiza SEO w Excelu nie kończy się na wykryciu błędu, tylko na przygotowaniu backlogu działań, który da się wdrożyć.

Ostatni etap polega na podaniu wyników w czytelnej formie. Zamiast zostawiać zespół z rozbudowaną tabelą, lepiej przygotować osobne arkusze wynikowe: listę URL do poprawy, mapę przekierowań, arkusz priorytetów albo checklistę wdrożeniową. To ten moment przesądza, czy analiza będzie użyteczna operacyjnie.

Budowanie efektywnych szablonów w Excelu

Efektywne szablony w Excelu to takie, które można cyklicznie uzupełniać nowym eksportem bez przebudowy całego pliku. Ich rolą nie jest wyłącznie to, by „ładnie wyglądać”, lecz by przyspieszać powtarzalne analizy i ograniczać liczbę błędów wynikających z ręcznej pracy. Najlepiej sprawdzają się szablony o prostym układzie: dane surowe, warstwa transformacji oraz arkusz wynikowy.

W praktyce najczęściej wykorzystuje się cztery typy szablonów: audyt URL, mapę przekierowań, keyword mapping oraz analizę kanibalizacji. Każdy z nich powinien mieć jednoznacznie zdefiniowany rekord główny, na przykład jeden URL albo jedną frazę w wierszu. Najważniejsza decyzja projektowa to oddzielenie źródła danych od interpretacji, bo tylko wtedy można bezpiecznie odświeżać plik.

Szablon audytu URL powinien gromadzić w jednym miejscu najważniejsze parametry podstrony: adres, status kodu, canonical, robots, indeksowalność, title, H1, kliknięcia oraz kategorię problemu. Taki układ ułatwia szybkie filtrowanie według konkretnych kryteriów i ocenę realnej skali błędów. Dobrą praktyką jest również kolumna z priorytetem, która od razu porządkuje listę zadań dla zespołu.

Szablon mapy przekierowań powinien pozostać prosty i bez dwuznaczności. Kluczowe kolumny to stary URL, nowy URL, typ zmiany, powód, status wdrożenia oraz miejsce na walidację po publikacji. W tym arkuszu nie ma sensu rozbudowywać logiki na siłę, ponieważ najczęstsze pomyłki wynikają z błędnego dopasowania adresów, a nie z braku dodatkowych wskaźników.

W szablonie keyword mapping najważniejsze jest spójne powiązanie frazy z intencją oraz właściwym adresem URL. Tabela powinna pokazywać nie tylko przypisany adres, ale także obecną pozycję, lukę treści i decyzję redakcyjną, na przykład czy rozbudować stronę, stworzyć nową czy scalić temat z istniejącą treścią. Taki układ porządkuje pracę contentową i ogranicza ryzyko kanibalizacji.

Jeśli chodzi o formuły, najlepiej sprawdzają się rozwiązania, które da się bezproblemowo utrzymać przy większym wolumenie danych. Do łączenia rekordów najczęściej wykorzystuje się XLOOKUP albo INDEX z MATCH, do obsługi braków IFERROR, a do segmentacji adresów funkcje takie jak TEXTBEFORE, TEXTAFTER, LEFT czy MID. Do agregacji problemów i budowy widoków roboczych przydają się SUMIFS, COUNTIFS, FILTER, UNIQUE i SORT.

Wszystkie kluczowe zakresy warto zamienić na tabele Excela, bo wtedy formuły, filtry i zakresy rozszerzają się automatycznie wraz z kolejnym importem. To drobna korekta, a wyraźnie poprawia stabilność pliku. Dzięki temu szablon nie rozsypuje się po dopisaniu nowych wierszy.

Warto też rozpoznawać moment, w którym nie opłaca się dalej rozbudowywać arkusza. Gdy plik robi się ciężki, długo się odświeża albo zawiera wiele pośrednich obliczeń, część transformacji lepiej przenieść do Power Query. Im więcej czyszczenia wykonasz przed warstwą analityczną, tym mniej błędów i spowolnień pojawi się w głównym arkuszu.

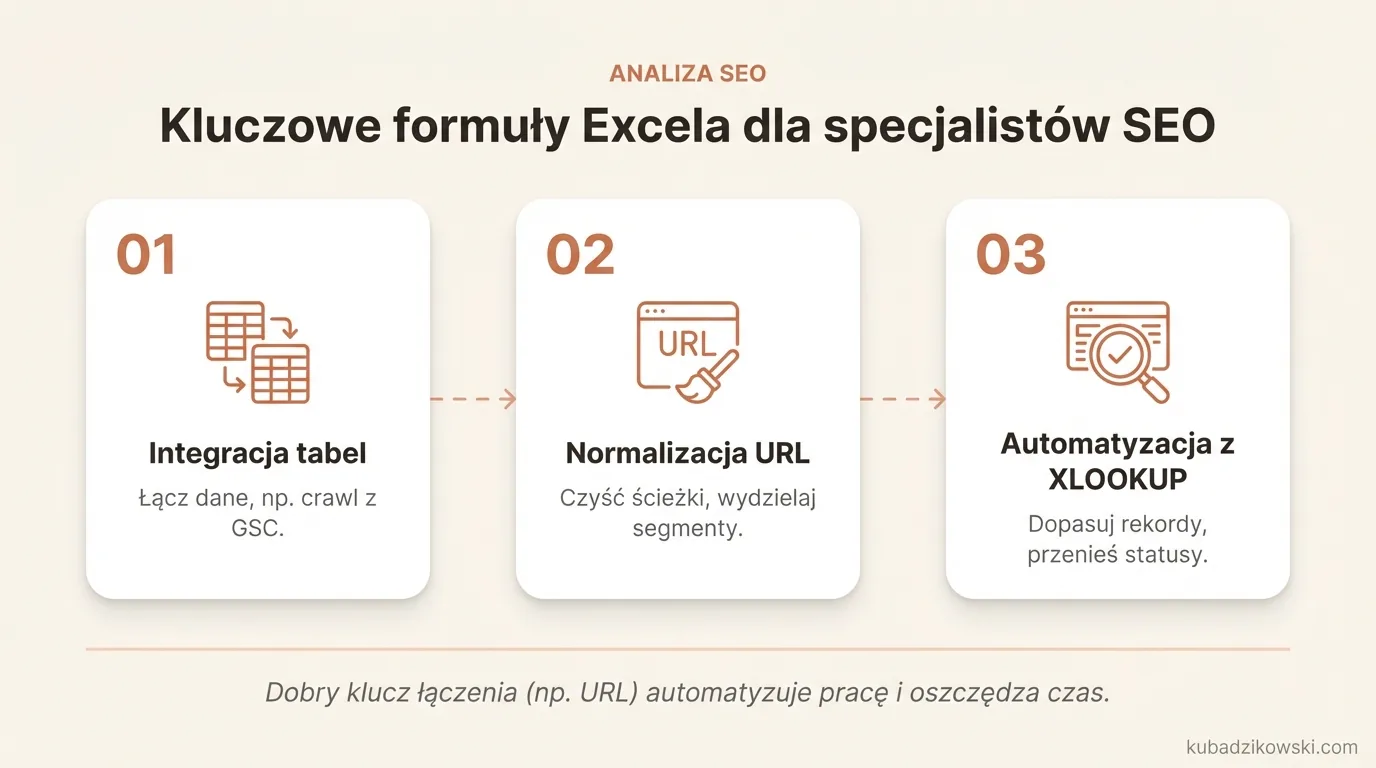

Kluczowe formuły Excela dla specjalistów SEO

W SEO najczęściej przydają się formuły, które pozwalają łączyć dane z wielu źródeł, czyścić adresy URL, wydzielać segmenty i policzyć skalę problemu. W praktyce pracuje się równolegle na kilku tabelach, dlatego największą oszczędność czasu dają dopasowania rekordów oraz automatyczne filtrowanie wyników. Jeśli masz dobrze przygotowany klucz łączenia, zwykle pełny URL albo znormalizowaną ścieżkę, duża część pracy analitycznej staje się wyraźnie prostsza.

Do łączenia danych najczęściej wybiera się XLOOKUP albo duet INDEX z MATCH. XLOOKUP łatwiej później utrzymać, bo nie trzeba wyliczać numeru kolumny, a w razie braku dopasowania bez problemu zwraca wartość domyślną. W SEO przydaje się między innymi do przeniesienia statusu kodu z crawla do tabeli z GSC, dopisania canonical do listy URL albo spięcia metadanych z wynikami widoczności.

Warto od razu osłaniać takie formuły przez IFERROR, żeby pojedynczy brak dopasowania nie rozjechał dalszej analizy. Brak wyniku nie zawsze oznacza błąd w danych źródłowych. Nierzadko chodzi o to, że URL występuje w innym wariancie, na przykład z ukośnikiem na końcu, parametrem albo inną wielkością liter.

Do czyszczenia tekstu i URL-i najpraktyczniejsze bywają TRIM, CLEAN, SUBSTITUTE, LOWER i UPPER. TRIM usuwa nadmiarowe spacje, CLEAN eliminuje znaki ukryte, SUBSTITUTE podmienia niechciane fragmenty, a LOWER ujednolica zapis do małych liter. To proste formuły, ale często przesądzają o tym, czy dopasowanie zadziała prawidłowo.

Przy pracy na adresach URL dobrze sprawdzają się też TEXTBEFORE, TEXTAFTER i TEXTSPLIT. Pozwalają szybko oddzielić domenę od ścieżki, uciąć parametry po znaku zapytania albo wyciągnąć katalogi do segmentacji. To wygodny sposób na zbudowanie kolumn pomocniczych, takich jak katalog główny, głębokość URL, obecność parametrów czy identyfikacja podstron filtrów.

Do wykrywania cech strony przydatne są również LEFT, RIGHT, MID, LEN, SEARCH i FIND. LEN pozwala policzyć długość title lub H1, a SEARCH ułatwia sprawdzenie, czy w adresie albo tytule występuje wskazany fragment. Na tej podstawie da się oznaczać strony brandowe i non-brandowe, wykrywać paginację, sortowania, wersje filtrowane albo konkretne wzorce adresów.

W analizie skali problemu najczęściej korzysta się z SUMIFS, COUNTIFS i AVERAGEIFS. COUNTIFS policzy liczbę indeksowalnych stron bez H1 albo liczbę URL-i z kodem 404 w danym katalogu. SUMIFS pozwoli zsumować kliknięcia dla stron z określonym problemem, a AVERAGEIFS wyliczy średnią pozycję wyłącznie dla wybranego typu podstron. To istotne, bo w SEO liczy się nie tylko liczba błędów, ale też to, jakiego ruchu i których sekcji serwisu dotyczą.

Nowoczesny Excel oferuje też przydatne formuły dynamiczne: UNIQUE, FILTER i SORT. UNIQUE szybko usuwa logiczne duplikaty bez ręcznego kopiowania, FILTER buduje roboczy widok tylko dla spełnionych warunków, a SORT porządkuje wynik bez naruszania danych źródłowych. To szczególnie wygodne przy przygotowaniu listy stron do poprawy, mapy przekierowań albo shortlisty fraz do mapowania.

Najlepszy efekt daje stosowanie tych formuł na tabelach Excela, a nie na sztywnych zakresach komórek. Dzięki temu zakresy powiększają się automatycznie po kolejnym imporcie i nie trzeba ręcznie poprawiać każdej formuły. Jeśli szablon ma działać cyklicznie, formuła powinna być odporna na dopisywanie nowych wierszy.

- XLOOKUP / INDEX+MATCH — łączenie eksportów po URL lub innym identyfikatorze.

- IFERROR — bezpieczne przechwytywanie braków dopasowania oraz pustych rezultatów.

- TRIM, CLEAN, SUBSTITUTE, LOWER — porządkowanie i ujednolicanie tekstu.

- TEXTBEFORE, TEXTAFTER, TEXTSPLIT, LEFT, MID, RIGHT — dzielenie adresów URL i wyciąganie poszczególnych elementów.

- SUMIFS, COUNTIFS, AVERAGEIFS, UNIQUE, FILTER, SORT — agregowanie, filtrowanie oraz budowanie gotowych widoków analitycznych.

Najczęstsze błędy i ograniczenia w użyciu Excela do SEO

Do najczęstszych błędów w pracy z Excelem pod SEO należą łączenie danych po niespójnym URL, analiza na nieoczyszczonych eksportach oraz zestawianie tabel o różnych poziomach agregacji. W praktyce właśnie te trzy kwestie najczęściej skutkują pozornymi brakami dopasowania, błędnymi sumami i chybionymi wnioskami. Arkusz może wyglądać poprawnie, a mimo to prowadzić do nietrafnych decyzji.

Najbardziej kosztowny błąd dotyczy formatu URL. Różnice w protokole, końcowym slashu, subdomenie, wielkości liter, parametrach albo zakodowanych znakach sprawiają, że ten sam adres zostaje potraktowany jako inny rekord. Jeżeli URL nie został znormalizowany przed dopasowaniem, wynik lookupu bywa technicznie poprawny, ale biznesowo fałszywy.

Drugim częstym problemem jest mieszanie danych surowych z interpretacją. Gdy ktoś ręcznie nadpisuje wartości w imporcie albo dopisuje komentarze i decyzje w tej samej tabeli co eksport źródłowy, szybko traci jasny podział na to, co pochodzi z systemu, a co jest efektem analizy. To utrudnia odświeżanie danych i w praktyce uniemożliwia powtarzalną pracę na szablonie.

Często analizę wykolejają też niepoprawne importy CSV. Niewłaściwy separator, złe kodowanie lub błędny format daty sprawiają, że liczby zamieniają się w tekst, polskie znaki się rozjeżdżają, a dat nie da się prawidłowo filtrować ani porównywać. Taki kłopot łatwo przeoczyć, bo arkusz nadal coś wyświetla, ale obliczenia przestają być miarodajne.

Kolejna pułapka to porównywanie danych o różnym poziomie agregacji. Dane z GSC mogą być zagregowane po zapytaniu i URL, crawl po pojedynczym adresie, a raport z CMS po typie strony lub identyfikatorze treści. Jeśli takie źródła połączy się bez wcześniejszego ujednolicenia poziomu analizy, wyniki zaczną się dublować albo będą sztucznie zawyżone.

Excel ma też ograniczenia wydajnościowe. Przy bardzo dużych zbiorach, szczególnie crawlach, logach i wielu ciężkich formułach, plik zaczyna działać wolno, potrafi się zawieszać albo staje się trudny do przekazania zespołowi. W takim momencie rozsądniej jest przenieść czyszczenie oraz część łączeń do Power Query, a przy jeszcze większej skali do narzędzi bazodanowych lub BI.

Problemem bywa również nadmiar ręcznej pracy. Przenoszenie kolumn między arkuszami, ręczne usuwanie duplikatów i poprawianie formuł po każdym eksporcie zabiera dużo czasu i zwiększa ryzyko pomyłek. Dobry arkusz SEO powinien ograniczać ręczne kroki do minimum, bo tylko wtedy nadaje się do regularnego użycia.

Warto też mieć na uwadze, że Excel nie naprawia jakości danych wejściowych. Gdy crawl jest niepełny, dane z GSC przychodzą z opóźnieniem, a eksport z CMS nie zawiera trwałego identyfikatora strony, nawet dopracowany szablon nie pozwoli wyciągnąć mocnych wniosków. Arkusz ułatwia wychwytywanie wzorców i porządkowanie informacji, ale nie zastąpi rzetelnego źródła ani rozsądnej interpretacji.

- Niespójny URL wykorzystywany jako klucz do łączenia.

- Mieszanie surowych eksportów z komentarzami oraz decyzjami.

- Nieprawidłowy import CSV i niewłaściwy typ danych.

- Łączenie tabel o odmiennych poziomach agregacji.

- Zbyt duża liczba ciężkich formuł w głównym arkuszu.

- Ręczne operacje, których nie da się łatwo odtworzyć.