ASO, czyli App Store Optimization, wspiera aplikację w budowaniu widoczności w App Store i Google Play oraz w skuteczniejszym zamienianiu odwiedzin karty produktu na instalacje. W praktyce nie sprowadza się to do samego opisu, lecz do dopasowania całego listingu do sposobu, w jaki użytkownik wyszukuje aplikacje i podejmuje decyzję o pobraniu. Dobrze prowadzone ASO porządkuje metadane, wzmacnia komunikat na screenach i zmniejsza rozbieżność między obietnicą marketingową a faktycznym działaniem produktu. Najważniejsze jest to, że ASO działa najlepiej wtedy, gdy listing, produkt i opinie użytkowników są ze sobą spójne. Ma to znaczenie również dlatego, że App Store i Google Play funkcjonują inaczej, więc nie da się efektywnie przenieść jednej wersji opisu i kreacji do obu sklepów. W dalszej części znajdziesz, co realnie wpływa na widoczność aplikacji i od czego zacząć optymalizację.

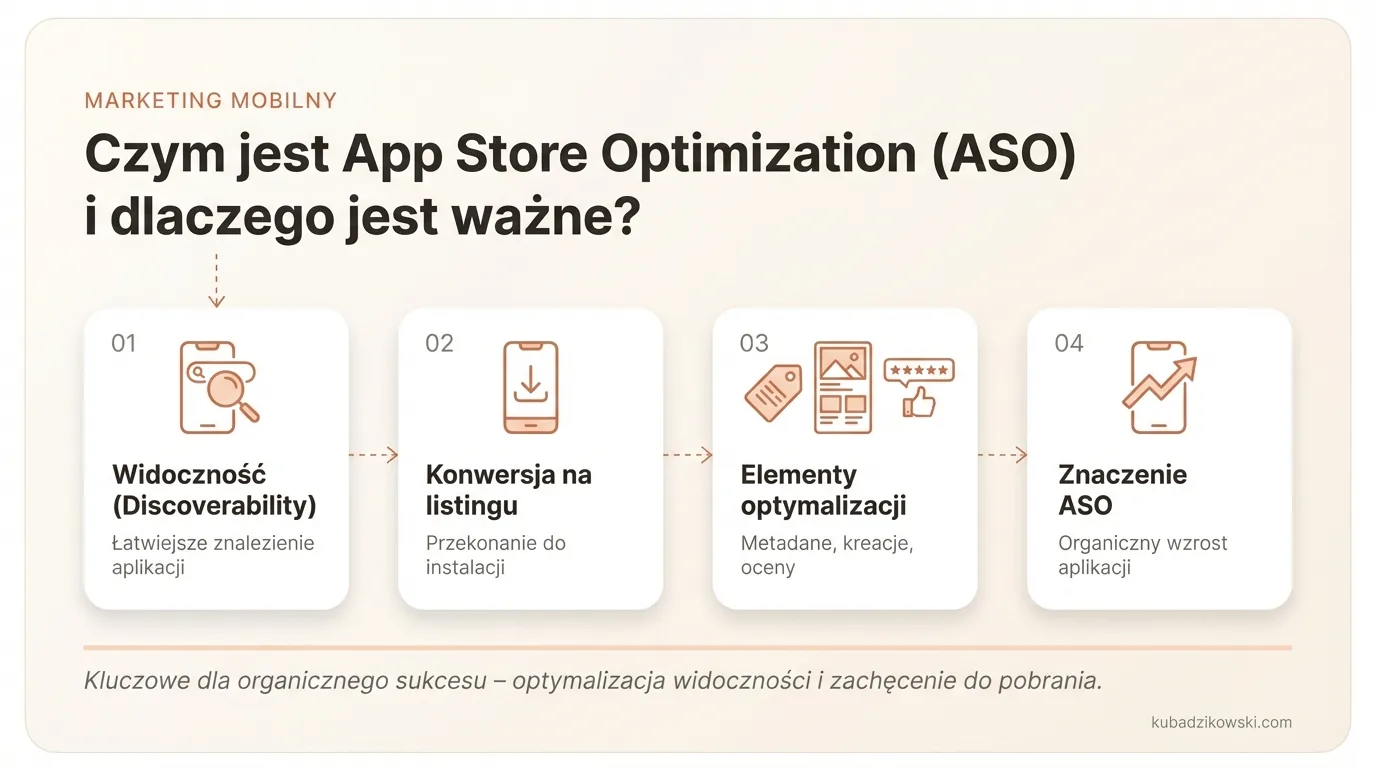

Czym jest App Store Optimization (ASO) i dlaczego jest ważne?

App Store Optimization (ASO) to proces zwiększania widoczności aplikacji w sklepach mobilnych oraz podnoszenia liczby instalacji pozyskiwanych z wejść na kartę produktu. Obejmuje zarówno to, jak łatwo użytkownik trafia na aplikację, jak i to, czy po wejściu na listing faktycznie zdecyduje się ją pobrać. To połączenie pracy nad metadanymi, kreacjami wizualnymi oraz sygnałami jakościowymi, takimi jak oceny, recenzje czy stabilność aplikacji.

W praktyce ASO obejmuje dwa obszary. Pierwszy to discoverability, czyli widoczność w wynikach wyszukiwania i w obrębie sklepu. Drugi to conversion on listing, czyli skuteczność samej karty aplikacji w przekonywaniu użytkownika do instalacji.

ASO ma znaczenie, ponieważ nawet dobra aplikacja nie będzie rosła organicznie, jeśli użytkownicy jej nie znajdują albo w kilka sekund nie rozumieją jej wartości. Sklepy mobilne są przepełnione, a decyzja o instalacji zwykle zapada bardzo szybko. Jeśli aplikacja ma mało wyświetleń, problemem jest widoczność; jeśli ma wejścia na listing, ale mało instalacji, problemem jest konwersja.

To również nie jest działanie na jeden raz. Zmieniają się algorytmy sklepów, sezonowość popytu, funkcje aplikacji oraz język, którym posługują się użytkownicy. ASO trzeba prowadzić jako proces iteracyjny, a nie jako jednorazowe napisanie opisu.

Istotne jest też to, że App Store i Google Play różnią się konstrukcją listingu oraz sposobem indeksowania tekstów. Przekłada się to na strategię słów kluczowych, układ metadanych i priorytety optymalizacji. Skuteczne ASO wymaga osobnej strategii dla każdego sklepu, nawet jeśli aplikacja jest ta sama.

Kluczowe elementy optymalizacji listingu aplikacji

Na optymalizację listingu aplikacji składają się cztery filary: metadane, materiały wizualne, sygnały jakości oraz lokalizacja. Każdy z tych obszarów wspiera inny moment na ścieżce użytkownika: od znalezienia aplikacji, przez kliknięcie wyniku, po szybkie zrozumienie wartości i decyzję o instalacji. Dobrze dopracowany listing nie ogranicza się do doboru fraz, lecz wprost i bez zwłoki pokazuje, dlaczego dana aplikacja może się komuś przydać.

- tytuł aplikacji, podtytuł lub short description oraz pozostałe pola tekstowe

- opis długi i pola słów kluczowych tam, gdzie sklep je udostępnia

- ikona, screeny, podpisy na grafikach oraz ewentualne preview video

- kategoria, teksty promocyjne i spójność przekazu z faktyczną funkcją aplikacji

- oceny, recenzje, stabilność działania oraz jakość pierwszego doświadczenia po instalacji

- lokalizacje językowe dopasowane do konkretnych krajów i nawyków wyszukiwania

Metadane w największym stopniu decydują o tym, czy aplikacja wyświetli się na trafne zapytania i czy użytkownik od razu zrozumie, do czego służy. Tytuł oraz krótkie pola tekstowe powinny jednocześnie odpowiadać na intencję użytkownika i jasno komunikować korzyść. Zbyt nachalne upychanie słów kluczowych zwykle obniża czytelność i rzadko przekłada się na lepszą konwersję.

Kreacje wizualne mają kluczowe znaczenie na etapie po wejściu na listing. Ikona ustawia pierwsze wrażenie, a pierwsze screeny powinny w kilka sekund pokazać problem, sposób jego rozwiązania i najważniejszy use case. Ikona, pierwszy screen i pierwszy komunikat mają największy wpływ na to, czy użytkownik w ogóle rozważy instalację.

Sygnały jakości bywają pomijane, choć w praktyce mocno wpływają na wynik ASO. Niskie oceny, powracające skargi na błędy, mylący onboarding albo rozjazd między obietnicą na listingu a realnym działaniem aplikacji potrafią osłabić efekty nawet świetnie napisanych metadanych. Jeżeli listing obiecuje więcej niż produkt dowozi, spadają i konwersja, i oceny.

Lokalizacja to znacznie więcej niż samo tłumaczenie. Użytkownicy w różnych krajach wpisują inne frazy, inaczej reagują na komunikaty i mogą potrzebować odmiennych przykładów użycia na screenach. Dlatego skuteczny listing warto aktualizować po zmianach produktu, przy wejściu na nowy rynek oraz po każdym release, który modyfikuje główną wartość aplikacji.

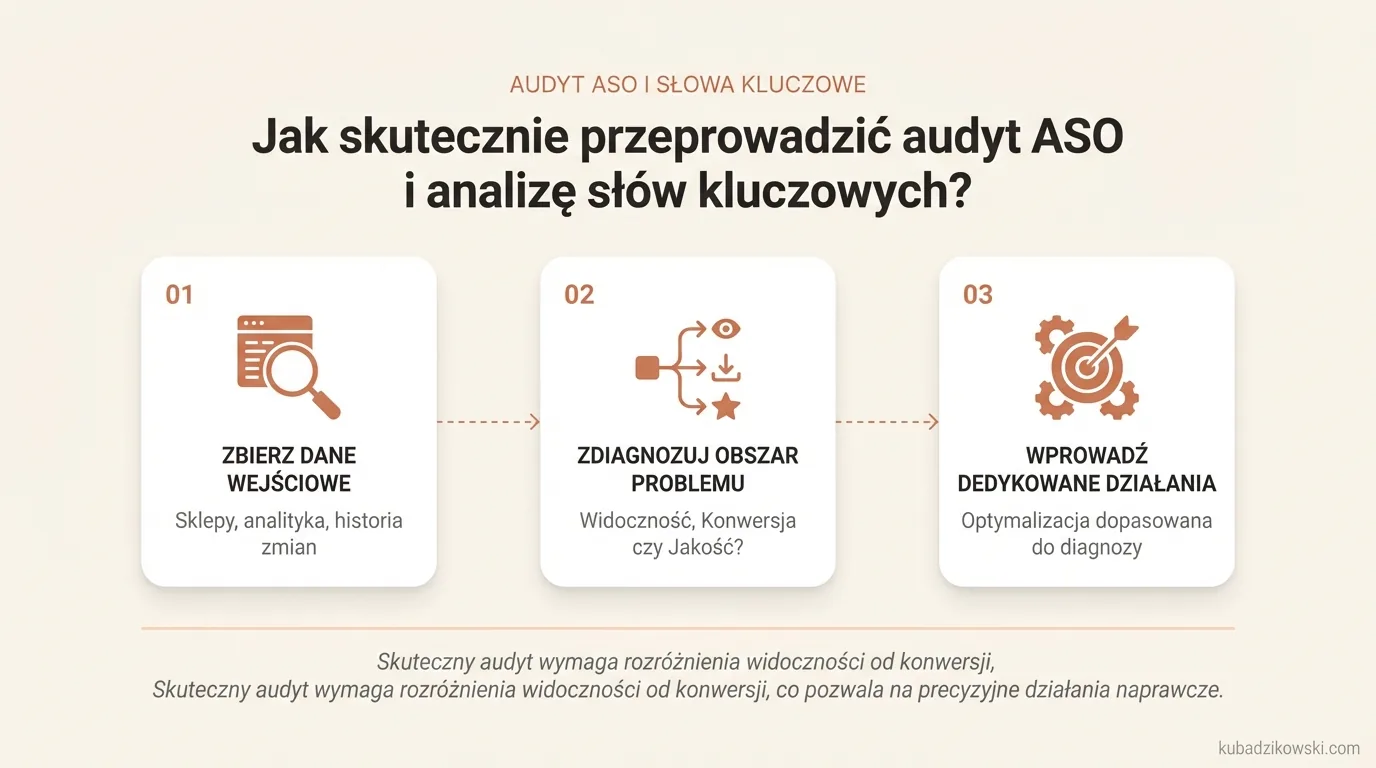

Jak skutecznie przeprowadzić audyt ASO i analizę słów kluczowych?

Dobry audyt ASO zaczyna się od ustalenia, czy problem dotyczy widoczności w sklepie, konwersji na karcie produktu, czy jakości doświadczenia po instalacji. To rozróżnienie ma znaczenie, ponieważ każdy z tych obszarów wymaga innego zestawu działań. Gdy aplikacja notuje mało wyświetleń w wynikach wyszukiwania, należy poprawić dopasowanie fraz i metadanych. Jeżeli użytkownicy wchodzą na listing, ale rzadko instalują, przyczyna najczęściej leży w ikonie, screenach, pierwszym komunikacie albo w rozjeździe między obietnicą a produktem.

Audyt zaczyna się od zebrania danych z obu sklepów, analityki produktu oraz historii zmian w aplikacji. Bez tego łatwo o nietrafne wnioski, na przykład o przypisanie spadku instalacji opisowi, gdy rzeczywisty kłopot wynika z awarii, słabszych ocen albo wprowadzenia nowego paywalla. Dobry audyt nie ogranicza się do oceny tekstu, tylko obejmuje cały ciąg: zapytanie użytkownika, listing, instalację oraz pierwsze doświadczenia w aplikacji.

- aktualne metadane w App Store i Google Play dla wszystkich języków i rynków,

- dane z konsol sklepów: wyświetlenia, wejścia na kartę, współczynnik instalacji, źródła ruchu,

- oceny, recenzje oraz najczęstsze przyczyny negatywnego feedbacku,

- historię aktualizacji, zmiany w funkcjach, modelu płatności i onboardingu,

- listę głównych konkurentów widocznych na te same intencje użytkownika.

Analiza słów kluczowych nie sprowadza się do zebrania jak największej liczby fraz, lecz do wyłonienia tych, które odpowiadają realnym intencjom użytkownika. W praktyce trzeba powiązać frazy z problemami, use case’ami, funkcjami oraz językiem, którym posługują się odbiorcy, a nie zespół produktowy. Najlepsze słowo kluczowe to nie zawsze to o największym wolumenie, tylko to, które jest trafne, zrozumiałe i ma szansę przełożyć się na instalację.

Warto grupować frazy w klastry, bo użytkownicy docierają do aplikacji różnymi ścieżkami. Jedni wpisują nazwę kategorii, inni problem do rozwiązania, jeszcze inni konkretną funkcję albo alternatywę dla znanej aplikacji. Taki podział ułatwia decyzję, które frazy powinny trafić do tytułu, które do krótkiego opisu, a które zostawić do dalszych testów i lokalizacji.

Analiza konkurencji jest potrzebna po to, aby sprawdzić nie tylko, na jakie frazy konkurenci się wyświetlają, ale również jak formułują obietnicę wartości. Nierzadko różnica nie leży w samych słowach, lecz w tym, co aplikacja komunikuje w pierwszych sekundach kontaktu z listingiem. Jeśli konkurencja pokazuje konkretny efekt użycia, a Twoja karta mówi ogólnie o „innowacyjnym rozwiązaniu”, przegrasz nawet przy podobnej widoczności.

Na końcu audytu trzeba ustalić priorytety wdrożenia. Najpierw zmienia się te elementy, które mają największy wpływ na wynik i najłatwiej je potwierdzić w danych. Nie warto poprawiać wszystkiego naraz, bo wtedy trudno ustalić, co faktycznie zadziałało, a co jedynie zbiegło się w czasie z inną zmianą.

Optymalizacja metadanych i kreacji wizualnych w praktyce

Optymalizacja metadanych i kreacji wizualnych w praktyce polega na przypisaniu każdemu elementowi listingu jednej, jasno określonej roli: poprawy indeksowania, zwiększenia wejść na kartę albo podniesienia współczynnika instalacji. Ma to znaczenie, ponieważ tytuł, krótki opis, ikona i screeny nie działają w ten sam sposób. Część elementów ułatwia odnalezienie aplikacji, a część pomaga przekonać użytkownika do pobrania. Najlepsze listingi łączą te funkcje bez rozmywania przekazu.

Metadane warto budować wokół fraz o najwyższym priorytecie oraz kluczowej korzyści dla użytkownika. Tytuł i pola o największym znaczeniu powinny zawierać sformułowania, których ludzie rzeczywiście używają w wyszukiwarce sklepu. Jednocześnie całość musi brzmieć naturalnie, bo upychanie słów kluczowych obniża czytelność i nierzadko psuje konwersję. Jeśli użytkownik nie rozumie w 2-3 sekundach, do czego służy aplikacja, sama widoczność nie wystarczy.

Długi opis ma sens wtedy, gdy porządkuje argumenty, rozwiewa wątpliwości i pomaga podjąć decyzję, zamiast jedynie powielać frazy. Warto jasno pokazać główne zastosowania, istotne funkcje oraz ograniczenia, prosto i konkretnie. To szczególnie ważne w przypadku aplikacji subskrypcyjnych, specjalistycznych albo takich, które łatwo błędnie odczytać na podstawie samej nazwy.

Ikona i pierwsze screeny najczęściej mają największy wpływ na decyzję o wejściu i instalacji. Pierwszy screen nie powinien opowiadać całej historii produktu, tylko od razu pokazać główny use case i obiecaną korzyść. Kolejne grafiki rozwijają przekaz: prezentują funkcje, łatwość użycia, różnice względem alternatyw oraz ewentualne dowody użyteczności. Pierwsze zasoby wizualne powinny sprzedawać efekt dla użytkownika, a nie sam interfejs.

W praktyce najczęstszy błąd to projektowanie screenów jak prezentacji dla inwestora albo dla zespołu wewnętrznego. Użytkownik sklepu nie ma potrzeby oglądać pełnej architektury produktu. Chce wiedzieć, czy aplikacja rozwiązuje jego problem, jak szybko to zrobi i czy jest godna zaufania. Dlatego komunikaty na grafikach powinny być krótkie, rzeczowe i podporządkowane jednemu scenariuszowi użycia.

Preview video potrafi pomóc, ale tylko wtedy, gdy szybko pokazuje wartość i nie rozmywa przekazu. W wielu kategoriach lepiej sprawdza się bardzo czytelna sekwencja screenów niż film, który startuje zbyt wolno albo podkreśla mało istotne detale. Decyzję najlepiej podejmować na podstawie testów, a nie założenia, że wideo zawsze poprawia skuteczność listingu.

Lokalizacja wymaga czegoś więcej niż samo tłumaczenie tekstu. Frazy wpisywane przez użytkowników, przykłady użycia i sposób przedstawiania korzyści różnią się między krajami. To samo dotyczy screenów, podpisów i kolejności argumentów. Skuteczna lokalizacja polega na dopasowaniu komunikatu do lokalnej intencji, a nie na kopiowaniu jednego szablonu na wszystkie rynki.

Po wdrożeniu zmian warto patrzeć nie tylko na pozycje fraz, lecz także na wejścia na kartę, współczynnik instalacji, oceny i reakcje użytkowników po aktualizacji. Zdarza się, że lepsza widoczność nie przekłada się na wzrost instalacji, bo nowy przekaz ściąga mniej trafny ruch. Dlatego optymalizacja listingu to proces cykliczny: zmiana, pomiar, korekta i ponowne dopasowanie do produktu oraz rynku.

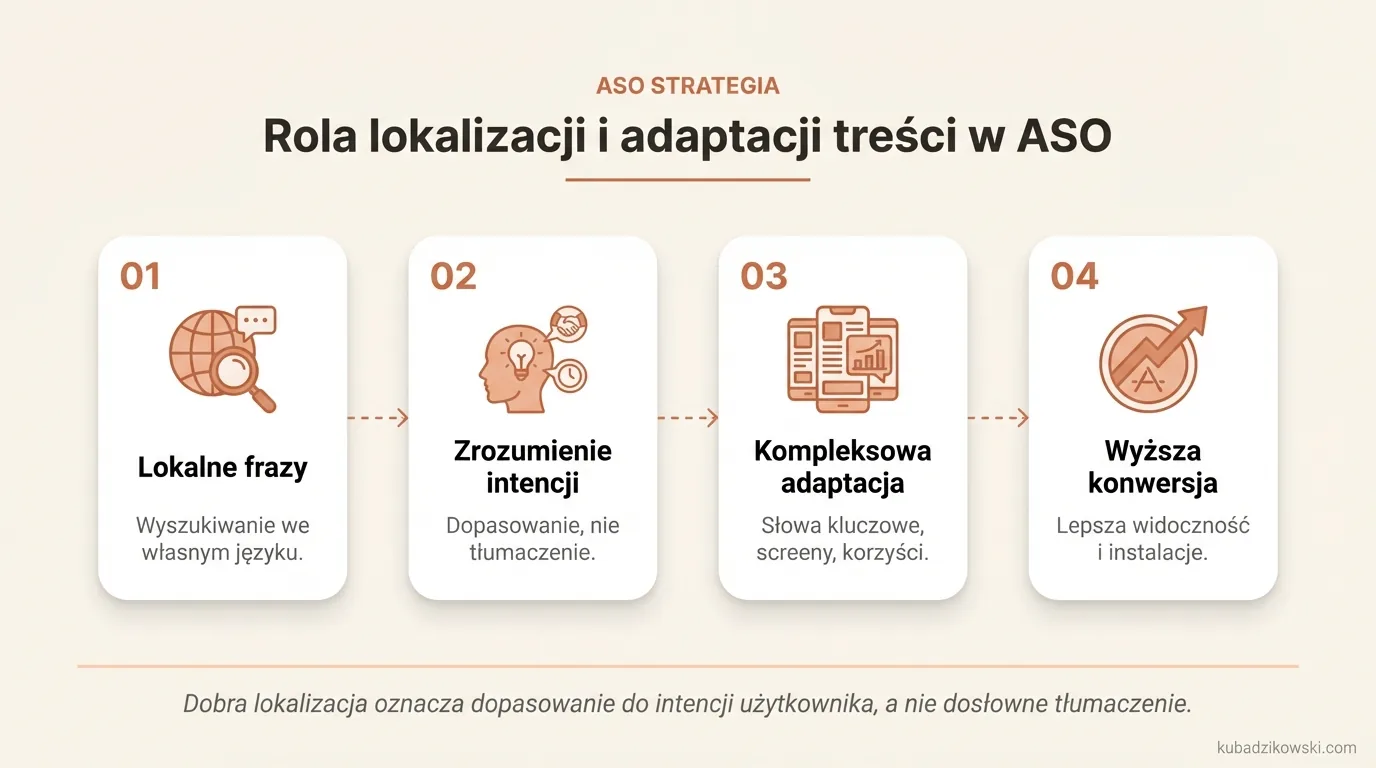

Rola lokalizacji i adaptacji treści w ASO

Lokalizacja i adaptacja treści podnoszą skuteczność ASO, ponieważ użytkownicy wyszukują aplikacje przy użyciu lokalnych fraz i oceniają ofertę przez filtr własnego języka, przyzwyczajeń oraz oczekiwań. Przekłada się to zarówno na widoczność w wynikach, jak i na decyzję o instalacji po wejściu na kartę produktu. Dobra lokalizacja oznacza dopasowanie do intencji użytkownika, a nie dosłowne tłumaczenie. Ten sam produkt może wymagać innych słów kluczowych, odmiennego układu screenów i innego sposobu prezentowania korzyści w zależności od kraju.

W praktyce lokalizacja powinna obejmować nie tylko tytuł, podtytuł i opis, lecz także podpisy na zrzutach ekranu, kolejność komunikatów, przykłady użycia oraz język benefitów. Użytkownik w jednym kraju może mocniej reagować na oszczędność czasu, a w innym bardziej na prostotę albo bezpieczeństwo. Dlatego lepiej nie powielać jednego listingu na wszystkie rynki, ograniczając się wyłącznie do zmiany języka.

Dobrze przeprowadzona adaptacja zaczyna się od wyboru rynków, które mają uzasadnienie biznesowe i dają się obsłużyć operacyjnie. Warto zweryfikować, czy aplikacja jest gotowa językowo oraz czy onboarding, wsparcie, płatności i komunikaty w produkcie nie urywają się na angielskim. W pierwszej kolejności lokalizuj rynki, które jesteś w stanie realnie obsłużyć po instalacji. W przeciwnym razie łatwo o wzrost liczby rozczarowanych użytkowników, słabych ocen i szybkich odinstalowań.

Po wdrożeniu lokalizacji wyniki trzeba analizować oddzielnie dla każdego rynku. W jednym kraju można mieć dobry poziom wyświetleń, ale słabą konwersję z listingu, co zwykle sugeruje problem z kreacjami albo niedopasowaną obietnicą. W innym konwersja może być dobra, lecz widoczność niska, co wskazuje na potrzebę dopracowania fraz i metadanych. W ASO nie lokalizuje się „dla zasady”, tylko po to, aby poprawić konkretne wskaźniki na konkretnym rynku.

Najczęstsze błędy i ograniczenia w procesie ASO

Najczęstsze błędy w ASO biorą się z traktowania go jak jednorazowego opisu aplikacji, zamiast jak procesu opartego na danych, testach i iteracjach w produkcie. Skutkiem są nietrafione decyzje, bo źródło problemu bywa nie w metadanych, lecz w jakości onboardingu, stabilności aplikacji albo w obietnicy z listingu, która rozmija się z rzeczywistością. ASO działa najsłabiej wtedy, gdy ma przykryć problemy produktu zamiast je ujawnić i skorygować.

- Brak osobnej strategii dla App Store i Google Play, mimo że oba sklepy różnią się polami metadanych i sposobem indeksowania.

- Zmiana wielu elementów naraz bez hipotezy, przez co trudno ustalić, co faktycznie poprawiło lub pogorszyło wynik.

- Upychanie tekstów słowami kluczowymi kosztem czytelności i klarownego przekazu wartości aplikacji.

- Zbyt ogólne screeny i pierwszy komunikat, które nie pokazują głównego use case’u ani konkretnej korzyści.

- Brak aktualizacji listingu po release, zmianie modelu płatności albo dodaniu nowej funkcji.

- Pomijanie opinii i ocen użytkowników, mimo że to właśnie tam często widać realne przyczyny spadku konwersji i retencji.

Drugą grupę wyzwań stanowią ograniczenia pomiaru. Dziś nie da się opierać całej oceny na jednym źródle danych, ponieważ sklepy, analityka produktu i systemy atrybucji pokazują odmienne wycinki rzeczywistości. Do tego wyniki potrafią zmieniać się pod wpływem sezonowości, ruchu brandowego, kampanii płatnych, zmian algorytmów sklepów oraz bieżącej jakości samej aplikacji.

To oznacza, że pojedynczy wzrost albo spadek po wdrożeniu nie zawsze daje jednoznaczną odpowiedź. Jeżeli równocześnie zmieniono ikonę, pierwszy screen, opis i onboarding, interpretacja wyniku będzie mało wiarygodna. Najbezpieczniej testować małą liczbę elementów naraz i oceniać trend, a nie jeden odczyt po publikacji.

Warto też uważać na obietnice marketingowe, których produkt nie dowozi. Listing może krótkoterminowo poprawić liczbę wejść lub instalacji, ale jeśli po instalacji użytkownik trafia na inny zakres funkcji, agresywny paywall albo niską stabilność, szybko pojawią się negatywne recenzje i spadek wyników. W praktyce ASO powinno być zsynchronizowane z roadmapą produktu, supportem i planem wydań, bo tylko wtedy efekt utrzymuje się dłużej niż jeden cykl zmian.

Jak mierzyć efektywność działań ASO i co analizować?

Efektywność działań ASO ocenia się przez zmiany w widoczności aplikacji, wejściach na listing oraz instalacjach po wejściu na kartę produktu. Kluczowe jest rozdzielenie dwóch obszarów: czy użytkownicy w ogóle znajdują aplikację oraz czy po wejściu na kartę chcą ją zainstalować. Jeśli nie rozdzielisz problemu widoczności od problemu konwersji, łatwo poprawiać zły element i nie widzieć efektu. W praktyce nie ma jednego wskaźnika, który pokazuje pełny obraz. Trzeba obserwować zestaw metryk i interpretować je w kontekście sklepu, rynku oraz zmian w produkcie.

Podstawą są dane z App Store Connect, Google Play Console i analityki produktu. Konsole sklepów pokazują zwykle wyświetlenia, źródła ruchu, wejścia na kartę aplikacji, współczynnik instalacji oraz oceny i recenzje. Analityka produktu uzupełnia ten obraz o to, co dzieje się po instalacji: aktywację, onboarding, retencję, odinstalowania czy problemy techniczne. ASO nie kończy się na instalacji, bo słaba jakość produktu szybko obniża oceny, a to uderza zarówno w konwersję, jak i widoczność.

- Widoczność: liczba wyświetleń w wynikach wyszukiwania i sekcjach sklepu, pozycje na ważne frazy, udział ruchu brandowego i niebrandowego.

- Zainteresowanie listingiem: CTR z wyników wyszukiwania lub sekcji sklepu do karty aplikacji.

- Konwersja: współczynnik instalacji po wejściu na listing, porównywany między krajami, platformami i wariantami kreacji.

- Sygnały jakości: średnia ocena, dynamika przyrostu recenzji, najczęściej wskazywane źródła negatywnych opinii, crash rate, kłopoty z płatnościami oraz onboardingiem.

- Jakość pozyskanego użytkownika: aktywacja po instalacji, retencja, odinstalowania oraz to, na ile pozyskany ruch pokrywa się z obietnicą z listingu.

Interpretacja wyników zależy przede wszystkim od tego, na którym etapie lejka widać spadek. Jeśli aplikacja ma niewiele wyświetleń, przyczyną są zazwyczaj frazy, metadata, kategoria albo słaba zgodność z intencją użytkownika. Gdy wyświetlenia się pojawiają, ale mało osób przechodzi na kartę, warto przyjrzeć się ikonie, tytułowi, podtytułowi lub short description. Jeżeli wejścia na listing są wysokie, a instalacji jest niewiele, najczęściej rozstrzygają screeny, pierwszy komunikat, oceny, spójność obietnicy oraz realna atrakcyjność produktu.

Dane najlepiej rozpatrywać osobno dla App Store i Google Play, ponieważ oba sklepy funkcjonują odmiennie. Różnią się polami metadata, logiką indeksowania oraz układem elementów widocznych jeszcze przed wejściem na kartę. W efekcie ten sam wzrost lub spadek nie musi wynikać z tej samej przyczyny na obu platformach. Przenoszenie jednej interpretacji na dwa sklepy często kończy się nietrafionymi decyzjami.

Istotny jest również podział na kraje, języki oraz źródła ruchu. Ruch brandowy zwykle konwertuje lepiej niż ruch z ogólnych fraz, dlatego wzrost instalacji nie zawsze oznacza poprawę ASO. Jeżeli w tym samym czasie wystartowała kampania reklamowa, ukazał się artykuł prasowy albo aplikacja dostała ważny release, wyniki w sklepie będą nakładały się na inne czynniki. Dlatego zmiany ASO oceniaj w trendzie i w porównywalnym oknie czasowym, a nie na podstawie pojedynczego odczytu z kilku dni.

W praktyce najlepiej zestawiać wyniki przed i po zmianie jednego konkretnego elementu. Gdy zmienisz jednocześnie tytuł, ikonę, screeny i opis, trudno będzie ustalić, co faktycznie zadziałało. Skuteczniejsze są pojedyncze hipotezy: nowa ikona pod CTR, nowe pierwsze screeny pod konwersję, nowa strategia fraz pod widoczność. Tam, gdzie sklep dopuszcza eksperymenty, warto porównać wariant kontrolny z wersją alternatywną, a następnie ocenić rezultat na podstawie różnic w zachowaniu użytkowników.

Poza liczbami warto cyklicznie zaglądać w treść recenzji. Komentarze użytkowników szybko ujawniają, czy listing obiecuje coś, czego aplikacja nie dowozi, czy onboarding wprowadza w błąd, czy paywall pojawia się zbyt wcześnie albo czy brakuje lokalizacji. To sygnały operacyjne, nie wyłącznie wizerunkowe. Nierzadko to właśnie recenzje wyjaśniają, dlaczego dobra widoczność nie przekłada się na stabilny wzrost instalacji i retencji.

Najbardziej praktyczny model pracy zakłada stały przegląd po każdej większej zmianie w produkcie lub na rynku. Wdrożenie nowej funkcji, korekta cennika, redesign interfejsu, wejście do nowego kraju czy sezonowy wzrost popytu powinny uruchamiać ponowną analizę metryk i aktualizację listingu. W takim ujęciu ASO działa jak proces oparty na danych, a nie jednorazowa korekta opisu. Taki rytm pracy zwykle daje największą szansę na trwałą poprawę widoczności i konwersji.