DevTools to jedno z najskuteczniejszych narzędzi do ręcznej analizy SEO pojedynczego adresu URL, zwłaszcza gdy w standardowym podglądzie strony nie widać od razu, skąd bierze się problem. Umożliwia weryfikację nie tylko tego, co pojawia się na ekranie, lecz także tego, co faktycznie pobiera i interpretuje przeglądarka: HTML, skrypty, zasoby, nagłówki HTTP oraz docelowy DOM po renderowaniu. Dzięki temu da się szybko rozstrzygnąć, czy kłopot dotyczy indeksacji, renderowania, wydajności albo błędu po stronie wdrożenia. W praktyce DevTools służy do potwierdzania przyczyny problemu na konkretnej stronie, a nie do ogólnego „przeglądu SEO” całego serwisu. Ma to szczególne znaczenie przy stronach opartych o JavaScript, CDN, API i komponenty dynamiczne. Dobrze przeprowadzona analiza w DevTools skraca drogę od objawu do konkretnej, technicznej rekomendacji dla dewelopera.

Wprowadzenie do analizy SEO z użyciem DevTools

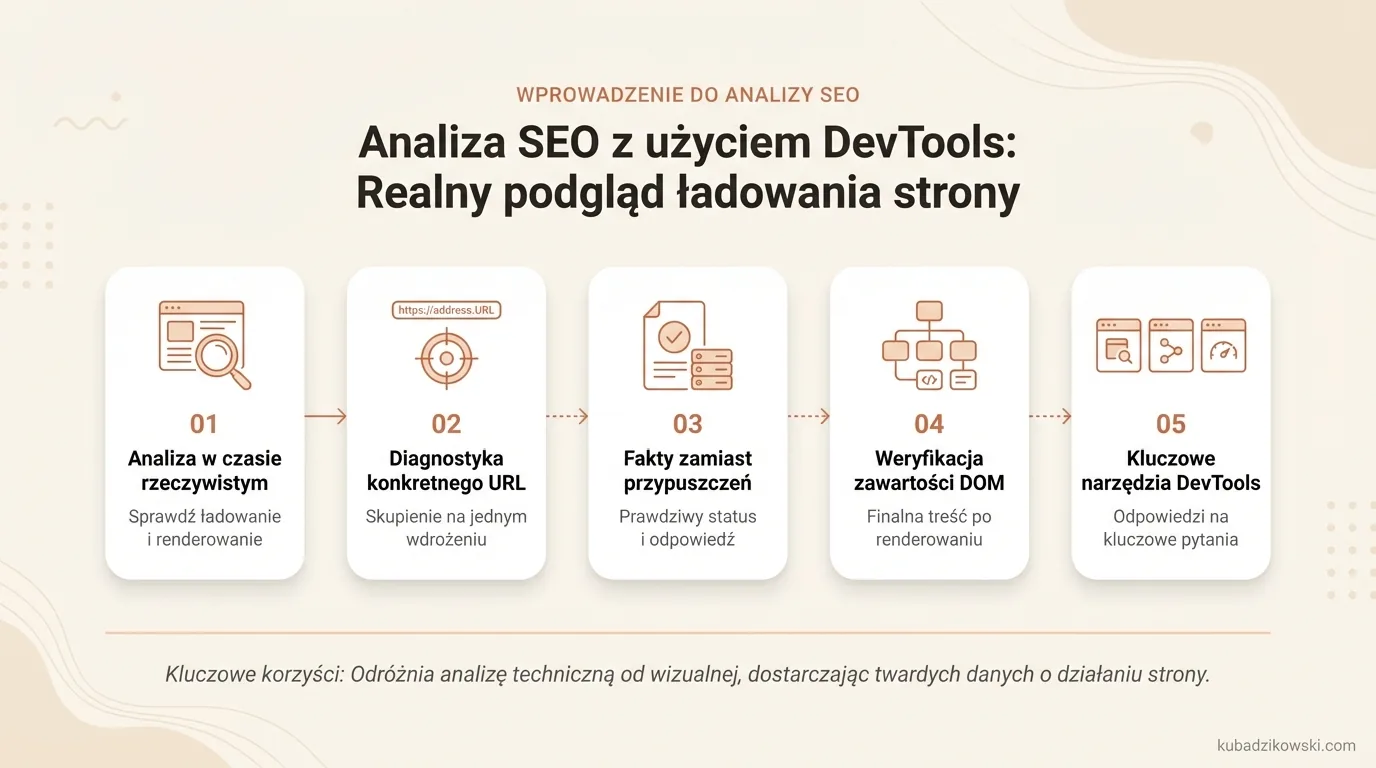

Analiza SEO z użyciem DevTools sprowadza się do sprawdzenia, co dokładnie dzieje się z pojedynczą stroną w trakcie ładowania i renderowania w przeglądarce. To podejście najbardziej opłaca się wtedy, gdy problem dotyczy konkretnego URL, określonego typu podstrony albo jednego wdrożenia, które mogło zmienić sposób działania szablonu. Zamiast opierać się na przypuszczeniach, można podejrzeć realny status dokumentu, odpowiedź serwera, pobierane zasoby i finalną zawartość w DOM. To właśnie odróżnia DevTools od samego oglądania strony „gołym okiem”.

W praktyce SEO najczęściej korzysta się z zakładek Elements, Console, Network, Performance, Lighthouse i Application. Każda z nich odpowiada na inne pytania: czy dokument zwraca poprawny status, czy treść jest obecna w HTML, czy skrypty nie rozbijają renderowania, czy zasoby nie blokują załadowania strony oraz czy cache nie maskuje faktycznego stanu wdrożenia. To pozwala przejść od objawu, na przykład braku treści w indeksie, do konkretnej przyczyny technicznej.

Kluczowe jest to, że DevTools nie zastępuje crawlera ani pełnego audytu witryny. Nie pokaże skali problemu w całym serwisie, ale bardzo precyzyjnie odsłoni mechanizm jego powstawania na poziomie wykonania pojedynczej strony. Gdy crawler sygnalizuje brak tytułów, błędne canonicale albo niedostępne treści, DevTools pomaga ustalić, czy problem występuje już w odpowiedzi HTML, czy pojawia się dopiero po uruchomieniu JavaScript.

Narzędzie jest szczególnie przydatne wtedy, gdy występują rozbieżności między kodem źródłowym a tym, co ostatecznie powstaje po renderowaniu. W takich sytuacjach można wychwycić nadpisywanie meta tagów, opóźnione wstrzykiwanie treści, błędne linkowanie wewnętrzne albo uzależnienie kluczowych elementów od nieudanego requestu do API. Jeśli chcesz zrozumieć, dlaczego strona wygląda poprawnie dla użytkownika, ale działa źle dla SEO, DevTools zwykle daje najszybszą odpowiedź.

Aktualne wyzwania w analizie stron renderowanych JavaScriptem

Dzisiejsze trudności w analizie stron renderowanych JavaScriptem biorą się głównie z tego, że treść widoczna dla użytkownika często nie znajduje się od razu w początkowym HTML. W wielu nowoczesnych wdrożeniach kluczowe elementy strony pojawiają się dopiero po uruchomieniu skryptów, pobraniu danych z API i zakończeniu hydracji interfejsu. Dla SEO oznacza to potrzebę zestawienia dwóch stanów: surowej odpowiedzi serwera oraz finalnego DOM po renderowaniu. Bez takiego porównania łatwo dojść do wniosku, że wszystko działa, choć w praktyce bywa inaczej.

Najczęstszy problem rzadko sprowadza się dziś do braku meta description, częściej wynika z usterek technicznych po stronie wdrożenia. Strona może mieć poprawny szablon, a mimo to zwracać niewłaściwy status HTTP, błędny canonical, blokadę w robots albo treść zależną od requestu, który co jakiś czas kończy się błędem. Z perspektywy SEO szczególnie niebezpieczne są sytuacje, gdy główna treść, linki kategorii lub dane produktowe doczytują się dopiero po chwili. Jeśli element ważny dla SEO zależy od JavaScriptu i zewnętrznego API, trzeba sprawdzić nie tylko czy się pojawia, ale też kiedy oraz w jakich okolicznościach.

Kolejnym wyzwaniem jest rozpoznanie, co faktycznie hamuje renderowanie i odbija się na doświadczeniu użytkownika. Ciężkie skrypty, opóźnione style, zasoby zewnętrzne i długie zadania CPU potrafią sprawić, że główna treść pojawia się zbyt późno, a sekcja above the fold renderuje się w sposób niestabilny. Ma to znaczenie operacyjne nie tylko dla Core Web Vitals, ale również dla realnej dostępności treści i linków w pierwszych sekundach ładowania strony.

W praktyce wyniki analizy takich stron potrafią zostać przekłamane przez cache przeglądarki, service worker, rozszerzenia, testy A/B, personalizację albo geolokalizację. Ten sam URL może zachowywać się inaczej przy pierwszym wejściu niż po kilku odświeżeniach, a starsza wersja zasobów bywa w stanie zamaskować aktualny błąd wdrożenia. Dlatego wiarygodny test warto wykonywać na właściwym środowisku, z wyczyszczonym cache i bez dodatków ingerujących w ładowanie strony. W analizie DevTools bardzo łatwo wyciągnąć błędny wniosek na podstawie dobrego ekranu, jeśli środowisko testowe nie oddaje realnego pierwszego wejścia.

Problem dotyczy także samego linkowania i struktury treści. Część interfejsów frontendowych korzysta z klikalnych kontenerów sterowanych skryptem zamiast prawdziwych linków, a niektóre komponenty dopisują nagłówki, opisy i sekcje dopiero po interakcji użytkownika. Z punktu widzenia SEO trzeba więc zweryfikować, czy kluczowe elementy są dostępne bez kliknięcia, bez scrollowania wymuszanego przez skrypt i bez dodatkowych warunków po stronie przeglądarki.

Krok po kroku: Jak efektywnie używać DevTools do analizy SEO

Aby sprawnie korzystać z DevTools w analizie SEO, zacznij od odtworzenia pierwszego ładowania strony w możliwie kontrolowanych warunkach. Wejdź na właściwy URL, uruchom DevTools, zaznacz Disable cache i wykonaj twarde odświeżenie. W ten sposób obserwujesz faktyczne zachowanie dokumentu oraz zasobów, zamiast wersji podanej z pamięci przeglądarki. Bez wyłączenia cache łatwo przeoczyć błędy, które ujawniają się wyłącznie przy pierwszej wizycie na stronie.

Następnie przejdź do zakładki Network i zweryfikuj sam dokument HTML. Kluczowe są: status HTTP, łańcuch przekierowań, czas odpowiedzi oraz końcowy adres URL. Jeżeli już na tym etapie pojawia się niezamierzone 3xx, błąd 4xx lub 5xx, albo dokument ładuje się spod niewłaściwego adresu, dalsze sprawdzanie treści i meta tagów ma ograniczony sens.

Kolejny krok to kontrola odpowiedzi serwera i nagłówków. Sprawdź canonical, meta robots, content-type, cache-control oraz pozostałe sygnały wpływające na indeksację i sposób renderowania. Nieprawidłowy canonical albo blokujący robots potrafi unieważnić poprawną treść widoczną na stronie. W praktyce dobrze zestawić to, co zwraca serwer, z tym, co finalnie ląduje w DOM.

W zakładce Elements porównaj końcowy DOM z tym, co faktycznie powinno być dostępne dla SEO. Zweryfikuj title, meta description, H1, główną treść, linki wewnętrzne, dane strukturalne oraz atrybuty alt przy obrazach. Jeśli istotne elementy pojawiają się dopiero po wykonaniu JavaScript, oceń, czy dzieje się to szybko i stabilnie oraz czy nie zależy od błędnych requestów.

Następnie wykorzystaj Console oraz filtry XHR i Fetch w Network, aby ustalić, skąd realnie pobierana jest treść. Błędy JavaScript, kłopoty z modułami, ostrzeżenia CSP i nieudane odpowiedzi API często wyjaśniają, dlaczego ważna sekcja strony pozostaje pusta albo linki nie trafiają do DOM. Jeśli treść opiera się na requestu, który zwraca błąd lub dociera zbyt późno, źródło problemu SEO leży w renderowaniu, a nie w meta tagach.

Na koniec oceń wydajność oraz widok mobilny. W Performance lub Lighthouse sprawdź zasoby blokujące renderowanie, ciężkie skrypty, długie zadania CPU, przesunięcia layoutu oraz moment pojawienia się głównej treści. W trybie mobilnym dopilnuj, by najważniejsze elementy były widoczne bez interakcji i nie znikały na małym ekranie.

Ostatnim etapem jest zapis ustaleń w formie operacyjnej. Każdy problem opisz przez konkretny URL, miejsce wykrycia, warunek występowania, wpływ na SEO oraz rekomendację wdrożeniową. Dobra analiza w DevTools kończy się konkretnym zadaniem do wdrożenia, a nie wyłącznie obserwacją.

Praktyczne wskazówki dotyczące analizy stron w DevTools

Praktyczne wskazówki dotyczące analizy stron w DevTools sprowadzają się do pracy na właściwych URL-ach, w odpowiednich warunkach i we właściwej kolejności. Nie zaczynaj od przypadkowej podstrony, jeśli problem może dotyczyć całego szablonu. Najlepiej analizować reprezentatywne typy stron:

- stronę główną,

- kategorię lub listing,

- produkt lub stronę usługi,

- artykuł albo poradnik,

- stronę paginacji.

Taka próbka zwykle szybko pokazuje, czy błąd jest incydentalny, czy powiela się w całej grupie adresów. Ma to szczególne znaczenie przy problemach z canonicalami, meta robots, linkowaniem oraz treścią składaną z tych samych komponentów.

W praktyce zacznij od weryfikacji statusu HTTP, przekierowań i reguł indeksacji, a dopiero później przejdź do meta tagów i treści. Jeżeli dokument zwraca niewłaściwy status, przekierowuje na inny adres albo ma blokadę indeksacji, dalsze wnioski potrafią wprowadzać w błąd. Zła kolejność analizy często kończy się leczeniem skutków zamiast usunięciem właściwej przyczyny.

W przypadku stron opartych o JavaScript upewnij się, że kluczowa treść i linki są dostępne bez klikania, przewijania i innych działań użytkownika. Element może wyglądać jak link, ale jeśli nie jest prawdziwym znacznikiem a z poprawnym href, jego znaczenie SEO jest ograniczone. To samo dotyczy treści doładowywanej dopiero po udanym wywołaniu API albo po zakończeniu hydracji frontendowej.

Warto też zestawiać stan początkowy i końcowy strony, gdy title, canonical lub meta robots są nadpisywane przez skrypty. Częsty scenariusz wygląda tak, że serwer zwraca jeden komplet sygnałów, a frontend po chwili podmienia go na inny. Bez sprawdzenia zmian w DOM łatwo uznać wdrożenie za poprawne, choć finalny stan strony pozostaje niespójny.

Zadbaj o warunki testu. Cache przeglądarki, service worker, testy A/B, personalizacja, geolokalizacja oraz rozszerzenia potrafią zmienić wynik analizy albo zamaskować realny błąd. Jeśli wynik jest niestabilny, najpierw wyklucz wpływ środowiska testowego, a dopiero potem oceniaj samo wdrożenie.

Na koniec grupuj problemy według typu: indeksacja, renderowanie, linkowanie, wydajność, zasoby i dane strukturalne. Taki podział ułatwia przekazanie zadań do właściwej osoby i przyspiesza wdrożenie poprawek. Raport powinien zawierać sprawdzony URL, kroki odtworzenia, zrzut z DevTools, wykryty błąd oraz jednoznaczną rekomendację naprawy.

Najczęstsze błędy i ryzyka przy korzystaniu z DevTools

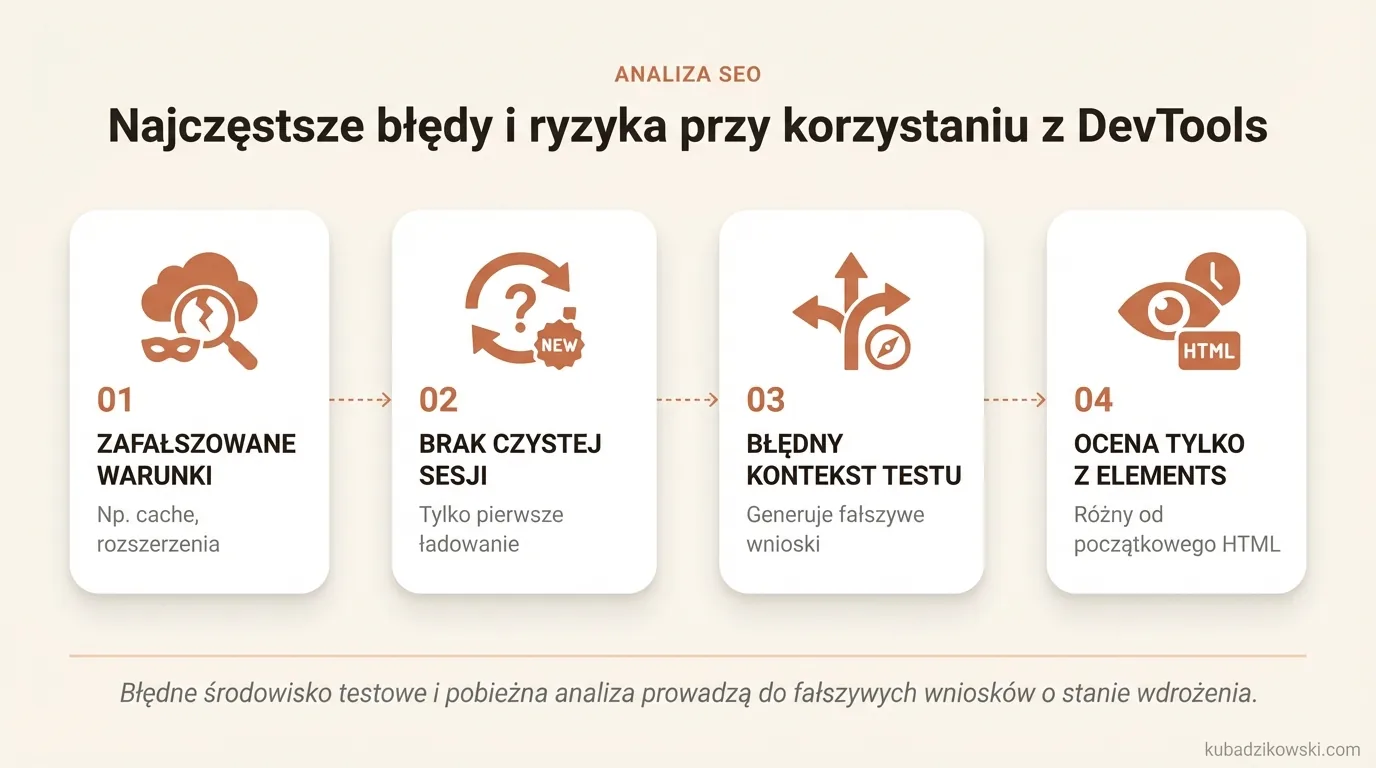

Najczęstsze potknięcia w pracy z DevTools to analiza strony w zafałszowanych warunkach oraz wyciąganie wniosków z niewłaściwego miejsca. Najbardziej mylą cache przeglądarki, service worker, rozszerzenia, testy A/B i personalizacja, bo potrafią pokazać inną wersję strony niż ta, którą realnie dostaje użytkownik lub bot. Jeśli nie odtworzysz pierwszego ładowania, łatwo uznać wdrożenie za poprawne, mimo że problem występuje wyłącznie przy wejściu z czystej sesji. W praktyce błędny kontekst testu generuje więcej fałszywych wniosków niż sama strona.

Częsty błąd polega na ocenianiu SEO wyłącznie przez pryzmat widoku w zakładce Elements. DOM po wykonaniu skryptów nie musi odzwierciedlać tego, co było dostępne w początkowym HTML i co zostało dostarczone wystarczająco wcześnie. Ma to szczególne znaczenie przy frameworkach frontendowych, hydracji oraz treści pobieranej z API. Strona może wyglądać poprawnie, a mimo to kluczowa treść, linki lub znaczniki mogą pojawiać się z opóźnieniem albo zależeć od requestu, który bywa zawodny i czasem kończy się błędem.

Drugie ryzyko to pomijanie technicznych fundamentów i przechodzenie od razu do meta tagów, nagłówków czy treści. Jeśli dokument ma niewłaściwy status HTTP, nieplanowane przekierowanie, blokadę w robots albo błędny canonical, dalsza analiza optymalizacji on-page ma ograniczoną wartość. Najpierw potwierdź, że URL jest dostępny, zwraca właściwy dokument i nie wysyła sprzecznych sygnałów indeksacyjnych.

Wiele osób zbyt mocno opiera się też na pojedynczych raportach, szczególnie Lighthouse. Taki wynik pomaga wychwycić problemy z wydajnością, ale sam w sobie nie przesądza o indeksowalności, jakości renderowania ani poprawności sygnałów SEO. Warto zestawić go z Network, Console, Elements oraz z realną odpowiedzią serwera. Sam niski lub wysoki wynik nie wskazuje jeszcze, co konkretnie wymaga poprawy.

Błąd interpretacyjny pojawia się również wtedy, gdy analizowany jest jeden URL i na tej podstawie ocenia się cały serwis. DevTools dobrze pokazuje przyczynę na poziomie konkretnej strony lub szablonu, ale nie zastępuje crawla całej witryny. Jeśli problem dotyczy kategorii, produktu albo paginacji, sprawdź kilka reprezentatywnych adresów. Dopiero wtedy widać, czy to odosobniony przypadek, czy błąd wdrożony systemowo.

Ryzykowne bywa także ignorowanie błędów JavaScript oraz requestów do API. Gdy treść, linkowanie lub znaczniki SEO są wstrzykiwane przez skrypty, awaria jednego pliku JS, CSP albo nieudane pobranie danych potrafi zatrzymać cały render. Jeśli ważny element SEO zależy od niestabilnego skryptu lub API, traktuj to jako realne ryzyko indeksacyjne, a nie drobną usterkę frontendu.

Wskaźniki do monitorowania i weryfikacji w procesie analizy SEO

W procesie analizy SEO w DevTools warto przede wszystkim kontrolować, czy dokument jest prawidłowo dostarczany, renderowany i uzupełniany o kluczowe sygnały. Zacznij od statusu HTTP dokumentu, finalnego adresu URL, łańcucha przekierowań oraz czasu odpowiedzi serwera. To one decydują, czy bot w ogóle otrzymuje właściwą stronę i czy po drodze nie napotyka nieplanowanych barier. Bez tego trudno rzetelnie oceniać resztę.

Następnie sprawdzaj odpowiedź HTML oraz nagłówki, zamiast ograniczać się wyłącznie do końcowego wyglądu strony. Zweryfikuj canonical, meta robots, content-type, hreflang oraz inne sygnały, które mogą wpływać na indeksację albo sposób interpretacji dokumentu. Najważniejsze jest zestawienie stanu początkowego z tym, co pojawia się po wykonaniu JavaScript, bo właśnie na tym etapie często wychodzą na jaw rozjazdy. Jeżeli skrypt nadpisuje title, canonical lub robots, trzeba ustalić, który wariant jest ostateczny oraz czy zachowuje się stabilnie.

Kolejny zestaw sygnałów dotyczy obecności treści i linków. Kontroluj, czy główna treść, H1, linki wewnętrzne, dane strukturalne oraz atrybuty alt znajdują się w DOM i czy są dostępne już przy pierwszym załadowaniu, bez działań po stronie użytkownika. W przypadku linków liczy się docelowy element a z prawdziwym href, a nie klikalny kontener sterowany skryptem. Ma to znaczenie zarówno dla crawlability, jak i dla przekazywania sygnałów wynikających z linkowania wewnętrznego.

Istotne są również wskaźniki związane z zasobami oraz błędami wykonania. W Network weryfikuj błędy 4xx i 5xx, brakujące pliki JS i CSS, opóźnione requesty XHR lub Fetch, a także zależności od usług zewnętrznych. W Console obserwuj błędy JavaScript, kłopoty z modułami, CSP oraz nieudane pobrania danych. Jeżeli główna treść albo linki są uzależnione od requestu, który nie zawsze kończy się powodzeniem, to jest to priorytetowy obszar do poprawy.

Wydajność warto śledzić przez pryzmat tego, jak realnie przekłada się na wyrenderowanie najważniejszej części strony. Zwracaj uwagę na zasoby blokujące renderowanie, ciężkie skrypty, długie zadania CPU, przesunięcia layoutu oraz moment pojawienia się głównej treści. Nie chodzi wyłącznie o ocenę w narzędziu, lecz o to, czy kluczowy content above the fold pojawia się szybko i pozostaje stabilny. Jeżeli LCP jest opóźnione przez duży obraz, skrypt zewnętrzny albo późne pobranie treści, problem ma jednocześnie wymiar UX i operacyjny dla SEO.

Na koniec potwierdź zgodność środowiska testowego z rzeczywistym wdrożeniem. W trybie mobilnym sprawdź widoczność treści, działanie responsywne oraz to, czy elementy nie znikają lub nie wczytują się inaczej niż na desktopie. W Application przejrzyj service worker i pamięci podręczne, aby upewnić się, że nie analizujesz starej wersji strony. Dobra analiza nie kończy się na samej obserwacji, tylko na zapisie: co sprawdzono, gdzie wykryto problem, w jakich warunkach występuje oraz jaki ma wpływ na SEO.