Strony internetowe na całym świecie są odwiedzane przez Googlebota, który odpowiada za ich analizę w celu ustalenia właściwego rankingu w rezultatach wyszukiwania. Pozyskuje on informacje umożliwiające zbudowanie możliwego do wyszukiwania indeksu sieciowego. Warto pamiętać, że Google posiada roboty dopasowane do stron stacjonarnych, na urządzenia mobilne, a także osobne roboty nakierowane na aktualności, ilustracje i materiały filmowe.

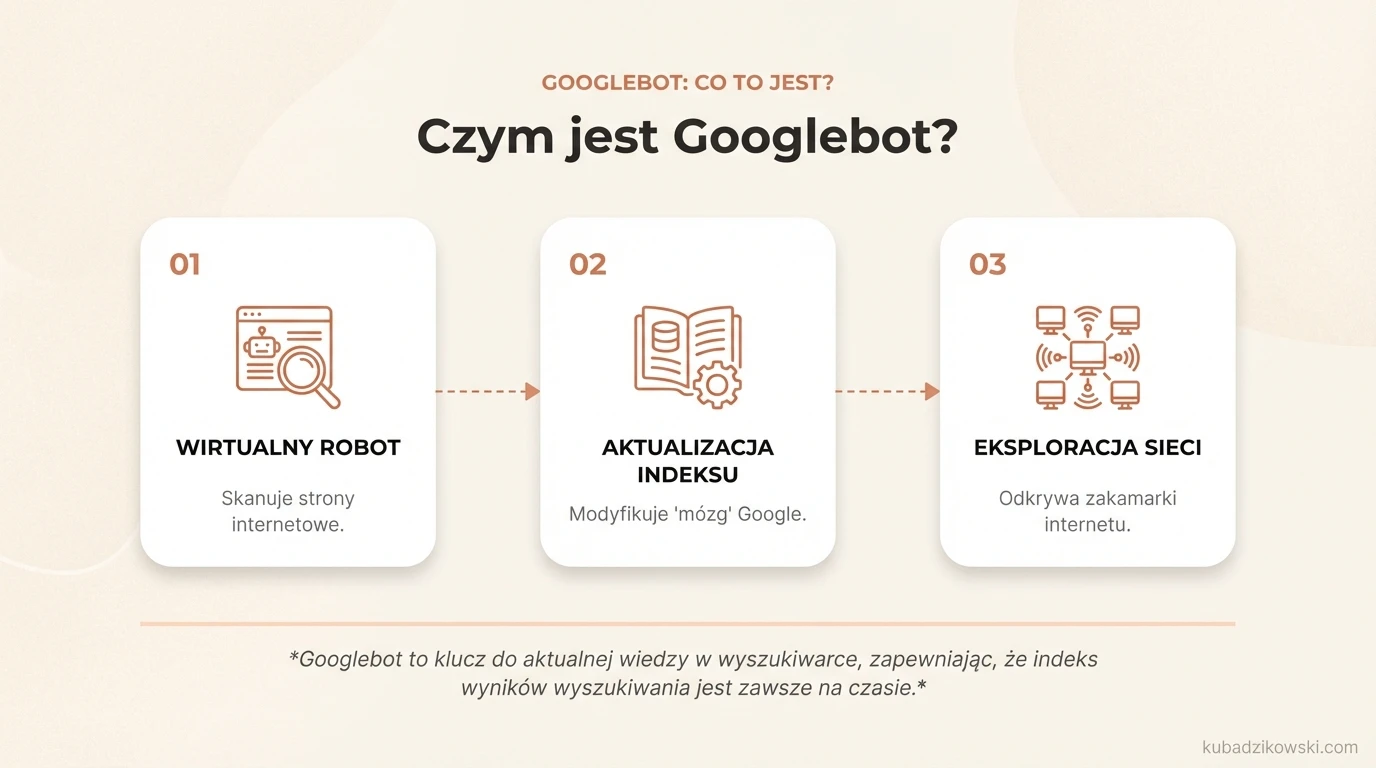

Czym jest Googlebot?

Googlebot to robot wirtualny opracowany przez inżynierów w biurach Mountain View. Rozwiązanie to ma na celu szybkie odwiedzanie stron przed zaindeksowaniem ich podstron. Jest to program komputerowy, który po prostu wyszukuje i odczytuje treści stron internetowych oraz modyfikuje ich indeks zgodnie z aktualnościami, które znajduje. Indeks, w którym przechowywane są rezultaty wyszukiwania stanowi pewnego rodzaju „mózg” Google. To w tym miejscu zachowana jest bowiem cała wiedza.

Google korzysta z tysięcy “małych komputerów” po to, aby wysyłać swoje roboty do wszystkich zakamarków sieci. Dzięki temu znajduje strony internetowe i sprawdza co się w nich znajduje.

Istnieje wiele różnych robotów, spośród których każdy ma swój dobrze określony cel. Na przykład roboty AdSense oraz AdsBot są odpowiedzialne za sprawdzanie zgodności płatnych reklam, podczas gdy Android Mobile Apps sprawdza aplikacje na Androida. Istnieją też roboty odpowiedzialne za obrazy, nowości, itp.

Jak działa Googlebot i czego on poszukuje?

Robot ten wykorzystuje mapy stron oraz linki znalezione w czasie procesów wyszukiwania. Googlebot sam określa jak często odwiedzać strony internetowe. Przydziela on każdej stronie „budżet”, czyli pewnego rodzaju limit odwiedzin.

W związku z tym normalne jest to, że setki, a nawet tysiące stron internetowych nie zostało w pełni odwiedzonych lub zaindeksowanych. Aby ułatwić pracę Googlebotowi i upewnić się, że strona jest prawidłowo zaindeksowana, warto sprawdzić czy jakiś czynnik nie blokuje robota albo go nie spowalnia (na przykład nieprawidłowa komenda w robots.txt).

Proces jest iteracyjny. Za każdym razem, gdy Googlebot znajdzie nowy adres URL, dodaje go do kolejki indeksowania.

Komendy robots.txt

Robots.txt stanowi pewnego rodzaju mapę dla Googlebota. Jest to pierwszy odwiedzany przez niego element, więc robot może działać zgodnie ze wskazaniami. W pliku robots.txt można ograniczyć dostęp Googlebota do określonych zasobów strony internetowej. System ten jest zwykle użytkowany w optymalizacji strategii wspomnianego wyżej budżetu (limitu) odwiedzania. Dostęp do pliku robots.txt w przypadku każdej strony internetowej, można uzyskać dodając robots.txt na końcu adresu URL.

Dzięki temu rozwiązaniu można na przykład zablokować odwiedzanie stron internetowych z koszykami zakupów, kontem klienta czy też różnych podstron konfiguracyjnych.

Pliki CSS

CSS to skrót od angielskiej nazwy Cascading Style Sheets (arkusze kaskadowe). Plik ten określa jak elementy HTML powinny być wyświetlane na ekranie. Oszczędza on sporo czasu, ponieważ arkusze styli znajdują zastosowanie dla całej strony internetowej. Plik taki może kontrolować nawet układ wielu stron internetowych w tym samym czasie. Googlebot już nie tylko czyta treść pisaną, ale również pobiera pliki CSS, aby lepiej zrozumieć ogólną zawartość strony internetowej.

Dzięki CSS Googlebot jest w stanie wykryć możliwe próby manipulacji na stronach internetowych mające na celu zwodzenie robotów i lepsze pozycjonowanie (do najpopularniejszych prób zalicza się maskowanie i umieszczanie białych treści na białym tle). Dodatkowo plik ten pozwala botowi na pobieranie pewnych obrazów (logo, piktogramy, itp.), odczytywanie wytycznych dotyczących responsywnego designu, które są istotne, aby wykazać, że dana strona internetowa nadaje się do przeglądania na urządzeniach mobilnych.

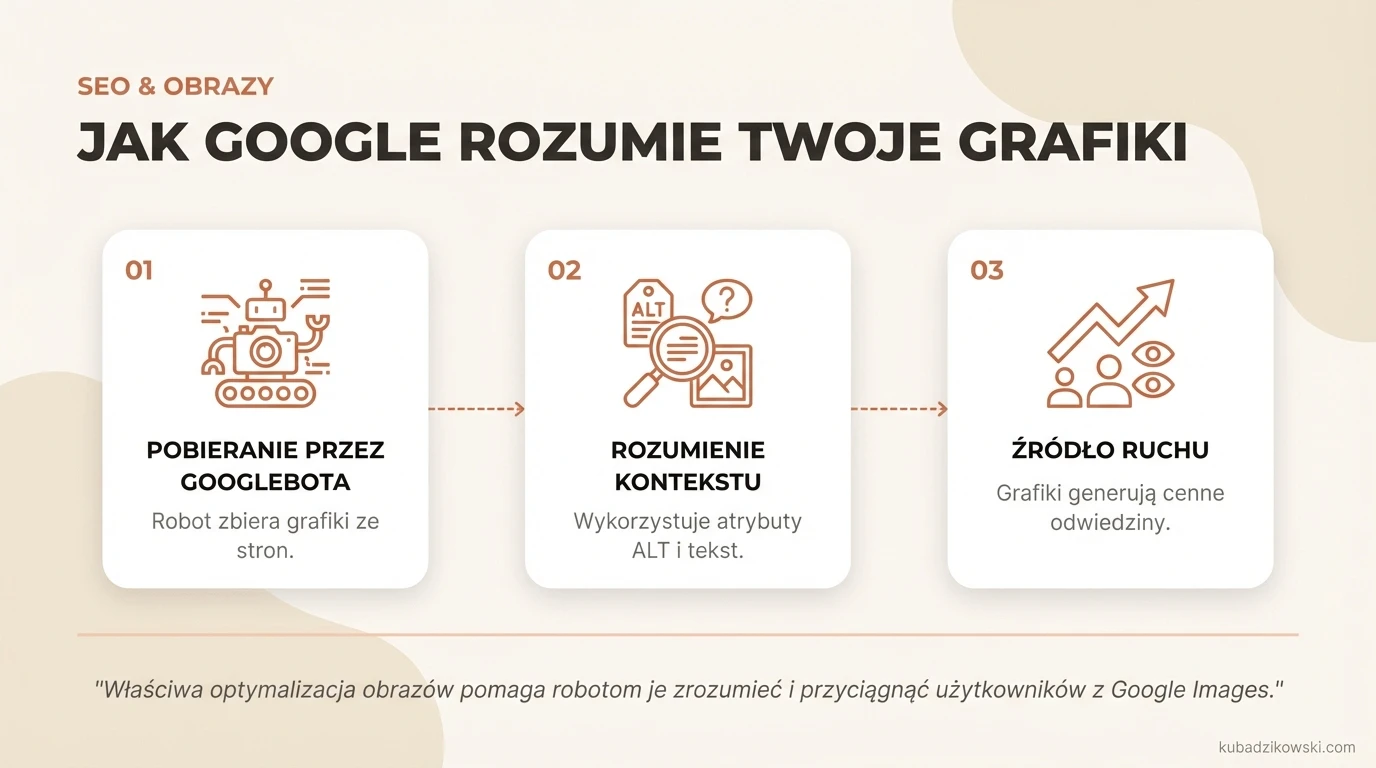

Obrazy

Googlebot pobiera obrazy ze stron internetowych, aby zasilić silnik Google Images. Oczywiście robot nie „widzi” samego obrazu, ale może go zrozumieć dzięki atrybutom alt oraz ogólnemu kontekstowi strony. W związku z tym nie należy lekceważyć obrazów, ponieważ stanowią one znaczne źródło ruchu.

Jak przeanalizować wizyty Googlebota na stronie internetowej?

Robot Google jest raczej dyskretny i niezauważalny na pierwszy rzut oka. Dla początkujących stanowi on pojęcie abstrakcyjne. W rzeczywistości taki robot istnieje i pozostawia po sobie ślady.

Są one widoczne w dziennikach strony internetowej (website logs). Jednym ze sposobów zrozumienia jak Googlebot odwiedza stronę internetową, jest dokonanie analizy logów. Plik logów umożliwia również obserwowanie precyzyjnego dnia i godziny wizyty bota, pliku docelowego lub wymaganej strony, odpowiedzi serwera, itp.

Google Search Console

Search Console znana dawniej jako Webmaster Tools (Narzędzia dla webmasterów) jest jednym z najważniejszych darmowych narzędzi do sprawdzania użyteczności strony internetowej. Za pośrednictwem wykresów indeksowania i odwiedzania, można sprawdzić stosunek odwiedzonych i zaindeksowanych stron w porównaniu z łączną liczną podstron, z których dana strona się składa. Dodatkowo możliwe jest uzyskanie listy błędów, które można naprawić, aby pomóc Googlebotowi lepiej poruszać się po stronie internetowej.

Płatne narzędzia do analizy logów

Aby dowiedzieć się jak często Googlebot odwiedza stronę internetową i co na niej robi, można skorzystać również z płatnych narzędzi do analizy logów serwerowych, które są o wiele bardziej zaawansowane niż Search Console. Wśród dobrze znanych znajdują się narzędzia, takie jak Oncrawl, Kibana, Botify czy też Screaming Frog Log Analyser. Rozwiązania te są bardziej przeznaczone dla stron internetowych składających się z wielu podstron, które muszą być podzielone na części, aby ułatwić analizę.

Rzeczywiście, w przeciwieństwie do Search Console zapewniającej ogólny zakres odwiedzania, niektóre z tych narzędzi pozwalają na udoskonalenie analizy poprzez określenie zakresu indeksowania każdego typu strony (strony kategorii, strony produktów, itp.). Takie podzielenie na części jest istotne, aby wycofać problematyczne strony i rozpatrzyć wprowadzenie na nich potrzebnych poprawek.

Jak zoptymalizować stronę internetową, aby spełnić wymagania Googlebota?

Pomaganie Googlebotowi w skanowaniu podstron na stronie internetowej może być złożonym procesem. Obejmuje on konieczność przełamania barier technicznych uniemożliwiających robotowi przeglądanie strony w sposób zoptymalizowany. Jest to jeden z trzech filarów SEO: optymalizacja wykonywana na stronie.

Regularna aktualizacja treści na stronie internetowej

Treść jest zdecydowanie najważniejszym kryterium dla Google, jak również dla innych wyszukiwarek. Strony internetowe, które regularnie aktualizują swoją treść będą prawdopodobnie częściej przeglądane, ponieważ Google stale poszukuje nowych rzeczy.

W przypadku prowadzenia strony będącej wizytówką firmy (gdzie trudno jest regularnie dodawać treści) można stworzyć firmowy blog bezpośrednio połączony ze stroną. Zachęci to bota do częstszego odwiedzania strony oraz wzbogaci semantykę strony internetowej. Średnio zaleca się dodawanie nowych treści przynajmniej trzy razy w tygodniu, aby zwiększyć częstotliwość odwiedzania i indeksowania.

Poprawa czasu reakcji serwera oraz czasu wczytywania strony

Czas wczytywania strony jest czynnikiem determinującym. Rzeczywiście, jeśli Googlebotowi proces wczytywania i przeglądania strony zajmie zbyt wiele czasu, wówczas przejrzy on mniej podstron. W związku z tym należy umieścić stronę na niezawodnym serwerze oferującym dobrą wydajność.

Tworzenie map witryn

Dodanie mapy witryny (sitemap) jest jedną z pierwszych rzeczy, jaką można zrobić, aby boty szybciej i łatwiej skanowały daną stronę. Nie będą one przeglądać wszystkich stron na mapie, ale będą miały przygotowane ścieżki, co jest szczególnie istotne dla podstron, które są nieprawidłowo linkowane w ramach strony.

Unikanie powielania treści

Duplicate content (powielanie treści) znacząco zmniejsza zakres przeglądania, ponieważ robot Google uznaje, że wykorzystywane są jego zasoby do przeglądania tej samej rzeczy. Innymi słowy podejmuje on wysiłek na marne. To dlatego w przypadku Google, jak i Panda trzeba jak najbardziej unikać powielania treści.

Blokowanie dostępu do niechcianych stron za pośrednictwem Robots.txt

Aby zachować crawl budget (czas poświęcony na indeksowanie) nie ma konieczności umożliwiania robotom wyszukiwarek skanowania niewłaściwych stron. Do tego grona zaliczają się podstrony informacyjne, z opcjami zarządzania kontem, itp. Prosta modyfikacja pliku robots.txt zablokuje skanowanie tych podstron przez Googlebota.

Zadbanie o linkowanie wewnętrzne

Linkowanie wewnętrzne jest kluczowe dla optymalizacji crawl budget. Nie tylko pozwala na zapewnianie odpowiedniej wartości SEO każdej podstronie, ale również lepiej nakierowuje boty na dalsze podstrony. Mówiąc dokładniej, posiadając bloga, po dodaniu artykułu, należy umieścić w miarę możliwości link kierujący do starszej podstrony. Będzie ona odpowiednio zasilana i nadal będzie obiektem zainteresowania Googlebota.

Linkowanie wewnętrzne nie pomaga bezpośrednio w zwiększeniu zakresu odwiedzania, ale pomaga botom w skutecznym skanowaniu dalszych i głębszych podstron, które są często pomijane.

Optymalizacja obrazów

Roboty są inteligentne, ale nie są jeszcze w stanie wizualizować obrazu. Potrzebują więc wytycznych tekstowych. Jeśli strona zawiera obrazy, należy uzupełnić atrybuty alt, aby zapewnić jasny opis, który wyszukiwarki zrozumieją i zaindeksują. Obrazy mogą pojawić się w rezultatach wyszukiwania, jeśli są właściwie zoptymalizowane. Optymalizacja obrazów jest niezwykle istotna!