A/B testing należy do najbardziej praktycznych metod podnoszenia konwersji, ponieważ umożliwia weryfikowanie zmian na stronie w sposób kontrolowany, zamiast polegać wyłącznie na opiniach zespołu. W skrócie zestawiasz wersję aktualną z nowym wariantem i mierzysz, która skuteczniej realizuje cel, taki jak zakup, wysłanie formularza czy kliknięcie przycisku. To podejście sprawdza się zarówno w e-commerce, jak i na stronach leadowych, landing page’ach czy formularzach kontaktowych. Kluczowe jest to, że test ma sens wyłącznie wtedy, gdy dysponujesz poprawnym pomiarem i jasno określonym celem biznesowym. Samo uruchomienie narzędzia do eksperymentów nie pomoże, jeśli nie masz pewności, co konkretnie chcesz usprawnić i po jakich wskaźnikach ocenisz rezultat. Dobrze przeprowadzony test daje nie tylko werdykt „wygrało” albo „przegrało”, lecz także wiedzę o tym, jak użytkownicy reagują na daną zmianę.

Czym jest A/B testing i jak działa w praktyce?

A/B testing to kontrolowane porównanie dwóch wersji elementu strony lub dwóch spójnych wariantów strony, które pozwala sprawdzić, która wersja lepiej dowozi konkretny cel. Najczęściej na warsztat trafiają nagłówki, przyciski CTA, formularze, układ sekcji, elementy zaufania, sposób prezentacji ceny, koszyk albo checkout. W praktyce nie chodzi o wersję „ładniejszą”, tylko o tę, która generuje więcej wartościowych działań po stronie użytkownika.

Proces zaczyna się od wyboru celu głównego oraz metryk pomocniczych. Celem może być zakup, wysłanie formularza, przejście do koszyka albo kliknięcie w istotny przycisk, natomiast metryki pomocnicze pomagają ocenić, czy wzrost nie dzieje się kosztem jakości. Jeśli nie wiesz, jaka decyzja ma zapaść po teście, to znaczy, że test został źle zaplanowany.

Kolejny etap to analiza danych i sformułowanie hipotezy. Zamiast strzelać na oślep, sprawdza się, w których miejscach użytkownicy wypadają z lejka, czego nie klikają, gdzie porzucają formularz oraz jakie błędy pojawiają się na stronie. Dobra hipoteza ma prostą konstrukcję: zmieniamy konkretny element, oczekujemy konkretnego efektu i potrafimy to uzasadnić danymi.

Następnie przygotowuje się wariant, wdraża eksperyment i rozdziela ruch między wersję kontrolną a nową wersję. Na tym poziomie liczą się detale techniczne: poprawny tracking, reguły wyświetlania, wykluczenie ruchu wewnętrznego, kontrola działania na urządzeniach i przeglądarkach oraz weryfikacja, czy inne skrypty nie wpływają na przebieg testu. Najbezpieczniej jest testować jedną istotną zmianę lub jeden spójny wariant, bo wtedy wiadomo, co rzeczywiście przełożyło się na wynik.

Po starcie testu nie wystarczy zerkać na pierwszy wzrost konwersji. Trzeba na bieżąco pilnować jakości danych, rozkładu ruchu, błędów, wpływu na segmenty użytkowników oraz ewentualnych skutków ubocznych, na przykład spadku wartości koszyka albo gorszej jakości leadów. Na końcu zapada decyzja: wdrożyć zwycięzcę, odrzucić hipotezę albo przygotować kolejną iterację i zapisać wnioski do backlogu testów.

Jakie czynniki wpływają na sukces testów A/B?

O powodzeniu testów A/B w największym stopniu decydują jakość danych, trafnie dobrany cel, odpowiedni wolumen ruchu oraz brak zakłóceń podczas eksperymentu. Jeśli któryś z tych elementów kuleje, rezultat może wyglądać obiecująco, a mimo to prowadzić do nietrafnej decyzji. Z tego powodu skuteczność testu częściej wynika z dobrego przygotowania niż z samej kreacji wariantu.

Punktem wyjścia jest rzetelny pomiar. Zgody na śledzenie, blokowanie skryptów, źle skonfigurowane eventy, zdublowane konwersje albo nieprawidłowy podział ruchu potrafią całkowicie wypaczyć wynik. Najczęstszy praktyczny problem nie polega na tym, że wariant jest słaby, tylko na tym, że dane nie pozwalają go uczciwie ocenić.

Istotne jest również to, co dokładnie testujesz i przy jakim natężeniu ruchu. Serwisy z niewielką liczbą transakcji rzadko dostarczają szybkich odpowiedzi na poziomie zakupu, dlatego częściej sens ma testowanie mikrokonwersji, kroków formularza albo segmentów o wyższej intencji. Przy ograniczonym ruchu lepiej uderzyć w największe bariery, zamiast rozbijać eksperymenty na mało znaczące detale.

Na rezultat wpływa także sposób wdrożenia. Testy client-side są łatwiejsze do uruchomienia, ale mogą wywoływać migotanie treści i pogarszać doświadczenie użytkownika, szczególnie na wolniejszych urządzeniach. Wdrożenie server-side zapewnia większą kontrolę nad tym, co użytkownik faktycznie widzi i jak jest to mierzone, jednak wymaga sprawniejszej organizacji po stronie technicznej.

Nie każdy wariant zachowuje się identycznie we wszystkich grupach użytkowników. Mobile i desktop często reagują inaczej, podobnie jak ruch z kampanii płatnych, wejścia organiczne, nowi użytkownicy i powracający klienci. Wariant wygrywający globalnie może przegrywać w najważniejszym segmencie, dlatego segmentacja jest częścią analizy, a nie dodatkiem.

Znaczenie ma też kontekst biznesowy, który nie wynika bezpośrednio z samego testu. Promocje, zmiany cen, problemy z dostępnością produktu, sezonowość, inne wdrożenia UX oraz równoległe kampanie reklamowe mogą poprawić albo pogorszyć wynik niezależnie od badanego wariantu. Dlatego przed interpretacją warto sprawdzić, czy eksperyment nie został zaburzony przez zdarzenia towarzyszące.

W praktyce o powodzeniu testów najczęściej rozstrzyga kilka powtarzalnych zasad:

- testuj strony i etapy lejka o realnym znaczeniu biznesowym, a nie przypadkowe elementy,

- buduj hipotezy na podstawie danych z analityki, nagrań sesji, map kliknięć i porzuceń,

- nie uruchamiaj eksperymentu bez QA na urządzeniach, przeglądarkach i różnych źródłach ruchu,

- nie kończ testu po pierwszym pozytywnym sygnale, tylko czekaj na stabilny obraz danych.

Najlepsze efekty przynosi konsekwencja, a nie pojedynczy „genialny” pomysł. Każdy test powinien zakończyć się wnioskiem, który zasila kolejne hipotezy i porządkuje wiedzę o tym, co rzeczywiście zwiększa konwersję w danym serwisie. Dzięki temu A/B testing staje się procesem podejmowania trafniejszych decyzji, a nie jednorazową akcją optymalizacyjną.

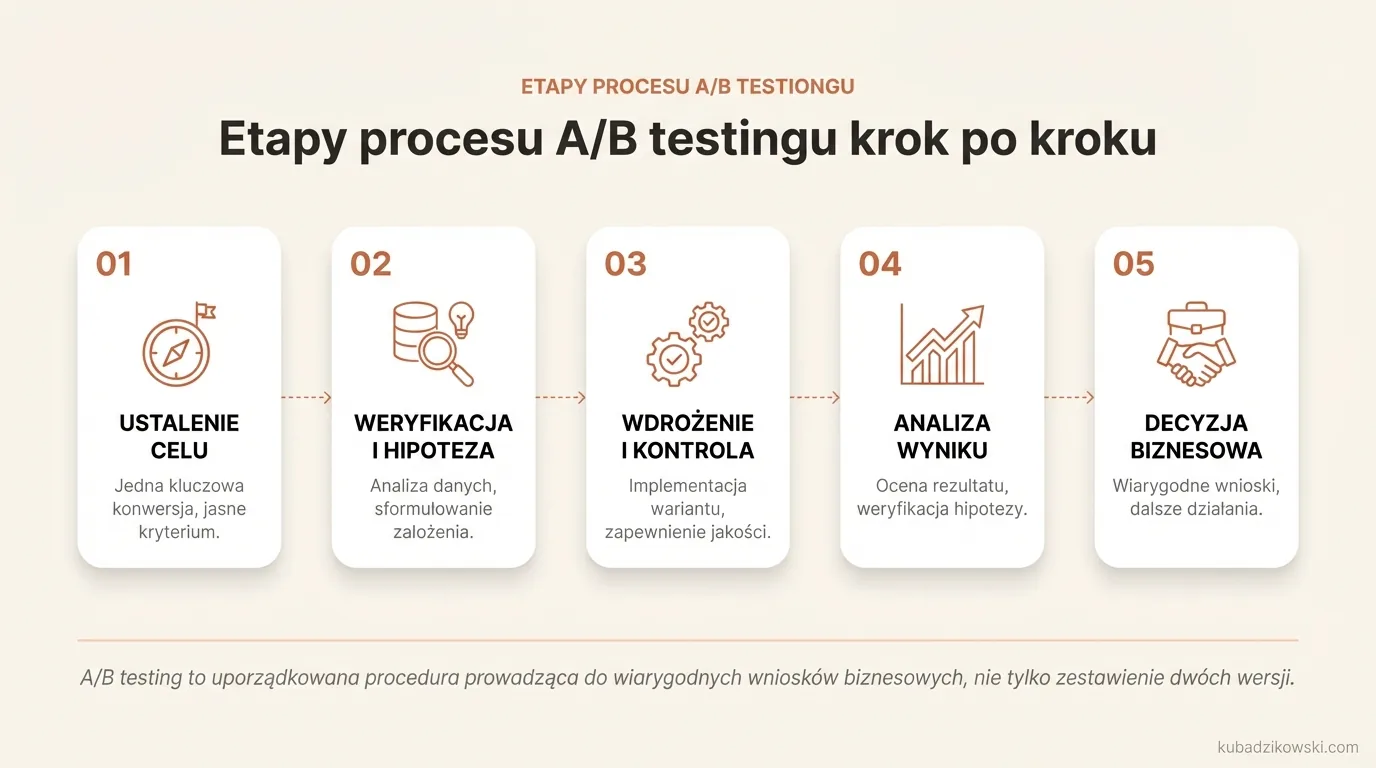

Etapy procesu A/B testingu krok po kroku

Etapy procesu A/B testingu krok po kroku obejmują: ustalenie celu, weryfikację danych, sformułowanie hipotezy, wdrożenie wariantu, kontrolę jakości, analizę wyniku oraz decyzję o dalszych działaniach. W praktyce nie jest to wyłącznie zestawienie dwóch wersji strony, lecz uporządkowana procedura, która ma doprowadzić do wiarygodnego wniosku biznesowego. Jeżeli na początku nie zdefiniujesz jednej kluczowej konwersji i jasnego kryterium sukcesu, rezultaty testu trudno będzie obronić.

Pierwszym krokiem jest wybór celu głównego oraz metryk pomocniczych. Celem może być zakup, wysłanie formularza, kliknięcie CTA albo przejście do kolejnego etapu lejka. Metryki pomocnicze pomagają ocenić, czy poprawa jednego wskaźnika nie odbyła się kosztem innych obszarów, na przykład jakości leadów, wartości koszyka czy liczby błędów.

Drugi etap to audyt danych i diagnoza problemu. Warto potwierdzić, że analityka poprawnie zlicza zdarzenia, nie występują duble konwersji, ruch wewnętrzny i boty są wykluczone, a ścieżki użytkownika da się prześledzić w raportach. Dopiero później ma sens szukanie punktów tarcia na podstawie lejka, map kliknięć, nagrań sesji, porzuceń koszyka, błędów formularza oraz zachowania użytkowników na mobile i desktop.

- Budowa hipotezy polega na zapisaniu planowanej zmiany w prostym schemacie: co zmieniamy, jaki efekt chcemy uzyskać oraz na jakich danych opieramy to założenie.

- Priorytetyzacja pomaga wybrać testy, które mają uzasadnienie biznesowe, są wykonalne technicznie i nie niosą nadmiernego ryzyka.

- Projekt wariantu obejmuje przygotowanie copy, układu, elementów zaufania, logiki formularza albo zmian w koszyku i checkoutcie.

- Implementacja to skonfigurowanie podziału ruchu, reguł wyświetlania wersji oraz integracji z narzędziami pomiarowymi.

- QA oznacza weryfikację, czy wariant działa poprawnie na urządzeniach i przeglądarkach, przy różnych źródłach ruchu oraz w odmiennych warunkach zgody na śledzenie.

- Monitoring po starcie służy do wychwytywania anomalii, konfliktów ze skryptami, spadków wydajności oraz nierównego rozkładu ruchu między wersjami.

- Analiza wyniku nie powinna kończyć się na jednym wskaźniku. Trzeba zestawić wpływ na główną konwersję, metryki uboczne oraz segmenty użytkowników.

- Decyzja i dokumentacja oznaczają wdrożenie zwycięzcy, odrzucenie hipotezy albo kolejną iterację, a następnie zapisanie wniosków w backlogu CRO.

Na etapie wdrożenia istotny jest sposób technicznego uruchomienia testu. Wersje client-side często dają się uruchomić szybciej, ale potrafią powodować migotanie treści i zaburzać doświadczenie użytkownika. W bardziej wymagających testach większą kontrolę zapewnia wdrożenie server-side, zwłaszcza gdy liczy się stabilność pomiaru i spójne działanie strony.

Końcowa analiza powinna brać pod uwagę kontekst, a nie wyłącznie sam wykres. Równolegle prowadzone kampanie, zmiany cen, sezonowość, kłopoty z dostępnością produktu czy jednoczesne poprawki UX potrafią zniekształcić rezultat. Dobry test kończy się decyzją, którą można obronić danymi, a nie tylko wrażeniem, że jedna liczba wygląda lepiej od drugiej.

Praktyczne wskazówki dla skutecznego zwiększania konwersji

Skuteczne zwiększanie konwersji dzięki testom A/B wymaga trafnego wyboru stron, poprawnego pomiaru oraz konsekwencji w interpretowaniu wyników. Największy zwrot zwykle przynoszą eksperymenty na etapach o wysokiej wadze biznesowej, takich jak landing page, karta produktu, koszyk, checkout, formularz kontaktowy czy cennik. W tych punktach jedna dobrze dobrana zmiana potrafi poprawić wynik całego lejka, a nie tylko pojedynczego kliknięcia.

Na początek wybieraj obszary, w których dane pokazują realny problem. Może to być niski współczynnik przejścia do koszyka, wysoki odsetek porzuceń formularza, słaby scroll depth albo niewiele kliknięć w główne CTA. Nie testuj pomysłów „na chybił trafił”, tylko rozwiązania odpowiadające na konkretną barierę widoczną w zachowaniu użytkowników.

W ramach jednego testu ogranicz liczbę zmian do niezbędnego minimum. Gdy jednocześnie zmienisz nagłówek, kolor przycisku, układ sekcji i formularz, trudno potem rozstrzygnąć, co faktycznie zadziałało. W serwisach z mniejszym ruchem częściej lepiej wypadają mocniejsze, wyraźnie odróżniające się warianty niż drobne, kosmetyczne korekty.

Przed startem zawsze zweryfikuj pomiar. Źle skonfigurowane eventy, błędnie oznaczone źródła ruchu albo zdublowane konwersje potrafią przekreślić cały eksperyment. Najpierw wiarygodne dane, potem test — w odwrotnej kolejności łatwo o wnioski oparte na błędach.

Oceniaj nie tylko sam wzrost konwersji, lecz także jakość efektu biznesowego. W lead generation liczy się jakość leadów, a nie jedynie liczba wysłanych formularzy. W e-commerce warto patrzeć również na średnią wartość koszyka, zwroty, anulacje, marżę oraz zachowanie użytkowników po zakupie.

Segmentacja potrafi całkowicie zmienić wniosek z testu. Ten sam wariant może działać dobrze dla ruchu z SEO, a słabo dla kampanii płatnych. Podobnie mobile i desktop często wymagają osobnej oceny, bo układ interfejsu, intencja użytkownika i ograniczenia ekranu wpływają na zachowanie inaczej niż na dużym monitorze.

Nie zamykaj testu po pierwszym pozytywnym sygnale. Krótkotrwały wzrost może wynikać z promocji, zmiany cen, sezonowego skoku ruchu albo chwilowej przewagi jednego źródła wejść. Wynik testu trzeba czytać razem z kontekstem biznesowym, inaczej łatwo wdrożyć zmianę, która nie utrzyma skuteczności w dłuższym okresie.

Gdy ruch jest niewielki, nie warto na siłę opierać testu na finalnym zakupie. Często lepszym wskaźnikiem są mikrokonwersje, na przykład przejście do kolejnego kroku formularza, kliknięcie w CTA, dodanie produktu do koszyka czy otwarcie sekcji z ofertą. Dobrze jest też podeprzeć decyzję badaniami jakościowymi, ponieważ nagrania sesji oraz analiza błędów w formularzu nierzadko szybciej ujawniają źródło problemu niż długie czekanie na wynik testu.

Po każdym eksperymencie uzupełniaj backlog hipotez i doprecyzowuj standardy pracy nad UX. Nawet przegrany test wnosi konkret: pokazuje, co nie działa w danym segmencie, przy określonej ofercie lub na konkretnym etapie lejka. Największa wartość A/B testingu nie polega na pojedynczej wygranej, ale na systematycznym uczeniu się, co realnie zwiększa konwersję w Twoim serwisie.

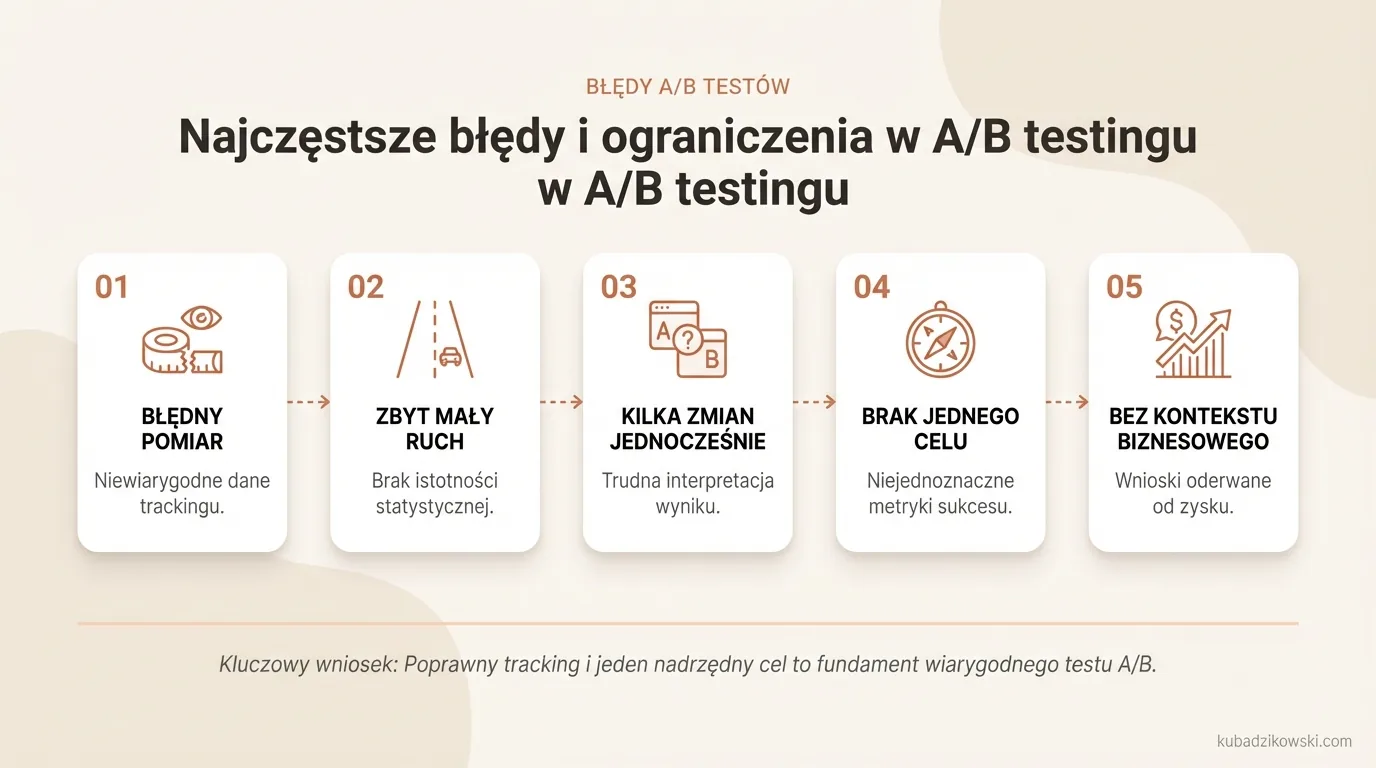

Najczęstsze błędy i ograniczenia w A/B testingu

Do najczęstszych błędów i ograniczeń w A/B testingu należą błędny pomiar, zbyt mały ruch, testowanie kilku elementów jednocześnie oraz wyciąganie wniosków bez odniesienia do kontekstu biznesowego. W praktyce nawet sensowna zmiana nie da wiarygodnego wyniku, jeśli analityka zlicza konwersje podwójnie albo część użytkowników w ogóle nie trafia do pomiaru. Najpierw trzeba mieć poprawny tracking, dopiero potem warto testować warianty.

Jednym z częstszych potknięć jest start testu bez jednego, nadrzędnego celu konwersji. Jeśli raz analizujesz kliknięcia CTA, innym razem wysłane formularze, a na końcu sprzedaż, wynik da się odczytać na kilka sposobów i trudno o jednoznaczną decyzję. Do celu głównego warto dołożyć metryki pomocnicze, ale ich ról nie należy ze sobą mieszać.

Kolejna bariera to zbyt mały ruch albo zbyt słaby kontrast między wariantami. Na stronach z niską liczbą sesji test oparty na zakupie potrafi ciągnąć się bardzo długo albo kończyć się niestabilnym rezultatem. W takich przypadkach lepiej testować największe bariery, wprowadzać wyraźniejsze zmiany albo mierzyć bliższe mikrokonwersje, na przykład przejście do kolejnego kroku formularza.

Wiele testów wykłada się już na etapie wdrożenia. Przy implementacji client-side może pojawić się migotanie treści, opóźnienie ładowania lub konflikt z innymi skryptami, co samo w sobie zmienia zachowanie użytkownika. Jeśli strona jest rozbudowana i ma duży ruch, server-side zwykle zapewnia większą kontrolę nad doświadczeniem oraz pomiarem.

Dużym błędem bywa także prowadzenie testu w niestabilnym środowisku. Równoległa promocja, zmiana cen, brak produktu, awaria formularza albo istotna zmiana w kampanii płatnej potrafią wpłynąć na wynik mocniej niż sam wariant. Jeśli w trakcie eksperymentu zmienia się kilka ważnych rzeczy, wynik testu trzeba traktować ostrożnie.

Ograniczeniem A/B testingu jest również to, że wynik globalny nie zawsze oddaje rzeczywistość dla wszystkich użytkowników. Ten sam wariant może działać dobrze na desktopie, a słabo na mobile, albo poprawiać wynik w ruchu organicznym i pogarszać w ruchu z reklam. Dlatego sensowna analiza prawie zawsze wymaga spojrzenia na segmenty: urządzenie, źródło ruchu, nowy i powracający użytkownik oraz etap lejka.

W praktyce błędem bywa również kończenie testu po pierwszym wzroście albo po pierwszym spadku. W pierwszych dniach rozkład ruchu potrafi być nierówny, a zachowania użytkowników mogą przejściowo odbiegać od typowego schematu. Test powinien trwać do momentu, w którym dane się ustabilizują i da się ocenić nie tylko wzrost konwersji, ale również ewentualne skutki uboczne.

Jak mierzyć i analizować wyniki testów A/B?

Wyniki testów A/B mierzy się, zestawiając wpływ wersji kontrolnej i wariantu na jedną główną konwersję, metryki pomocnicze oraz zachowania kluczowych segmentów użytkowników. Kluczowe jest, aby jeszcze przed startem jasno zdefiniować, co w tym teście oznacza sukces i na jakich danych oprze się decyzję. W przeciwnym razie łatwo nagiąć interpretację pod oczekiwany rezultat.

Pomiar warto zacząć od weryfikacji jakości danych. Trzeba sprawdzić, czy eventy uruchamiają się prawidłowo, czy ruch jest dzielony zgodnie z założeniem, czy nie pojawiają się duplikaty konwersji oraz czy wykluczono ruch wewnętrzny i boty. Dobrze też pamiętać, że zgody na śledzenie oraz blokowanie skryptów mogą zaburzać obraz, dlatego wynik należy interpretować w kontekście jakości danych, a nie traktować go jak matematyczną pewność.

Rzetelna analiza nie sprowadza się do jednego wskaźnika. Jeżeli wariant zwiększa liczbę leadów, ale obniża ich jakość albo podnosi liczbę błędów na dalszym etapie, biznesowo może wypaść gorzej niż wersja kontrolna. Najlepszy wynik to nie zawsze najwyższy współczynnik konwersji, tylko najlepszy efekt dla całego lejka.

- główna konwersja, na której opiera się decyzja,

- metryki pomocnicze, na przykład kliknięcie CTA, przejście do kolejnego kroku, błędy formularza,

- jakość wyniku biznesowego, na przykład wartość koszyka, jakość leadów, zwroty lub rezygnacje,

- wynik w kluczowych segmentach: mobile i desktop, źródła ruchu, nowi i powracający użytkownicy,

- informacje o zakłóceniach, takich jak zmiana kampanii, promocja lub problem techniczny.

W trakcie testu trzeba obserwować nie tylko liczby, ale też ich spójność. Jeśli jeden wariant nagle zaczyna dostawać wyraźnie inny typ ruchu, ma nietypowo wysoki współczynnik odrzuceń albo spowalnia stronę, w pierwszej kolejności należy sprawdzić implementację. Analiza ma sens dopiero wtedy, gdy masz pewność, że zestawiasz warunki, które rzeczywiście da się porównać.

Po zakończeniu eksperymentu warto zestawić wynik globalny z wynikami segmentów oraz z danymi jakościowymi. Nagrania sesji, mapy kliknięć czy analiza porzuceń często wyjaśniają, dlaczego wariant wygrał albo przegrał. Sam wynik mówi, co zadziałało; dopiero połączenie danych ilościowych i jakościowych pomaga zrozumieć, dlaczego.

Na zakończenie potrzebna jest jasna decyzja: wdrożenie wariantu, który wygrał, odrzucenie hipotezy albo przeprowadzenie kolejnej iteracji testu. Dobrze jest zapisać nie tylko sam rezultat, lecz także warunki eksperymentu, użyte segmenty, napotkane ograniczenia oraz wnioski z analizy. Dzięki temu następne działania nie startują od zera, tylko opierają się na coraz bogatszej bazie wiedzy o tym, co realnie podnosi konwersję w danym serwisie.