Ajax sam w sobie nie szkodzi SEO, jednak potrafi utrudnić Google dostęp do tego, co powinno zostać zobaczone i zaindeksowane. W praktyce kłopotem bywa nie tyle technologia, co dostępność treści, linków oraz stanów strony dla robota. Ma to szczególne znaczenie w sklepach, serwisach ofertowych i aplikacjach typu SPA, gdzie wiele elementów dociąga się dynamicznie. Jeśli istotna treść pojawia się dopiero po kliknięciu, scrollu albo zmianie filtra, Google może nie uznać jej za łatwo dostępną. Dlatego ocenę SEO dla Ajax warto zacząć od prostego pytania: co faktycznie znajduje się w HTML i co widać po renderowaniu, bez udziału użytkownika. To ten poziom w praktyce przesądza, czy strona dynamiczna będzie wspierała widoczność, czy ją ograniczała.

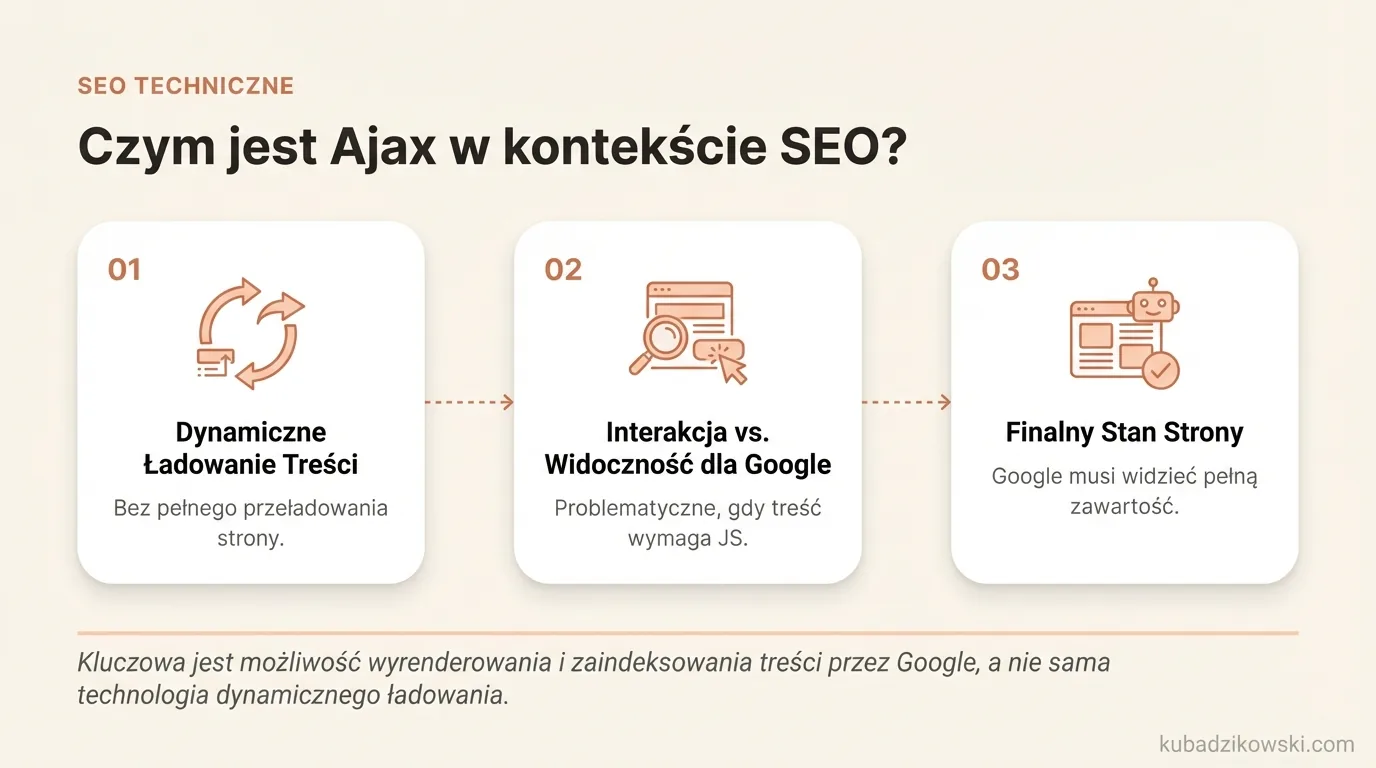

Czym jest Ajax w kontekście SEO?

Ajax w kontekście SEO oznacza sposób ładowania lub podmieniania treści bez pełnego przeładowania strony. Ma znaczenie wyłącznie wtedy, gdy wpływa na to, co Google jest w stanie pobrać, wyrenderować i zaindeksować. Sama technologia nie stanowi problemu. Schody zaczynają się w momencie, gdy kluczowa zawartość pojawia się dopiero po uruchomieniu JavaScript albo po wykonaniu konkretnej akcji przez użytkownika.

W praktyce Ajax działa tak, że przeglądarka pobiera dane z API i aktualizuje fragment strony po stronie klienta. Dla użytkownika to wygodne rozwiązanie, bo interfejs pozostaje płynny. Z perspektywy SEO istotne nie jest jednak samo dynamiczne ładowanie, lecz to, czy Google może zobaczyć finalny stan strony bez zgadywania, co ma się wydarzyć po kliknięciu.

Najwięcej ryzyk dotyczy elementów takich jak listy produktów, filtrowanie, paginacja, zakładki, komentarze czy karty ofert. Jeżeli te sekcje mają znaczenie dla ruchu organicznego, powinny być dostępne w sposób przewidywalny i możliwy do otwarcia pod konkretnym adresem. Każdy istotny widok powinien mieć własny, stabilny URL, a nie istnieć wyłącznie jako chwilowy stan aplikacji.

Dlatego w ocenie SEO nie rozstrzyga samo słowo „Ajax”, tylko to, czy da się dotrzeć do konkretnej treści. Analizuje się surowy HTML, rezultat renderowania oraz to, czy do ważnych stanów prowadzą zwykłe linki, a nie wyłącznie handlery JavaScript. Dopiero na tej podstawie można rzetelnie stwierdzić, czy rozwiązanie jest bezpieczne z punktu widzenia indeksacji.

Aktualne wyzwania techniczne związane z Ajax i Google

Aktualne wyzwania techniczne związane z Ajax i Google wynikają z faktu, że Google potrafi renderować JavaScript, ale nie zawsze robi to natychmiast i nie zawsze bez komplikacji. W efekcie strona może zostać najpierw oceniona na podstawie surowego HTML, a dopiero później na podstawie wyrenderowanego DOM. Im więcej krytycznej treści zależy od JavaScript, tym większe ryzyko opóźnień, braków albo błędnej interpretacji.

Dlatego pewniejsze są wdrożenia, w których kluczowe elementy są dostępne od pierwszego renderu w HTML albo dostarczane przez SSR, SSG lub prerendering. Dotyczy to nie tylko treści głównej, lecz także tytułu strony, meta description, nagłówków oraz danych strukturalnych. Gdy te składniki pojawiają się dopiero po stronie klienta, Google może trafić na pusty albo niekompletny widok.

Drugą często spotykaną przeszkodą są zasoby niezbędne do złożenia strony. Kiedy zablokowane są pliki JS, CSS, endpointy API lub obrazy, robot może nie odtworzyć widoku tak, jak robi to użytkownik. Nawet poprawny kod aplikacji nie pomoże, jeśli Google nie ma dostępu do zasobów potrzebnych do renderowania.

Znaczenie mają również adresy URL i sposób obsługi stanów aplikacji. Google nie wymaga już dawnych schematów typu hashbang, ale potrzebuje zwykłych adresów, które da się otworzyć niezależnie od wcześniejszej sesji, kliknięcia czy ustawień filtra. Jeśli filtrowanie, paginacja lub przełączanie zakładek nie aktualizuje adresu w sensowny sposób, konkretne widoki mogą być słabiej śledzone i gorzej oceniane.

Osobną grupę błędów stanowią rozjazdy między tym, co zwraca serwer, a tym, co ostatecznie pokazuje aplikacja po stronie klienta. Błędy hydracji, opóźnione odpowiedzi API oraz różnice między HTML a DOM potrafią skutkować pustą treścią, niepoprawnymi tagami albo pominięciem fragmentów zawartości. W praktyce to jeden z powodów, dla których dynamiczne strony warto testować nie tylko wizualnie, lecz także z perspektywy renderowania przez robota.

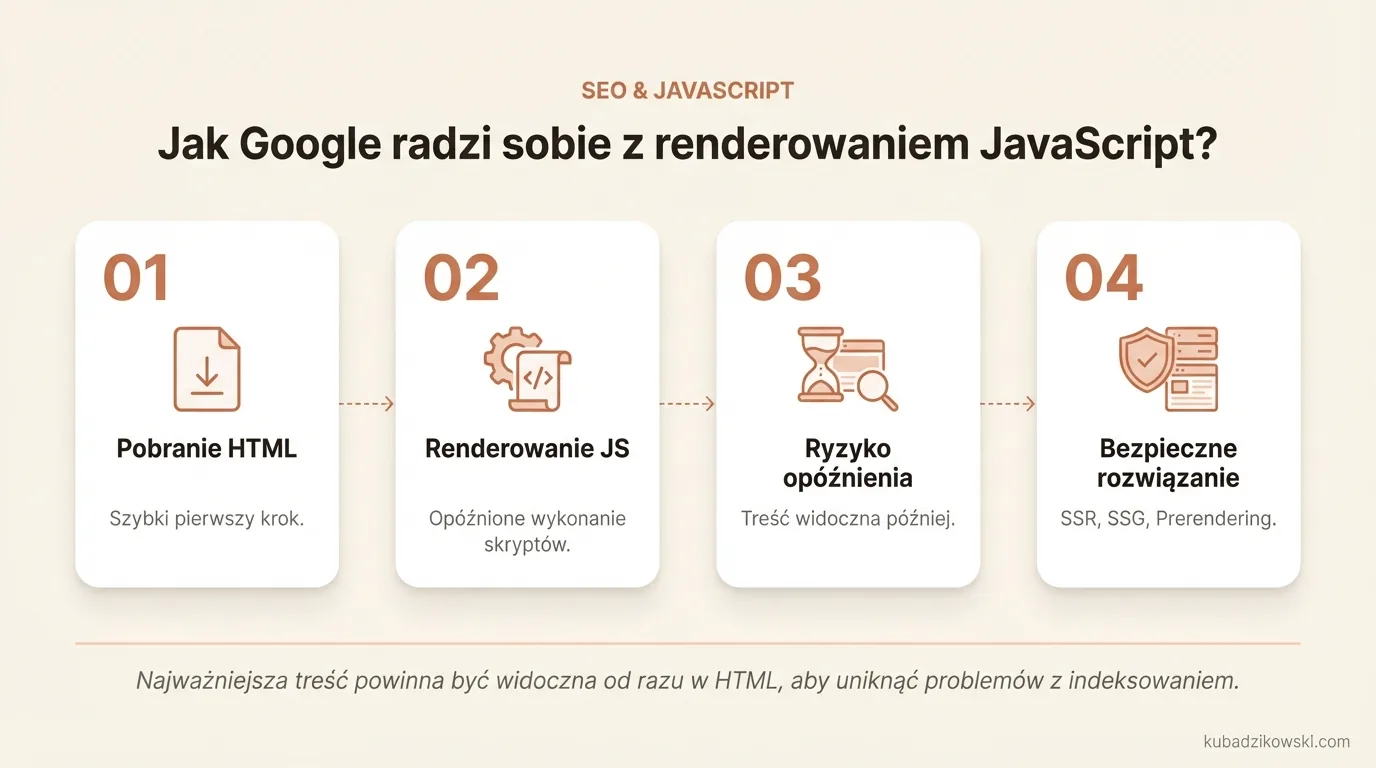

Jak Google radzi sobie z renderowaniem JavaScript?

Google potrafi renderować JavaScript, ale nie oznacza to, że każda treść doładowywana dynamicznie zostanie szybko i prawidłowo zindeksowana. Najpierw robot pobiera surowy HTML, a dopiero później może wykonać renderowanie i odtworzyć widok zbudowany przez skrypty. To istotne rozróżnienie, bo gdy w pierwszym kroku strona jest niemal pusta, część sygnałów SEO bywa oceniana z opóźnieniem albo tylko częściowo.

W praktyce najbezpieczniejsze są wdrożenia, w których najważniejsza treść, nagłówki oraz meta dane są widoczne od razu w HTML albo dostarczane przez SSR, SSG lub prerendering. Jeśli kluczowa zawartość pojawia się dopiero po wykonaniu JavaScript, zwiększasz ryzyko, że Google zobaczy ją później niż użytkownik albo wcale. Dotyczy to szczególnie opisów kategorii, list produktów, treści ofert, paginacji oraz linków wewnętrznych.

Google nie potrzebuje dziś przestarzałych rozwiązań typu hashbang. Liczą się zwykłe, stabilne adresy URL, które można otworzyć bez wcześniejszej interakcji i które zwracają konkretny stan strony. Jeżeli filtr, zakładka albo kolejna porcja wyników działa wyłącznie w pamięci aplikacji, bez osobnego adresu, taki widok jest wyraźnie trudniejszy do indeksacji.

Częstą przeszkodą jest blokowanie zasobów niezbędnych do renderowania. Jeśli robots.txt odcina pliki JS, CSS, obrazy albo endpointy API, robot może nie złożyć strony do postaci, którą widzi użytkownik. Nawet poprawny kod HTML nie wystarczy, jeśli finalna treść zależy od zasobów, których Google nie może pobrać.

Warto też pilnować spójności między tym, co zwraca serwer, tym, co powstaje po renderowaniu, oraz tym, co użytkownik widzi po wejściu na konkretny URL. Rozjazd między HTML a DOM po stronie klienta często kończy się pustą treścią, nieprawidłowym tytułem albo canonicalem wskazującym niewłaściwy stan. Zwykle wynika to z błędów hydracji, timeoutów API oraz niepoprawnie obsłużonych przejść w SPA.

Z perspektywy SEO kluczowe nie jest więc to, czy Google „obsługuje JavaScript”, lecz czy jest w stanie bez zakłóceń odtworzyć najważniejszy stan strony. Im mniej krytycznych elementów zależy od kliknięcia, scrolla lub opóźnionego doładowania, tym mniejsze ryzyko techniczne. Dlatego dynamiczne interfejsy można rozwijać, ale treści odpowiadające za widoczność powinny być podawane możliwie prosto i stabilnie.

Kluczowe etapy oceny i wdrożenia SEO dla stron Ajax

Kluczowe etapy oceny i wdrożenia SEO dla stron Ajax obejmują rozpoznanie, co działa dynamicznie, co jest dostępne dla robota oraz które stany strony faktycznie powinny trafić do indeksu. Taka analiza nie startuje od technologii, tylko od treści i widoków, które mają generować ruch z wyszukiwarki. Dopiero na tej podstawie dobiera się sposób renderowania i reguły indeksacji.

- Inwentaryzacja widoków dynamicznych: ustalenie, które sekcje są ładowane przez Ajax i czy zawierają treść ważną dla SEO.

- Porównanie surowego HTML z DOM po renderze: identyfikacja elementów, których Google może nie zobaczyć od razu.

- Analiza stanów i URL-i: weryfikacja, czy filtry, paginacja, zakładki i warianty mają stabilne, otwieralne adresy.

- Ocena linkowania: potwierdzenie, że przejścia do ważnych widoków odbywają się przez linki możliwe do śledzenia, a nie wyłącznie przez handlery JS.

- Kontrola zasobów renderujących: upewnienie się, że Google może pobrać JS, CSS, obrazy i odpowiedzi API potrzebne do zbudowania treści.

- Decyzja o sposobie renderowania: wybór między SSR, SSG, prerenderingiem a renderowaniem po stronie klienta.

- Ustawienie sygnałów SEO: dopasowanie title, meta description, canonicali, danych strukturalnych i reguł indeksacji do finalnego stanu URL-a.

- Walidacja po wdrożeniu: testy renderowania, analiza logów i kontrola tego, co faktycznie trafia do indeksu.

Na początku dobrze oddzielić elementy istotne biznesowo od dodatków pomocniczych. Jeżeli dynamicznie ładuje się opis kategorii, lista ofert lub treść poradnikowa, taki moduł zazwyczaj powinien być dostępny już przy pierwszym renderze. Gdy Ajax odpowiada jedynie za drobne składniki interfejsu, na przykład sortowanie wizualne albo poboczne widgety, ryzyko SEO jest wyraźnie niższe.

Kolejny etap to ocena poszczególnych stanów strony. Nie każdy filtr ani każda kombinacja parametrów powinna trafiać do indeksu, bo nietrudno w ten sposób wygenerować duplikaty albo podstrony o bardzo niskiej jakości. Dobre wdrożenie nie polega na indeksowaniu wszystkiego, tylko na nadaniu URL-i tym stanom, które mają realną wartość wyszukiwawczą.

Następnie przychodzi czas na decyzję techniczną. W przypadku treści kluczowych najczęściej sprawdzają się SSR, SSG albo prerendering, ponieważ ograniczają zależność od wykonania JavaScript po stronie robota. Renderowanie po stronie klienta warto zostawić tam, gdzie nie ma ono znaczenia dla indeksacji, linkowania ani odczytu najważniejszych elementów strony.

Na końcu potrzebna jest walidacja w praktyce. Weryfikuje się nie tylko to, czy strona „działa”, lecz także czy Google odczytuje właściwy tytuł, treść, canonical, linki oraz stan po wejściu na konkretny adres. Problemy z Ajax zwykle ujawniają się dopiero na poziomie konkretnego szablonu, filtra albo komponentu, dlatego test po wdrożeniu jest obowiązkowy.

W praktyce to właśnie ten etap rozstrzyga, czy dynamiczna strona realnie wspiera SEO, czy jedynie sprawia wrażenie nowoczesnej. Jeśli ważne treści są dostępne, linkowalne i przypisane do stabilnych URL-i, Ajax nie jest przeszkodą dla Google. Jeśli nie, źródłem kłopotów nie będzie sam skrypt, tylko architektura całego widoku.

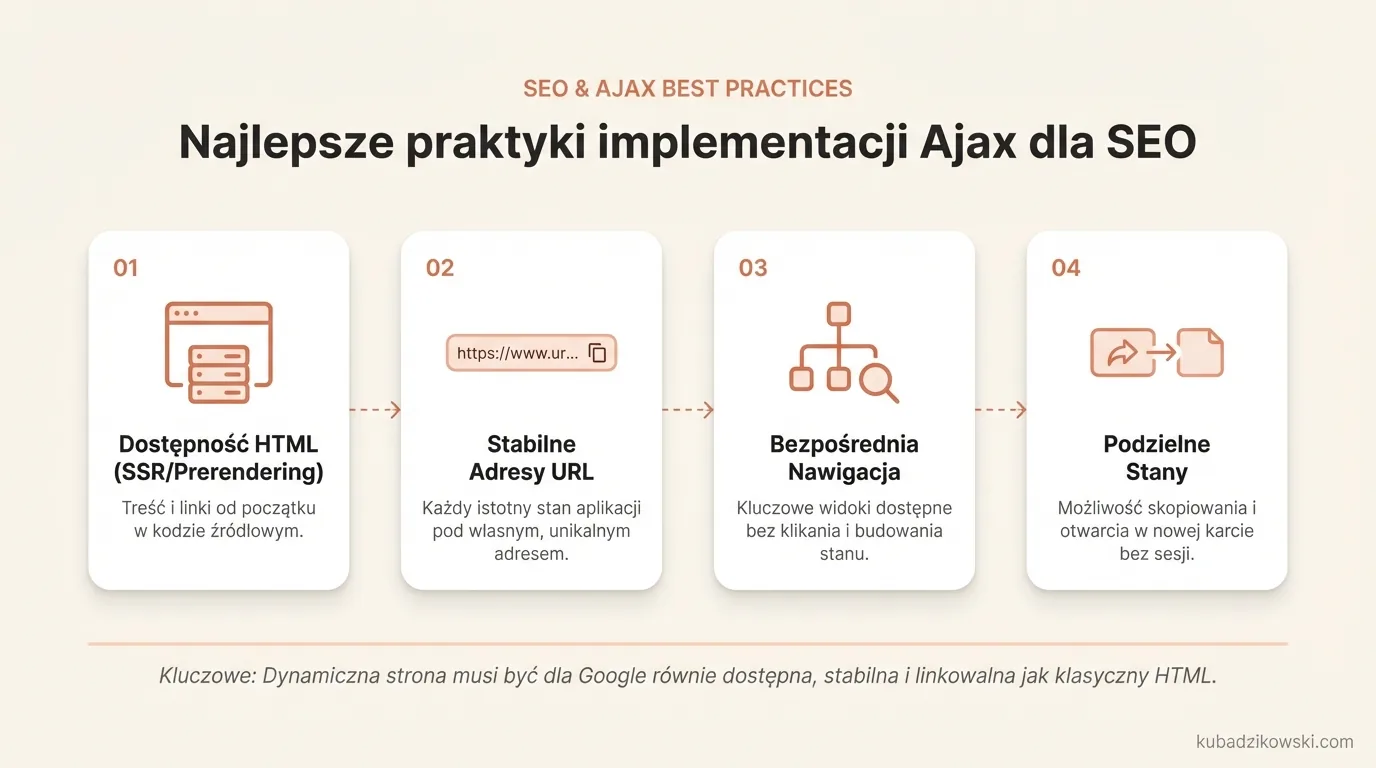

Najlepsze praktyki implementacji Ajax dla SEO

Najlepsze praktyki sprowadzają się do tego, by dynamiczna strona była dla Google dostępna tak jak klasyczna strona HTML, z treścią, linkami i stabilnym adresem URL. Jeżeli dany widok ma pozyskiwać ruch z wyszukiwarki, powinien dać się otworzyć bez wcześniejszego klikania, scrollowania i budowania stanu wyłącznie w przeglądarce. Najważniejsze podstrony i stany warto dostarczać w HTML od początku albo przez SSR, SSG lub prerendering.

Każdy istotny stan aplikacji powinien mieć własny, przejrzysty adres. Dotyczy to kategorii, paginacji, kart produktów, ważnych filtrów i wariantów, które faktycznie odpowiadają na odmienne intencje wyszukiwania. Taki adres musi dać się skopiować, otworzyć w nowej karcie i odtworzyć bez aktywnej sesji użytkownika.

Nawigacja do kluczowych widoków powinna opierać się na linkach, a nie wyłącznie na obsłudze kliknięć w JavaScript. W praktyce oznacza to, że przejście do kategorii, kolejnej strony listy czy szczegółu oferty nie może zależeć tylko od kodu klienta, bez standardowego odnośnika. Jeśli crawler nie ma jasnej ścieżki dojścia do stanu strony, indeksacja będzie słabsza albo przypadkowa.

Meta dane muszą odpowiadać finalnemu stanowi URL-a, a nie jedynie ekranowi startowemu aplikacji. To samo odnosi się do canonicala, nagłówków i danych strukturalnych. Częsty błąd polega na tym, że po zmianie widoku treść się aktualizuje, ale title i canonical pozostają z poprzedniego stanu.

Warto dopilnować, by wszystkie zasoby potrzebne do zbudowania widoku były dostępne. Jeśli JS, CSS, obrazy lub odpowiedzi z API są blokowane, bot może trafić na pusty albo nie w pełni złożony ekran. Nie oceniaj wdrożenia przez pryzmat tego, jak wygląda w przeglądarce developera, tylko tego, co realnie da się wyrenderować i zaindeksować z zewnątrz.

W dynamicznych listingach dobrze jest oddzielić stany warte indeksowania od tych czysto użytkowych. Filtr, który faktycznie tworzy odrębną ofertę lub kategorię, może mieć własny URL i własny zestaw sygnałów SEO. Dziesiątki kombinacji bez unikalnej wartości lepiej przyciąć przez canonical, noindex albo rezygnację z aktywnego linkowania wewnętrznego.

Typowe błędy związane z Ajax i ich unikanie

Najczęstsze problemy z Ajax pojawiają się wtedy, gdy kluczowa treść istnieje dopiero po interakcji użytkownika albo nie ma własnego, odtwarzalnego adresu. W takiej sytuacji Google może nie zobaczyć pełnej zawartości, mimo że z perspektywy użytkownika wszystko działa bez zarzutu. Zwykle nie chodzi o samą technologię, lecz o sposób, w jaki została użyta.

Bardzo typowy błąd to schowanie istotnej treści za zakładką, akordeonem, filtrem lub przyciskiem „pokaż więcej” bez alternatywnego URL-a. Jest to szczególnie ryzykowne w przypadku opisów kategorii, list produktów, recenzji oraz treści poradnikowych, które dociągają się dopiero po kliknięciu. Jeśli dana sekcja ma być indeksowana, nie powinna zależeć wyłącznie od zdarzenia użytkownika.

Drugą pułapką są stany aplikacji, które zmieniają widok, ale nie aktualizują adresu albo zapisują go w formie bezużytecznej dla indeksacji. Gdy filtr, sortowanie czy paginacja żyją wyłącznie w pamięci przeglądarki, nie da się ich sensownie linkować ani otworzyć ponownie. W efekcie bot zwykle indeksuje jedynie stan początkowy, a pozostałe warianty widoku pozostają poza zasięgiem.

Często trafia się także nieskończony scroll bez paginacji dostępnej pod URL-ami. Dla użytkownika to wygodne rozwiązanie, ale z punktu widzenia SEO utrudnia dotarcie do dalszych elementów listy. Jeśli brakuje alternatywy w postaci kolejnych stron lub innych linkowalnych stanów, głębsza zawartość ma mniejsze szanse na pełne odkrycie.

Osobny zestaw błędów wynika z rozjazdu między HTML, renderem a stanem po stronie klienta. Strona może wyglądać poprawnie po kilku sekundach, a wcześniej zwracać pusty kontener, ogólny title albo nieaktualny canonical. Błędy hydracji, timeouty API oraz opóźnione doładowania potrafią sprawić, że bot zobaczy inną stronę niż użytkownik.

Ryzykowne bywa również blokowanie zasobów potrzebnych do renderowania. Gdy robots.txt odcina pliki JS, CSS albo endpointy z danymi, Google nie odtworzy finalnego widoku. Taki kłopot często wychodzi na jaw dopiero po wdrożeniu, dlatego warto analizować logi serwera, podgląd zindeksowanej strony oraz konkretne szablony, zamiast opierać się wyłącznie na stronie głównej.

Na końcu pojawia się jeszcze błąd strategiczny: indeksowanie wszystkiego, co aplikacja generuje dynamicznie. Nie każda kombinacja filtrów, parametrów i widoków powinna trafiać do indeksu. Zwykle lepsze efekty daje wskazanie kilku wartościowych stanów do indeksacji niż wpuszczanie setek technicznych duplikatów.

Monitorowanie i optymalizacja stron dynamicznych po wdrożeniu

Monitorowanie i optymalizacja stron dynamicznych po wdrożeniu sprowadza się do sprawdzenia, czy Google rzeczywiście widzi, renderuje i indeksuje ten sam stan strony, który ogląda użytkownik. Po publikacji nie wystarczy jedynie potwierdzić, że JavaScript „działa”. Trzeba upewnić się, że kluczowa treść pojawia się w HTML lub po renderze bez błędów, a ważne URL-e faktycznie trafiają do indeksu. W praktyce kłopoty z Ajax najczęściej wychodzą dopiero na poziomie konkretnych szablonów, filtrów albo komponentów, a nie całej witryny.

Pierwszy obszar kontroli obejmuje indeksację i renderowanie poszczególnych typów stron. Warto cyklicznie weryfikować w Google Search Console, które adresy są zindeksowane, które są odkryte, ale niezindeksowane, oraz które mają problemy z pobraniem lub duplikacją. Dla stron dynamicznych szczególnie istotne jest zestawienie tego, co zwraca serwer, z tym, co pojawia się po renderowaniu JavaScript.

Drugi obszar to zgodność treści i znaczników SEO z finalnym stanem URL-a. Gdy aplikacja podmienia zawartość po stronie klienta, łatwo o sytuację, w której tytuł, canonical, nagłówek H1 albo dane strukturalne pozostają z wersji początkowej. Jeżeli metadata nie aktualizują się razem z treścią, Google może indeksować inny dokument, niż ten, który chcesz pozycjonować.

Duże znaczenie mają także logi serwera oraz odpowiedzi zasobów używanych do renderowania. Logi pokazują, czy Googlebot odwiedza właściwe URL-e, jak często wraca do kluczowych sekcji i czy natrafia na błędy 4xx, 5xx albo timeouty. Przy Ajax warto patrzeć nie tylko na dokument HTML, ale również na pliki JS, CSS oraz endpointy API, bez których widok bywa niepełny lub pusty.

Kolejny punkt to kontrola stanów generowanych przez filtry, paginację i komponenty interaktywne. Po wdrożeniu często wychodzi na jaw, że część kombinacji parametrów zaczyna być linkowana wewnętrznie i trafia do indeksu, mimo że nie wnosi unikalnej wartości. To jest moment, w którym trzeba przesądzić, które stany mają być indeksowane, a które należy ograniczyć przez canonical, noindex lub zmianę linkowania.

W optymalizacji stron dynamicznych warto też śledzić błędy hydracji i opóźnione doładowania treści. Strona może wyglądać poprawnie dla użytkownika z szybką przeglądarką, ale bot może zobaczyć pusty kontener, fallback albo niekompletny moduł, jeśli API odpowiada zbyt wolno. Taki problem nie zawsze wyjdzie w zwykłym teście ręcznym, dlatego dobrze jest porównywać surowy HTML, wyrenderowany DOM i faktycznie zindeksowaną wersję strony.

Dobrym rozwiązaniem jest śledzenie zmian na poziomie szablonów, a nie wyłącznie całej domeny. Gdy kłopot dotyczy kart produktów, stron kategorii z filtrami lub listingów ładowanych asynchronicznie, warto rozpatrywać te zbiory osobno. W SEO dla aplikacji dynamicznych najwięcej wnosi praca na powtarzalnych wzorcach błędów, bo pojedyncza usterka komponentu potrafi zepsuć setki lub tysiące adresów.

Optymalizacja po wdrożeniu powinna kończyć się konkretną decyzją techniczną, a nie samą diagnozą. Jeśli kluczowa treść nadal pojawia się zbyt późno, najczęściej trzeba przenieść ją do SSR, SSG albo prerenderingu. Jeżeli problem leży w nawigacji, należy dodać linkowalne URL-e i semantyczne odnośniki, zamiast opierać przejścia wyłącznie na zdarzeniach JavaScript.

Najlepsze rezultaty daje stały cykl działań: kontrola renderowania, kontrola indeksacji, korekta architektury i ponowna walidacja. W dynamicznych serwisach nawet niewielka zmiana frontendu może odbić się na widoczności organicznej, choć zespół produktowy nie zauważy tego od razu. Dlatego po każdym większym wdrożeniu warto sprawdzić nie tylko działanie funkcji, ale też to, czy Google nadal widzi pełną, spójną i indeksowalną wersję strony.