DNS to system, który przekłada nazwę domeny na adres IP oraz inne dane potrzebne do połączenia ze stroną lub usługą. Bez niego przeglądarka ani robot Google nie wiedzą, z jakim serwerem mają nawiązać komunikację. To jeden z tych elementów infrastruktury, których na co dzień się nie zauważa, dopóki coś nie zacznie działać wolniej albo niestabilnie. DNS nie jest bezpośrednim czynnikiem rankingowym SEO, ale realnie wpływa na dostępność strony, moment startu ładowania i bezpieczeństwo zmian technicznych. Widać to szczególnie przy migracjach hostingu, domeny, CDN oraz konfiguracji HTTPS. W praktyce najwięcej kłopotów wynika nie z samej koncepcji DNS, tylko z błędnych rekordów, źle ustawionego TTL i braku spójności z resztą infrastruktury.

Jak działa DNS i dlaczego jest kluczowy dla funkcjonowania strony?

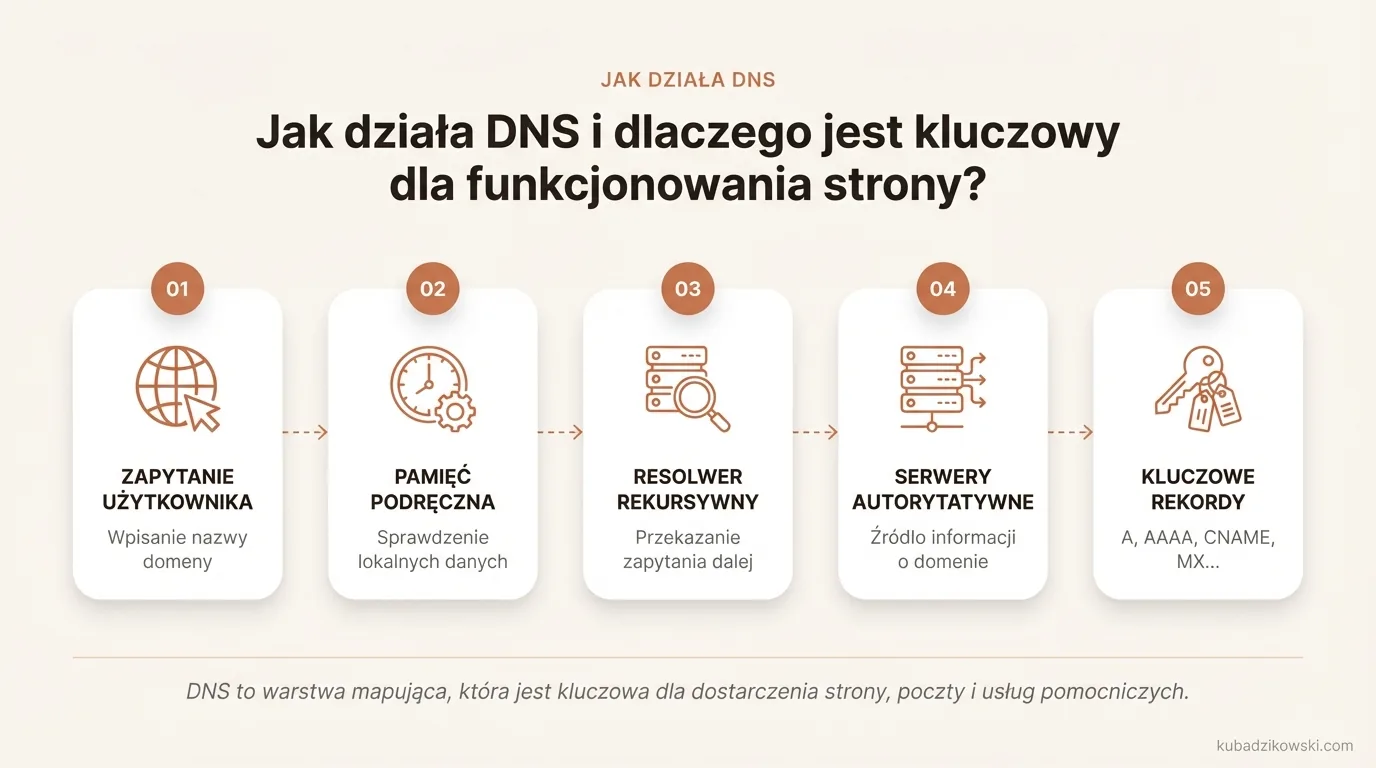

DNS pełni rolę warstwy, która mapuje nazwę domeny na adres IP oraz pozostałe informacje potrzebne do dostarczenia strony, poczty i usług pomocniczych. Gdy użytkownik wpisuje adres witryny, system najpierw zagląda do lokalnej pamięci podręcznej przeglądarki i systemu operacyjnego. Jeśli nie ma tam odpowiedzi, zapytanie trafia do resolvera rekursywnego, który przechodzi przez serwery root, następnie TLD, a na końcu dociera do serwerów autorytatywnych danej domeny. Dopiero wtedy zwracany jest rekord niezbędny do zestawienia połączenia.

Dla strony WWW kluczowe są rekordy A i AAAA wskazujące adres IPv4 lub IPv6 oraz CNAME, który tworzy alias do innej nazwy. Poza tym istotne są rekordy NS odpowiadające za delegację strefy, SOA opisujący strefę, TXT wykorzystywane do weryfikacji i polityk oraz MX dla poczty. Jeśli któryś z ważnych rekordów jest błędny albo niepełny, strona może działać z przerwami mimo poprawnej aplikacji i serwera.

Obecnie DNS często nie kieruje bezpośrednio na serwer aplikacji, lecz na warstwę pośrednią, taką jak CDN, reverse proxy albo usługa bezpieczeństwa. Oznacza to, że użytkownik najpierw trafia do infrastruktury pośredniczącej, a dopiero ona przekazuje ruch do originu. Z perspektywy właściciela witryny liczy się więc nie tylko to, czy rekord istnieje, ale również czy prowadzi do właściwej warstwy i czy cały łańcuch pozostaje spójny z certyfikatem TLS, przekierowaniami oraz konfiguracją hosta.

DNS jest kluczowy dla funkcjonowania strony, ponieważ od niego zaczyna się każda próba wejścia na witrynę, zarówno przez użytkownika, jak i przez robota wyszukiwarki. Gdy pojawiają się błędy typu NXDOMAIN, SERVFAIL, nieprawidłowa delegacja NS albo niespójne rekordy A i AAAA, skutkiem bywają przerwy w dostępności i kłopoty z crawlem. W SEO najgroźniejsze nie są pojedyncze opóźnienia DNS, lecz okresowe błędy hosta oraz źle przeprowadzone zmiany domeny, subdomeny lub hostingu. To wtedy najłatwiej stracić część ruchu przez problemy z indeksacją, a nie przez sam ranking.

W jaki sposób DNS wpływa na szybkość ładowania strony?

DNS wpływa na tempo ładowania strony, ponieważ przesądza o tym, jak szybko przeglądarka odnajdzie właściwy host i nawiąże pierwsze połączenie. Zanim zacznie się pobieranie HTML, musi zakończyć się lookup DNS, a dopiero później dochodzi do zestawienia TCP lub QUIC oraz negocjacji TLS. Jeżeli ten krok się przeciąga, opóźnia cały start ładowania. Nie spowalnia to renderowania wprost, ale przesuwa moment, w którym strona w ogóle może zacząć się pobierać.

Najwięcej zależy tu od czasu odpowiedzi resolvera, trafień w cache oraz liczby zapytań potrzebnych do ustalenia adresu. Gdy odpowiedź DNS jest w pamięci podręcznej, ten etap bywa praktycznie niewidoczny. Kiedy cache nie pomaga, na znaczeniu zyskuje jakość autorytatywnych serwerów DNS, długość ścieżki odpowiedzi oraz ewentualne dodatkowe przeskoki, na przykład przez zbędne CNAME. Łańcuchy CNAME i niepotrzebnie złożona konfiguracja zwykle nie zabijają wydajności, ale potrafią dorzucić drobne opóźnienia, które sumują się na starcie.

Na szybkość wpływa również poprawność ustawień IPv4 i IPv6. Jeśli domena ma rekord AAAA, ale usługa pod IPv6 działa słabo albo niestabilnie, część użytkowników może odczuwać opóźnienia lub mieć kłopot z połączeniem. Podobnie jest wtedy, gdy DNS wskazuje CDN lub proxy, ale routing do originu jest nieprawidłowy. W takiej sytuacji problem wygląda jak kłopot z DNS, choć rzeczywista przyczyna leży głębiej w infrastrukturze.

W praktyce warto mierzyć nie tylko sam czas lookup DNS, lecz także jego przełożenie na TTFB i początek renderowania. Jeżeli lookup jest szybki, a strona nadal ładuje się wolno, przyczyna zwykle tkwi w serwerze, aplikacji, bazie danych, zasobach frontendowych albo w ustawieniach cache. DNS jest ważny dla szybkiego startu, ale nie jest główną dźwignią wydajności całej strony. Dlatego optymalizację DNS lepiej traktować jako element większej układanki, a nie jako zastępstwo pracy nad backendem i frontendem.

Jak DNS oddziałuje na SEO i dostępność strony dla botów?

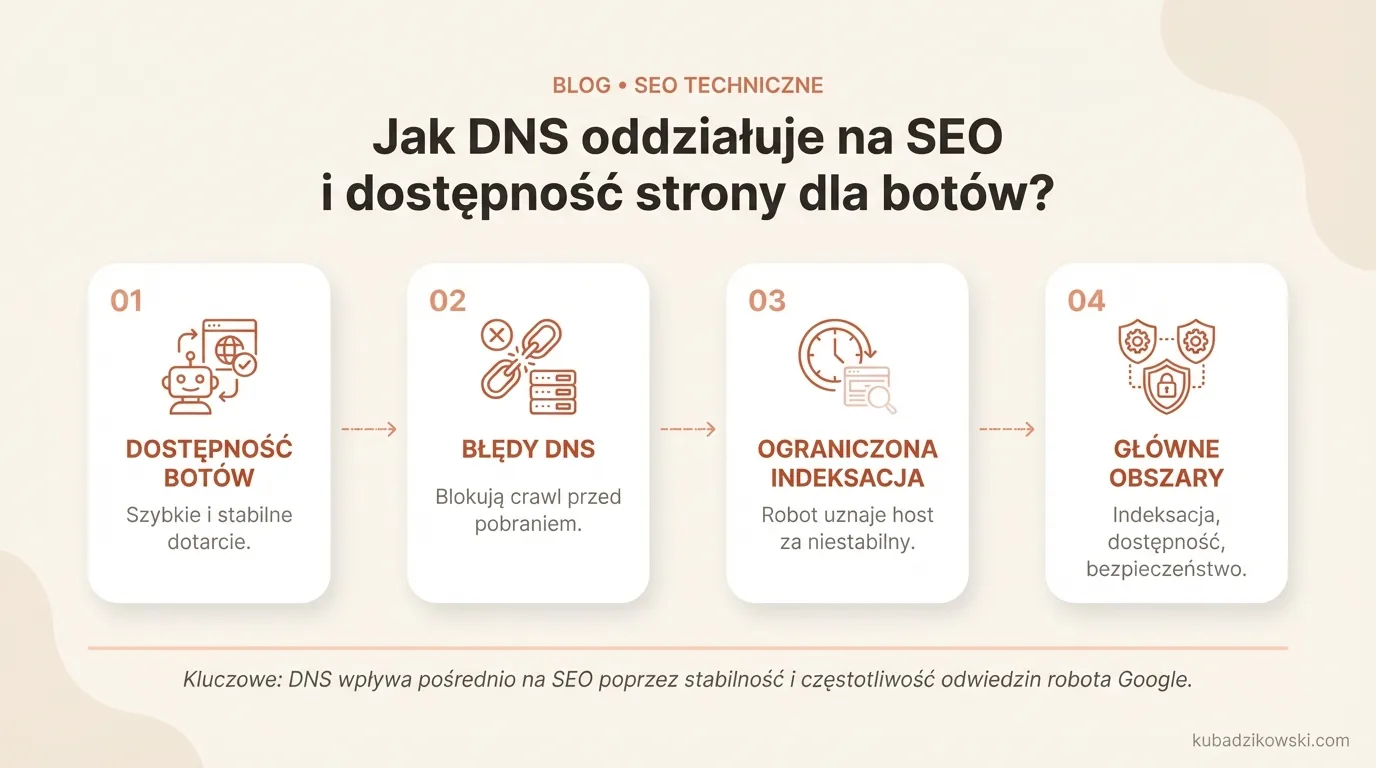

DNS wpływa na SEO pośrednio, bo rozstrzyga, czy robot Google dotrze do strony szybko, stabilnie i pod właściwy adres. Sam DNS nie jest czynnikiem rankingowym, ale błędy na tym etapie potrafią zatrzymać crawl jeszcze przed pobraniem HTML. Jeśli domena okresowo nie rozwiązuje się poprawnie, bot widzi problem z hostem, a nie jedynie chwilowe spowolnienie. W praktyce zły DNS uderza głównie w indeksację, dostępność i bezpieczeństwo migracji.

Najbardziej dotkliwe są błędy typu NXDOMAIN, SERVFAIL, timeouty oraz niespójne odpowiedzi z różnych serwerów nazw. Gdy takie problemy wracają cyklicznie, robot może ograniczyć częstotliwość odwiedzin, uznając host za niestabilny. To jest szczególnie istotne przy dużych serwisach, gdzie każda utracona sesja crawlu oznacza mniej sprawdzonych adresów URL.

Wiele problemów SEO wychodzi na jaw przy zmianie hostingu, domeny, subdomeny lub CDN. Gdy delegacja NS jest ustawiona błędnie, TTL ma zbyt długi czas albo brakuje rekordów dla wersji www i non-www, bot może raz trafiać na nową, a raz na starą konfigurację. Zmiany w DNS warto spinać z przekierowaniami 301, certyfikatem TLS, canonicalami i mapą witryny, bo sama poprawna odpowiedź DNS nie przesądza o prawidłowej indeksacji.

W nowszych wdrożeniach DNS często nie prowadzi ruchu bezpośrednio na serwer aplikacji, tylko na CDN albo reverse proxy. To oznacza, że sam poprawny rekord nie zamyka diagnostyki. Trzeba jeszcze potwierdzić, czy warstwa pośrednia potrafi połączyć się z originem, zwraca właściwy host i poprawnie obsługuje HTTPS. Częsty błąd w praktyce to poprawny rekord A przy błędnym rekordzie AAAA, przez co część botów i użytkowników trafia na niedziałający IPv6.

Jeśli chcesz ocenić, jak DNS odbija się na SEO, patrz nie tylko na strefę, ale również na symptomy. Za czerwone flagi uchodzą nagłe wzrosty błędów hosta, spadek liczby pobrań w logach, okresowe kłopoty z dostępnością w Search Console oraz rozjazd między wersją domeny w DNS a wersją docelową po przekierowaniach. Najbardziej podstępne są błędy okresowe, bo długo pozostają niezauważone, a w praktyce zjadają crawl budget.

Jakie są najważniejsze rekordy DNS i ich znaczenie dla strony?

Najważniejsze rekordy DNS dla strony to A, AAAA, CNAME, NS, SOA, TXT i czasem MX, bo każdy z nich odpowiada za inny fragment działania domeny. Dla właściciela strony liczy się nie tylko to, czy rekord w ogóle istnieje, ale też czy prowadzi do właściwej usługi i pozostaje spójny z resztą ustawień. W praktyce właśnie na poziomie rekordów najczęściej zostają stare wpisy po migracji albo brakuje rekordów dla jednej z wersji domeny.

- A – wskazuje adres IPv4 serwera lub usługi obsługującej domenę.

- AAAA – wskazuje adres IPv6. Jeśli jest ustawiony, usługa pod tym adresem musi realnie działać.

- CNAME – tworzy alias do innej nazwy hosta, często używany dla www, CDN lub usług zewnętrznych.

- NS – określa, które serwery są autorytatywne dla strefy domeny.

- SOA – zawiera podstawowe informacje o strefie i jej administracji.

- TXT – służy do weryfikacji usług, polityk i konfiguracji pomocniczych, np. dla narzędzi, poczty lub bezpieczeństwa.

- MX – odpowiada za kierowanie poczty. Nie wpływa na stronę bezpośrednio, ale jest krytyczny dla działania domeny jako całości.

Najwięcej uwagi zwykle wymagają rekordy A, AAAA i CNAME, bo to one kierują ruch we właściwe miejsce. Gdy domena główna i wariant www są ustawione inaczej, niż zakłada serwer lub CDN, łatwo o błędy przekierowań, kłopoty z certyfikatem albo częściową niedostępność. Po każdej zmianie warto osobno sprawdzić apex domeny, www oraz wszystkie istotne subdomeny, a nie ograniczać się do strony głównej.

Rekordy NS i SOA są mniej rzucające się w oczy, ale przy migracji i delegacji strefy mają znaczenie krytyczne. Jeśli serwery autorytatywne są błędnie wskazane albo odpowiadają niespójnie, cała domena może działać chwiejnie, nawet gdy rekordy A czy CNAME w panelu wyglądają poprawnie. To właśnie dlatego po zmianie operatora DNS lepiej sprawdzać odpowiedzi bezpośrednio z zewnątrz, zamiast polegać wyłącznie na tym, co pokazuje panel administracyjny.

Rekordy TXT często traktuje się jako drugorzędne, a jednak bez nich łatwo stracić weryfikację usługi, integrację z CDN albo poprawne działanie narzędzi zewnętrznych. Z kolei rekordy MX nie wpływają na SEO, natomiast ich przypadkowe usunięcie podczas zmiany strefy bywa typowym skutkiem ubocznym migracji. Najbezpieczniej patrzeć na strefę DNS jak na zestaw naczyń połączonych: strona, poczta, weryfikacje, CDN i certyfikaty powinny być przenoszone łącznie.

Jak przygotować się do migracji domeny, aby uniknąć problemów z DNS?

Przygotowanie do migracji domeny obejmuje przede wszystkim rekordy, TTL oraz kolejność zmian, bo to te elementy najczęściej przesądzają o płynnym przejściu albo o przerwach w dostępności. Na początek zrób pełną inwentaryzację strefy DNS: apex domeny, wersję z www, subdomeny, rekordy dla CDN, API, poczty, weryfikacji usług i certyfikatów. W praktyce kłopoty pojawiają się nie tyle na stronie głównej, co na pominiętej subdomenie albo w starym rekordzie używanym przez zewnętrzną usługę. Najbezpieczniejsza migracja to taka, w której dokładnie wiesz, które rekordy są krytyczne i od jakich systemów zależą.

Kolejny etap to praca z TTL z odpowiednim wyprzedzeniem, a nie dopiero w chwili przełączenia. Jeśli rekordy mają wysoki TTL, część użytkowników i botów jeszcze przez wiele godzin może trafiać na stary adres, mimo że zmiana została już wdrożona. Dlatego przed migracją warto wcześniej obniżyć TTL, poczekać aż nowa wartość zacznie obowiązywać w cache resolverów, a dopiero potem przełączyć rekordy. Zbyt późne obniżenie TTL nie daje w praktyce kontroli nad propagacją.

Przed właściwym przełączeniem trzeba zweryfikować spójność DNS z warstwą aplikacyjną i bezpieczeństwem. Nowy adres musi poprawnie obsługiwać HTTP i HTTPS, certyfikat powinien obejmować właściwe hosty, a przekierowania 301 mają prowadzić do finalnej wersji domeny bez pętli oraz zbędnych przeskoków. Jeśli strona działa za CDN lub reverse proxy, testuj nie tylko sam rekord DNS, lecz także routing do origin, nagłówki host i zachowanie cache. Sam poprawny rekord nie pomoże, gdy backend odpowiada nieprawidłowo.

Dobrze zaplanowana migracja powinna uwzględniać:

- wykonanie kopii obecnej strefy DNS oraz zapis bieżących wartości rekordów,

- obniżenie TTL przed wprowadzeniem zmian,

- sprawdzenie rekordów A, AAAA, CNAME, NS, TXT oraz wpisów wykorzystywanych przez CDN lub pocztę,

- przygotowanie przekierowań 301 i certyfikatów TLS jeszcze przed przełączeniem ruchu,

- scenariusz wycofania zmian, jeśli nowa konfiguracja zacznie zwracać błędy.

Po migracji nie warto poprzestawać na tym, że strona po prostu otwiera się w przeglądarce. Należy zweryfikować odpowiedzi serwerów autorytatywnych DNS, działanie wariantów www i non-www, zgodność IPv4 i IPv6, status HTTPS oraz dostępność z różnych lokalizacji. Dobrą praktyką jest też obserwacja logów serwera, błędów hosta w narzędziach SEO oraz zachowania botów. Najwięcej strat powodują nie tyle same zmiany DNS, co brak testów po wdrożeniu i brak planu awaryjnego.

Jeżeli migracja obejmuje zmianę domeny albo układu hostów, zsynchronizuj DNS z przekierowaniami, canonicalami, mapami witryny oraz ustawieniami w Search Console. W przeciwnym razie bot może trafiać na adres, który rozwiązuje się poprawnie, a jednocześnie dostawać niespójne sygnały indeksacyjne. To nie jest wyłącznie techniczny szczegół, lecz element przesądzający o tym, czy migracja zostanie odebrana jako uporządkowana i stabilna.

Jakie błędy DNS najczęściej wpływają na wydajność strony?

Na wydajność strony najczęściej wpływają pomyłki, które wydłużają czas odnalezienia hosta albo wywołują okresowe problemy z połączeniem jeszcze przed pobraniem pierwszego bajtu. DNS nie determinuje całego czasu ładowania, ale potrafi opóźnić sam start połączenia. Kiedy ten etap działa nierówno, użytkownik i bot odbierają to jako wolną lub chwilowo niedostępną stronę. DNS pogarsza wydajność głównie wtedy, gdy utrudnia rozpoczęcie połączenia, a nie wtedy, gdy strona jest ciężka.

Jednym z najczęstszych kłopotów są zbyt rozbudowane albo zbędne ścieżki rozwiązywania nazwy. Dotyczy to zwłaszcza łańcuchów CNAME, w których jedno odwołanie prowadzi do kolejnego, a każde wymaga dodatkowego zapytania. W praktyce kilka takich kroków potrafi dorzucić opóźnienie, szczególnie przy pierwszym wejściu bez cache. Podobnie działa przesadna liczba zewnętrznych hostów dla zasobów statycznych, bo każdy nowy host wymaga osobnego lookupu DNS.

Drugą grupę błędów stanowią problemy z serwerami autorytatywnymi oraz delegacją NS. Gdy serwery nazw odpowiadają wolno, są przeciążone albo zwracają niespójne odpowiedzi, resolver potrzebuje więcej czasu, aby uzyskać właściwy rekord. Jeszcze gorzej, jeśli część serwerów działa prawidłowo, a część zwraca okresowe błędy, ponieważ wtedy problem bywa trudny do wychwycenia i dotyczy tylko części użytkowników. Taki stan odbija się nie tylko na szybkości, ale również na stabilności crawl.

Coraz częściej kłopoty biorą się z nieprawidłowo ustawionego IPv6. Kiedy domena ma rekord AAAA, ale usługa pod tym adresem nie działa poprawnie, część klientów najpierw próbuje połączenia po IPv6, a dopiero po nieudanej próbie przełącza się na IPv4. To potrafi wydłużyć wejście na stronę albo wywoływać pozornie losowe timeouty. Jeśli publikujesz rekord AAAA, upewnij się, że cały tor połączenia przez IPv6 rzeczywiście działa.

Na wydajność wpływają również błędy, które na pierwszy rzut oka wyglądają na drobnostki: brak rekordu dla wersji www lub apex, nieaktualne wpisy po migracji, rozjazd między DNS a certyfikatem TLS oraz zbyt długi TTL podczas napraw. Długi TTL sam w sobie nie spowalnia strony, ale utrudnia usuwanie błędów, bo błędna odpowiedź dłużej zostaje w cache resolverów. W efekcie awaria, którą technicznie usunięto już na serwerze DNS, nadal bywa widoczna u części użytkowników.

W praktyce warto mierzyć nie tylko pełny czas ładowania, lecz także konkretne sygnały związane z DNS: czas lookupu, błędy rozwiązywania nazw, różnice między IPv4 i IPv6 oraz liczbę zapytań dla kluczowych hostów. Jeśli strona działa za CDN, sprawdź też, czy DNS kieruje ruch do właściwej warstwy pośredniej i czy origin jest osiągalny tą ścieżką. Wiele problemów z wydajnością wygląda jak „wolny DNS”, a w rzeczywistości wynika z niespójności między DNS, proxy i serwerem źródłowym.

Jak optymalizować DNS, aby poprawić czas odpowiedzi i stabilność strony?

Optymalizacja DNS sprowadza się do uproszczenia ścieżki rozwiązywania nazw, wyboru stabilnej usługi autorytatywnej i pilnowania, aby rekordy były zgodne z faktyczną konfiguracją strony. Największą różnicę robi usunięcie zbędnych elementów, które wydłużają lookup albo powodują okresowe błędy. W praktyce chodzi o to, by domena zawsze szybko zwracała właściwy adres i prowadziła do działającej warstwy CDN, proxy lub serwera. Dobrze ustawiony DNS nie przyspieszy całego renderowania strony, ale skróci moment rozpoczęcia połączenia i ograniczy ryzyko niedostępności.

Pierwszy krok to uporządkowanie rekordów. Warto skrócić niepotrzebne łańcuchy CNAME, usunąć stare wpisy po migracjach i upewnić się, że rekordy dla wersji z www, bez www oraz istotnych subdomen wskazują dokładnie tam, gdzie powinny. Im mniej niejasności i pośrednich przeskoków, tym mniejsze opóźnienie oraz mniejsze ryzyko, że część użytkowników lub botów dostanie nieaktualną odpowiedź.

Duże znaczenie ma także sam operator DNS. Dla serwisu firmowego lub sklepu lepiej wybrać dostawcę, który ma stabilną infrastrukturę, szybkie odpowiedzi z różnych regionów i dobrą odporność na awarie. Jeśli strona obsługuje ruch międzynarodowy, warto sprawdzić rzeczywisty czas odpowiedzi DNS z kilku lokalizacji, a nie wyłącznie z własnego komputera. Słaby hosting DNS potrafi pogorszyć dostępność strony nawet wtedy, gdy serwer aplikacji działa poprawnie.

Kolejny element to TTL, czyli czas przechowywania odpowiedzi w cache. Przy stabilnym ustawieniu TTL nie powinien być przesadnie niski, bo wtedy więcej zapytań trafia na serwery DNS i łatwiej wychwycić każdą, nawet krótką, niestabilność. Natomiast przed planowaną zmianą hostingu, CDN lub adresu IP warto obniżyć TTL z wyprzedzeniem, a po zakończeniu prac wrócić do sensownego poziomu. Zbyt długi TTL opóźnia wprowadzanie poprawek, a zbyt krótki niepotrzebnie podnosi wrażliwość na problemy po drodze.

Trzeba też pilnować spójności IPv4 i IPv6. Jeśli publikujesz rekord AAAA, usługa musi realnie działać poprawnie po IPv6: na właściwym hoście, z prawidłowym certyfikatem i poprawną odpowiedzią aplikacji. Częsty błąd polega na tym, że IPv4 działa bez zarzutu, a IPv6 prowadzi do starego serwera, niewłaściwego proxy albo w ogóle nie odpowiada. Taka rozbieżność potrafi pogarszać dostępność i wydłużać start połączenia u części użytkowników oraz botów.

Przy stronach działających za CDN lub reverse proxy DNS musi iść w parze z resztą warstwy dostarczania. Rekord może prawidłowo wskazywać usługę pośrednią, ale jeśli certyfikat nie obejmuje hosta, routing do origin jest błędny albo przekierowania się rozjeżdżają, użytkownik i robot wciąż zobaczą problem. Sam poprawny DNS nie naprawi złej konfiguracji CDN, HTTPS, hosta origin ani przekierowań.

Optymalizacja bez pomiaru zwykle kończy się zgadywaniem. Warto obserwować czas DNS lookup, błędy typu NXDOMAIN i SERVFAIL, odpowiedzi autorytatywne oraz zgodność rekordów A i AAAA. Dobrym nawykiem są też regularne testy zewnętrzne po każdej zmianie: wersji www i non-www, HTTP i HTTPS, działania z różnych lokalizacji oraz dostępu dla botów. Najbardziej praktyczny test DNS to nie sam rekord, tylko to, czy domena konsekwentnie prowadzi do działającej strony we wszystkich krytycznych wariantach.

Na koniec warto przyjąć prostą zasadę operacyjną: mniej improwizacji, więcej kontroli zmian. Każda modyfikacja strefy powinna mieć właściciela, zapisany zakres, plan cofnięcia i szybkie testy po wdrożeniu. Wtedy DNS staje się przewidywalną warstwą infrastruktury, a nie źródłem trudnych do namierzenia awarii.