Aktualizacje algorytmu Google są stałym elementem SEO, ale w praktyce liczy się nie to, jak Google nazwie zmianę, tylko co faktycznie wydarzyło się z Twoją widocznością i ruchem. Warto podchodzić do tematu operacyjnie, analizując typy stron, grupy zapytań, urządzenia, kraje oraz zmiany w SERP. Spadek po aktualizacji nie musi oznaczać kary ani „bana”, bo często wynika z ponownej oceny jakości, lepszego dopasowania wyników przez konkurencję albo zmiany interpretacji intencji użytkownika. Najbardziej użyteczne podejście jest proste: wykryj zmianę, odseparuj obszar wpływu, znajdź wzorzec, usuń przyczynę i obserwuj kolejne przeliczenia. W tym przewodniku skupiamy się na tym, jak czytać aktualizacje Google w danych i co z nimi zrobić w praktyce. Dzięki temu łatwiej odróżnisz problem treściowy, techniczny, linkowy i czysto konkurencyjny.

Czym są aktualizacje algorytmu Google w praktyce

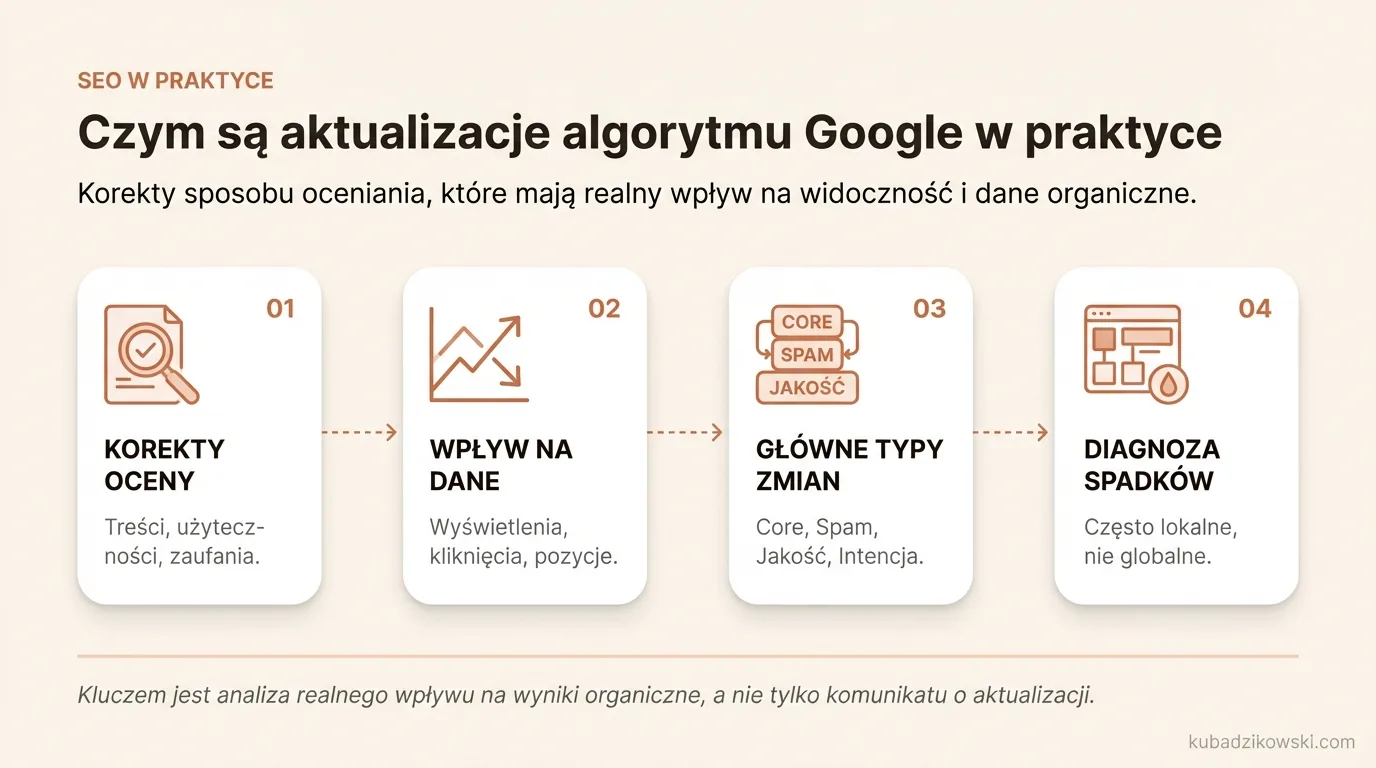

Aktualizacje algorytmu Google to w gruncie rzeczy korekty sposobu oceniania stron, zapytań, jakości treści, użyteczności oraz zaufania do witryny. Dla właściciela serwisu nie jest to abstrakcyjne zdarzenie techniczne, tylko coś, co potrafi przełożyć się na liczbę wyświetleń, kliknięć i pozycje konkretnych podstron. Dlatego nie rozpatruje się wyłącznie komunikatu o update, lecz jego realny wpływ na dane organiczne.

Najczęściej mówi się o kilku typach zmian: core updates, spam updates, systemach oceny jakości treści, systemach recenzji, jakości linków oraz dopasowaniu wyników do intencji zapytania. Każda z tych kategorii zostawia w danych inny ślad. Jeśli po zmianie spada tylko część serwisu, problem zwykle nie dotyczy całej domeny, lecz konkretnego katalogu, szablonu albo klastra tematycznego.

W praktyce jedna aktualizacja rzadko oddziałuje równomiernie na całą witrynę. Zdarza się, że dotyka wyłącznie strony informacyjne, tylko mobile, tylko dany kraj albo jedynie zapytania niebrandowe. To istotne, bo analiza „całej domeny” często rozmywa właściwy obraz sytuacji.

Warto również rozróżnić aktualizację algorytmiczną od ręcznego działania Google. Spadek widoczności po update najczęściej nie oznacza kary ręcznej, tylko przeliczenie rankingów i świeżą ocenę relatywnej jakości dokumentów na tle konkurencji. Najczęstszy błąd polega na szukaniu jednej „kary”, gdy w rzeczywistości Google po prostu uznał inne strony za lepiej dopasowane do zapytania.

Najbardziej praktyczny model pracy pozostaje prosty: najpierw ustalasz, co spadło lub wzrosło, potem izolujesz obszar wpływu, a na końcu szukasz cechy wspólnej stron dotkniętych zmianą. Tą cechą może być cienka treść, słaby szablon, nadmiar reklam, niejasny autor, duplikacja, wadliwa architektura informacji albo nietrafiona odpowiedź na intencję użytkownika. Dopiero na tym etapie planowanie poprawek ma ręce i nogi.

Aktualny kontekst operacyjny algorytmów Google

Obecny kontekst działania algorytmów Google jest taki, że systemy rankingowe są nieustannie korygowane, a publicznie nagłaśniana bywa jedynie część wdrożeń. W praktyce oznacza to, że diagnozy nie da się budować wyłącznie na branżowych nagłówkach. Warto konfrontować oficjalne komunikaty z własnymi danymi z Google Search Console, analityki oraz z bieżącymi obserwacjami SERP.

Najsolidniejsze punkty odniesienia stanowią oficjalne źródła Google, w tym Search Status Dashboard oraz Google Search Central, jednak same komunikaty nie pokażą, co konkretnie wydarzyło się w Twoim serwisie. To trzeba zweryfikować bezpośrednio w danych. Kluczowe nie są ogólne wahania całej domeny, tylko zmiany na poziomie zapytania, typu strony, folderu, urządzenia oraz kraju.

Obecnie Google znacznie silniej łączy ocenę jakości z intencją użytkownika oraz użytecznością strony po kliknięciu. Sama obecność słów kluczowych przestaje wystarczać, jeśli treść nie odpowiada wprost na pytanie, jest wtórna albo nie dostarcza pełnej odpowiedzi. Coraz większą rolę odgrywają też sygnały zaufania, takie jak jasna informacja o autorze, wskazane źródła, metodologia oraz spójność obietnicy z faktyczną zawartością strony.

Jednocześnie Google coraz sprawniej ogranicza strony produkowane masowo bez realnej wartości, manipulacyjne schematy linkowania oraz treści tworzone wyłącznie po to, by przechwycić long tail. Nie chodzi wyłącznie o klasyczny spam. Kłopotem bywa także duża liczba bardzo podobnych podstron, które formalnie są „inne”, ale z perspektywy użytkownika nie wnoszą niczego nowego.

Po aktualizacji warto analizować nie tylko pozycje. Równie istotne są zmiany CTR, udział widoczności w kluczowych tematach, tempo indeksacji oraz stabilność ruchu po wdrożeniach. Jeżeli pozycja pozostaje zbliżona, a CTR wyraźnie spada, problem może dotyczyć dopasowania wyniku do intencji albo tego, jak Twoja strona prezentuje się na tle nowych konkurentów w SERP.

Warto też mieć na uwadze, że po core update nie istnieje prosty formularz „naprawy”. Standardowo chodzi o podniesienie jakości strony i cierpliwe czekanie na kolejne przeliczenia systemów rankingowych. Z kolei przy kłopotach technicznych lub indeksacyjnych efekty potrafią pojawić się szybciej, gdy Google ponownie crawluje i przetwarza poprawione adresy.

Jak wygląda proces analizy i reakcji na aktualizacje

Analiza i reakcja powinny przebiegać w stałej sekwencji: wykrycie zmiany, odseparowanie obszaru wpływu, znalezienie wzorca, wdrożenie poprawek oraz kontrola efektów. Taki porządek ułatwia odróżnienie realnego wpływu aktualizacji od sezonowości, błędów wdrożeniowych i naturalnych wahań pozycji. Najczęstszy błąd polega na traktowaniu całej domeny jako jednego problemu, mimo że update nierzadko dotyczy tylko fragmentu serwisu.

Na początku należy sprawdzić, czy moment spadku lub wzrostu pokrywa się z potwierdzoną zmianą po stronie Google. Pomagają w tym oficjalne komunikaty, Search Status Dashboard, Search Console oraz własna analityka. Sama zbieżność dat nie przesądza o przyczynie, ale stanowi sensowny punkt wyjścia do dalszej diagnozy.

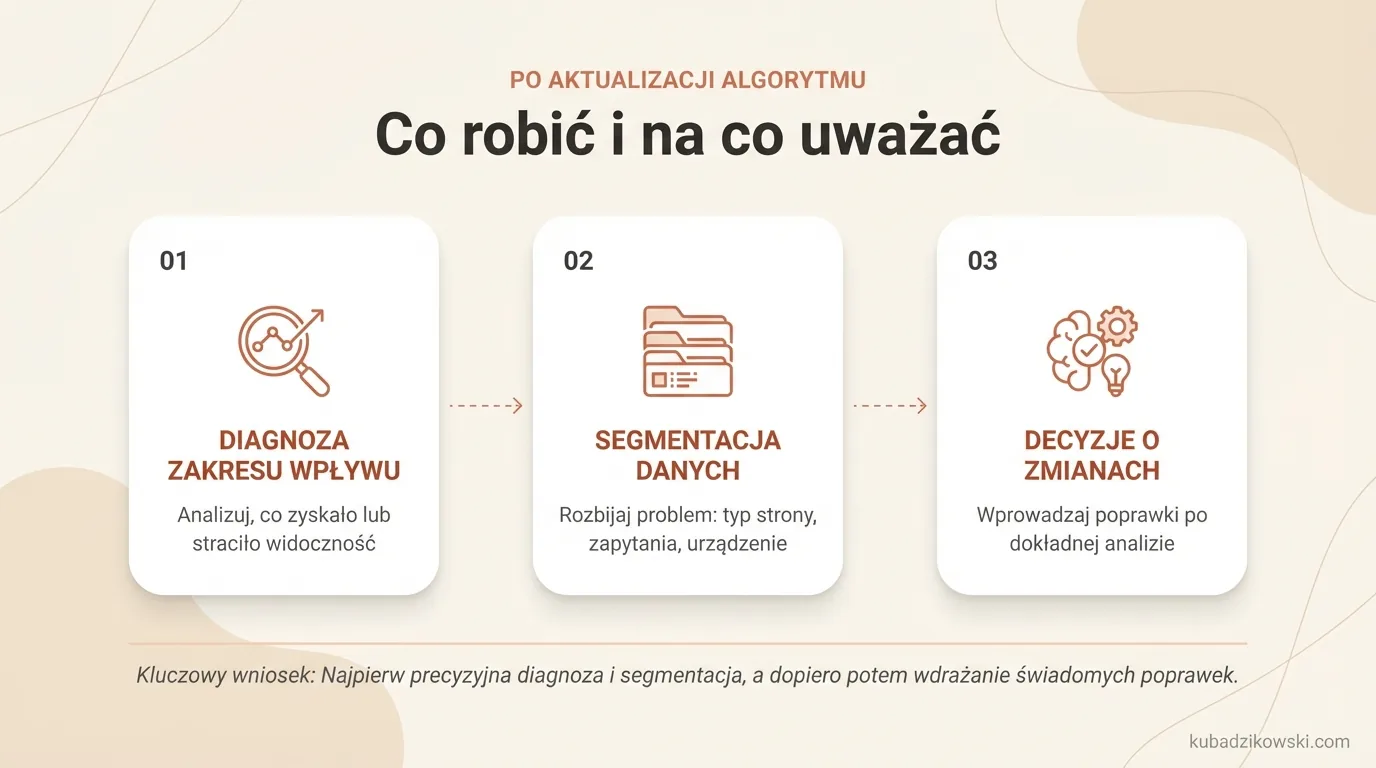

Drugi etap to segmentacja danych, ponieważ dopiero ona pozwala zobaczyć, gdzie faktycznie tkwi problem. Warto zestawić ze sobą katalogi, typy adresów URL, zapytania brandowe i niebrandowe, urządzenia, kraje oraz grupy intencji. Jeśli spadki dotyczą wyłącznie stron poradnikowych na mobile albo tylko jednego folderu produktowego, obszar działań masz już wyraźnie zawężony.

Następny krok to uchwycenie wzorca. W praktyce weryfikuje się, czy źródłem problemu są cienkie treści, duplikacja, rozjazd z intencją, słaby szablon, kłopoty z indeksacją, linki lub elementy spamowe. Celem nie jest przypięcie jednej etykiety, lecz znalezienie powtarzalnej przyczyny widocznej na całej grupie stron.

Potem dobrze jest zestawić to z wynikami, które po aktualizacji zyskały. Analiza SERP pokazuje, czy Google zaczął premiować inny format odpowiedzi, większą świeżość, lepiej uporządkowaną strukturę informacji, mocniejsze sygnały zaufania albo bardziej wyczerpującą odpowiedź na pytanie użytkownika. To istotne, bo spadek nie zawsze oznacza pogorszenie Twojej strony. Czasem wskazuje po prostu, że konkurencja trafniej odpowiada na aktualną interpretację zapytania.

Równolegle należy wykonać audyt techniczny. Trzeba sprawdzić indeksację, kanonikalizację, przekierowania, meta robots, sitemap, renderowanie, linkowanie wewnętrzne oraz dostępność stron dla Googlebota. Usterki techniczne potrafią wyglądać jak efekt aktualizacji, choć w praktyce wynikają z błędów we wdrożeniu albo ze zmiany szablonu.

W obszarze jakości ocenia się nie tylko sam tekst, lecz także całe doświadczenie po kliknięciu. Liczą się kompletność odpowiedzi, aktualność informacji, oryginalność, transparentność autora, źródła, proporcja treści głównej do reklam oraz użyteczność szablonu. Jeśli strona formalnie pasuje do tematu, ale użytkownik dostaje niewiele treści i dużo elementów pobocznych, ranking może się osłabić.

Na końcu potrzebne są priorytetyzacja i walidacja. Najpierw wdraża się szybkie naprawy techniczne oraz korekty szablonowe, a dopiero potem przebudowuje kluczowe treści i porządkuje strony o niskiej wartości. Jeśli problem dotyczy jakości ocenianej przez core systems, poprawa często nie pojawia się od razu po publikacji zmian, tylko po kolejnych przeliczeniach.

Najważniejsze kroki przy wdrażaniu poprawek po aktualizacji

Najważniejsze kroki przy wdrażaniu poprawek po aktualizacji obejmują ustalenie priorytetów, ograniczenie chaosu zmian oraz dopracowanie dokładnie tych obszarów, które straciły widoczność. W praktyce nie wygrywa zespół, który zrobi najwięcej, tylko ten, który poprawi właściwe elementy we właściwej kolejności. Dlatego plan wdrożenia powinien wynikać z wcześniejszej diagnozy, a nie z ogólnej listy „dobrych praktyk SEO”.

- Najpierw określ zakres problemu: pojedyncze URL-e, cały katalog, typ treści, kraj, urządzenie lub zapytania niebrandowe.

- Następnie podziel poprawki na trzy grupy: techniczne, szablonowe i treściowe.

- Następnie wybierz strony o najwyższym znaczeniu biznesowym i największym spadku ruchu, bo właśnie tam naprawy przyniosą największą różnicę.

- Na koniec skonfiguruj monitoring kliknięć, wyświetleń, indeksacji oraz zmian na poziomie klastrów tematycznych.

Przy wdrożeniu najlepiej zacząć od elementów, które mogą blokować ocenę strony albo jej poprawne przetwarzanie. Chodzi m.in. o błędy indeksacji, nieprawidłowe przekierowania, problemy z canonicalami, przypadkowe noindex, błędy renderowania oraz słabe linkowanie wewnętrzne. Takie korekty często dają szybszy efekt niż przebudowa treści, bo zdejmują barierę techniczną.

Jeśli update uderzył w jakość treści, samo dopisanie kilku akapitów nie wystarczy. Trzeba dopasować materiał do pełnej intencji zapytania, uzupełnić brakujący kontekst, pokazać ograniczenia, uporządkować strukturę i usunąć fragmenty pisane wyłącznie pod frazy. Najlepiej działają zmiany, które rzeczywiście poprawiają odpowiedź dla użytkownika, a nie tylko wydłużają tekst.

W wielu serwisach źródło problemu leży w skali publikacji, a nie w pojedynczym artykule. W takiej sytuacji warto usuwać albo scalać strony, które nie wnoszą samodzielnej wartości, dublują temat lub powstały wyłącznie po to, by łapać long tail. Taka konsolidacja porządkuje architekturę informacji i ogranicza udział słabych adresów URL w całym serwisie.

Warto również wzmocnić sygnały zaufania na poziomie szablonu i redakcji. Autor, metodologia, źródła, dane kontaktowe, polityki serwisu oraz jasne oznaczenie treści komercyjnych pomagają Google lepiej zrozumieć, kto odpowiada za publikację i dlaczego użytkownik ma jej ufać. To nie jest kosmetyka, tylko element jakości strony jako całości.

Nie wdrażaj wszystkiego naraz i bez dokumentacji. Każda większa zmiana powinna mieć datę, zakres oraz listę objętych stron, aby później dało się ocenić wpływ na wyniki. Bez historii wdrożeń łatwo pomylić efekt aktualizacji Google z rezultatem własnych działań.

Po publikacji poprawek trzeba obserwować nie tylko pozycje, ale też CTR, udział stron w ekspozycji na ważne tematy, częstotliwość indeksacji oraz stabilność ruchu. Jeśli problem był techniczny albo dotyczył spamu, część efektów może pojawić się po ponownym crawlu. Jeśli problem dotyczył jakości ocenianej szerzej przez systemy rankingowe, na pełniejszy sygnał często trzeba poczekać dłużej.

Co robić i na co uważać po aktualizacji algorytmu

Po aktualizacji algorytmu najpierw trzeba ustalić, co dokładnie straciło lub zyskało widoczność, a dopiero potem wprowadzać poprawki. Kluczowe jest rozbicie problemu na poziom katalogu, typu strony, grupy zapytań, urządzenia i kraju. Dzięki temu widać, czy spadek dotyczy np. poradników, kart kategorii, recenzji, czy tylko ruchu niebrandowego. Najpierw diagnoza zakresu wpływu, potem decyzje o zmianach.

W praktyce dobrze jest sprawdzić nie tylko pozycje, ale również kliknięcia, wyświetlenia, CTR oraz indeksację. Sama średnia pozycja bywa mało miarodajna, bo pojedyncza aktualizacja potrafi obniżyć ekspozycję na istotne zapytania, a pozostawić bez zmian mniej ważne frazy. Jeśli spadły wyświetlenia, kłopot może dotyczyć dopasowania do intencji użytkownika albo utraty widoczności w kluczowych obszarach tematycznych. Jeżeli ucierpiał głównie CTR, warto przeanalizować tytuły, opisy, typ wyniku oraz to, jak strona prezentuje się na tle aktualnego układu SERP.

Zmiany powinny wynikać z rzeczywistej przyczyny, a nie z samych symptomów. Jeżeli problem dotyczy jakości treści, należy pełniej odpowiedzieć na intencję użytkownika, usunąć „laną wodę”, dopracować strukturę i uaktualnić informacje. Gdy źródłem spadków jest szablon, trzeba ograniczyć elementy rozpraszające, poprawić czytelność i zwiększyć udział treści głównej na stronie. Nie każda utrata widoczności oznacza karę; często jest to sygnał, że konkurencja trafniej odpowiada na dane zapytanie.

Po aktualizacji warto także przejrzeć sygnały zaufania na poziomie całego serwisu. Chodzi o czytelne informacje o autorze, redakcji, źródłach, zasadach publikacji, danych kontaktowych oraz transparentności komercyjnej. Nie są to dodatki „dla formalności”, lecz elementy, które ułatwiają użytkownikowi i algorytmom ocenę wiarygodności strony. Szczególnie istotne jest to w serwisach poradnikowych, finansowych, zdrowotnych i recenzenckich.

Najwięcej ostrożności wymagają chaotyczne wdrożenia. Jeśli równocześnie zmienisz treści, linkowanie, szablon, meta dane i strukturę adresów, później trudno będzie ustalić, co pomogło, a co zaszkodziło. Każda większa zmiana po update powinna mieć datę wdrożenia, zakres adresów URL i jasno określony cel. Bez tego monitoring po wdrożeniu szybko przeradza się w zgadywanie.

W części przypadków warto również przejrzeć profil linków oraz strony o niskiej wartości. Nie chodzi o automatyczne wycinanie wszystkiego, lecz o wyłapanie schematycznych działań, nienaturalnego anchor textu, zaplecza niskiej jakości albo dużej liczby podstron, które samodzielnie nie odpowiadają na żadne sensowne zapytanie. Lepiej skonsolidować słabe treści, niż utrzymywać wiele cienkich stron, które kanibalizują temat.

Typowe błędy i jak ich unikać przy pracy z aktualizacjami Google

Najczęstszy błąd w pracy z aktualizacjami Google polega na traktowaniu całej domeny jako jednego problemu. W praktyce spadki zwykle dotyczą konkretnych szablonów, tematów albo typów intencji, a nie wszystkich adresów URL jednocześnie. Gdy analizujesz wyłącznie dane zbiorcze dla całego serwisu, łatwo przeoczyć właściwe źródło trudności. Dlatego trzeba schodzić niżej, do poziomu folderów, powtarzalnych wzorców stron i klastrów zapytań.

Drugim częstym błędem jest wprowadzanie wielu zmian bez uprzednio potwierdzonej diagnozy. Po spadkach firmy nierzadko jednocześnie przepinają menu, przerabiają tytuły, usuwają linki, skracają treści i podmieniają szablon. Taka reakcja podnosi ryzyko kolejnych kłopotów technicznych i zaciera obraz tego, co faktycznie zadziałało. Rozsądniej jest wdrażać poprawki etapami i obserwować, jak na zmiany odpowiadają konkretne grupy stron.

Spora część pomyłek bierze się także z nietrafnego wskazania źródła problemu. Spadek może zbiec się w czasie z aktualizacją Google, ale równie dobrze może wynikać z migracji, błędnej kanonikalizacji, blokady indeksacji, zmian w linkowaniu wewnętrznym albo sezonowości. Sam komunikat o update nie zastępuje pełnego audytu technicznego ani analizy danych. Ma to szczególne znaczenie, gdy problem pojawia się nagle i dotyczy wyłącznie fragmentu serwisu.

Kolejny typowy błąd to ocenianie skutków wyłącznie przez pryzmat pozycji. Po aktualizacji bardziej użyteczne jest sprawdzenie, które zapytania wypadły, które strony straciły ekspozycję oraz czy zmienił się udział witryny w kluczowych tematach. Średnia pozycja potrafi zamaskować duże straty, jeśli serwis nadal rankuje na wiele mało istotnych fraz. W praktyce większe znaczenie mają stabilność ruchu, widoczność na priorytetowe zapytania i jakość wejść niż sam numer pozycji.

Błędem bywa też kopiowanie widocznych elementów konkurencji bez zrozumienia, z czego wynika ich skuteczność. To, że konkurent ma dłuższy tekst, więcej FAQ albo mocniej rozbudowany blok produktowy, nie oznacza jeszcze, że właśnie to odpowiada za wzrost. Warto porównać cały dokument: zgodność z intencją, kompletność odpowiedzi, przejrzystość, zaufanie i użyteczność po kliknięciu. Dopiero wtedy da się sensownie zaplanować własne zmiany.

Wiele zespołów popełnia również błąd oczekiwania szybkiego odbicia po poprawkach jakościowych. Jeśli problem dotyczył oceny jakości strony w ramach core update, efekty mogą pojawić się dopiero po kolejnych przeliczeniach systemów rankingowych. Nie oznacza to, że działania są nieskuteczne, tylko że proces przebiega wolniej niż w przypadku naprawy błędu technicznego. Dlatego warto rozdzielać szybkie wskaźniki, takie jak indeksacja i crawl, od dłuższej oceny zmian rankingowych.

Jak mierzyć efekty wdrożeń po aktualizacjach algorytmu

Efekty wdrożeń po aktualizacjach algorytmu najlepiej mierzyć przez porównanie danych przed i po zmianie na poziomie konkretnych segmentów, zamiast patrzeć wyłącznie na całą domenę. Najlepiej zestawić ten sam typ stron, tę samą grupę zapytań, urządzenie, kraj i okres o podobnym popycie. Najczęstszy błąd to ocena sukcesu tylko po średniej pozycji lub łącznym ruchu organicznym. Po update istotniejsze jest, czy wróciła widoczność w kluczowych klastrach tematycznych oraz czy poprawiła się jakość ekspozycji na właściwe zapytania.

Dobrym punktem startu jest stabilny baseline, czyli zapis sytuacji sprzed wdrożenia. W praktyce opłaca się zestawić co najmniej 2 okna czasowe: okres przed spadkiem oraz okres po wdrożeniu, z uwzględnieniem sezonowości, dni tygodnia i ewentualnych korekt w ofercie. Gdy serwis generuje mało danych, lepiej analizować dłuższy wycinek czasu niż pojedyncze dni. Bez sensownego punktu odniesienia łatwo pomylić efekt wdrożenia z naturalnym wahaniem popytu lub SERP.

Kluczowe metryki to kliknięcia, wyświetlenia, CTR i średnia pozycja z Google Search Console, ale interpretacja ma sens dopiero wtedy, gdy patrzy się na nie łącznie. Więcej wyświetleń bez przyrostu kliknięć może sugerować, że strona wróciła do ekspozycji, lecz nadal przegrywa formatem wyniku albo niedopasowaniem do intencji. Spadek pozycji przy rosnących kliknięciach również bywa realny, jeśli serwis odzyskał widoczność na większej liczbie zapytań z długiego ogona. Najpierw sprawdzaj zmiany w grupach zapytań i typach stron, dopiero potem wyciągaj wniosek dla całej witryny.

Po wdrożeniach technicznych warto dodatkowo kontrolować indeksację i crawl. Jeśli poprawiano kanonikalizację, przekierowania, meta robots, linkowanie wewnętrzne lub błędy renderowania, dobrze jest monitorować liczbę zaindeksowanych adresów, tempo ponownego crawlowania oraz to, czy poprawione strony zaczynają pojawiać się w wynikach. W tym obszarze efekty często widać szybciej, bo wynikają z ponownego przetworzenia dokumentów przez Googlebota, a nie z szerokiego przeliczenia jakości.

Po zmianach jakościowych, szczególnie po core update, pomiar powinien przebiegać wolniej i z większą ostrożnością. Kiedy przebudowujesz treści, wzmacniasz sygnały zaufania, usuwasz cienkie strony albo lepiej dopasowujesz materiał do intencji, rezultat nie zawsze pokazuje się od razu. Część poprawy może być zauważalna po kolejnym crawlu, ale pełniejszy efekt zwykle zależy od następnych przeliczeń systemów rankingowych. Brak natychmiastowego odbicia nie oznacza jeszcze, że poprawki były błędne.

Równie istotne jest mierzenie wpływu na klastry tematyczne, a nie wyłącznie na pojedyncze URL-e. Jeśli aktualizacja uderzyła w cały obszar, na przykład poradniki zakupowe, recenzje albo kategorie z filtrami, pojedyncza podstrona niewiele powie. Lepiej sprawdzić, czy cały segment odzyskuje wyświetlenia, czy poprawia się udział w zapytaniach niebrandowych oraz czy ruch wraca do stron, które mają realną wartość biznesową.

W praktyce dobrze sprawdza się prosty rejestr wdrożeń. Notuj datę zmiany, zakres adresów URL, rodzaj poprawki oraz oczekiwany mechanizm wpływu, na przykład lepsza indeksacja, mocniejsze dopasowanie do intencji albo usunięcie kanibalizacji. Dzięki temu po kilku tygodniach można powiązać zmianę w danych z konkretnym działaniem, zamiast zgadywać, co zadziałało.

Nie oceniaj rezultatów wyłącznie przez pryzmat widoczności, jeśli głównym celem serwisu jest pozyskiwanie leadów lub sprzedaż. Bywa tak, że po uporządkowaniu treści ruch spada, ale staje się trafniejszy i po prostu cenniejszy. Dlatego, obok danych z Search Console, warto analizować również to, co dzieje się po wejściu z SEO: udział landing pages, przejścia do kolejnych etapów, jakość sesji oraz konwersje z ruchu organicznego.

W praktyce rzetelne mierzenie efektów sprowadza się do rozdzielenia trzech kwestii: czy Google ponownie dostrzega i indeksuje poprawione strony, czy serwis odbudowuje ekspozycję na właściwe tematy oraz czy użytkownik po kliknięciu otrzymuje lepszą odpowiedź niż wcześniej. Dopiero zestawienie tych poziomów daje wiarygodny obraz. Gdy patrzysz wyłącznie na jeden wykres, zwykle brakuje Ci kontekstu, by podjąć sensowną decyzję o kolejnych wdrożeniach.