W kontekście SEO Cloudflare działa przede wszystkim jako techniczna warstwa pomiędzy użytkownikiem, botem Google a Twoim serwerem. Nie jest to narzędzie do „zdobywania pozycji”, ale potrafi wyraźnie wpłynąć na to, jak szybko, stabilnie i poprawnie witryna odpowiada. W praktyce zahacza o takie obszary jak DNS, HTTPS, cache, przekierowania, dostępność serwisu oraz obsługę botów. To właśnie te elementy przesądzają o tym, czy Google bez przeszkód pobiera stronę, widzi właściwą wersję URL-a i dostaje prawidłowe statusy HTTP. Sama obecność Cloudflare niczego nie poprawia, jeśli konfiguracja jest błędna albo wchodzi w konflikt z działaniem serwisu. Dlatego w SEO warto oceniać nie samą usługę, tylko konkretne skutki jej ustawień.

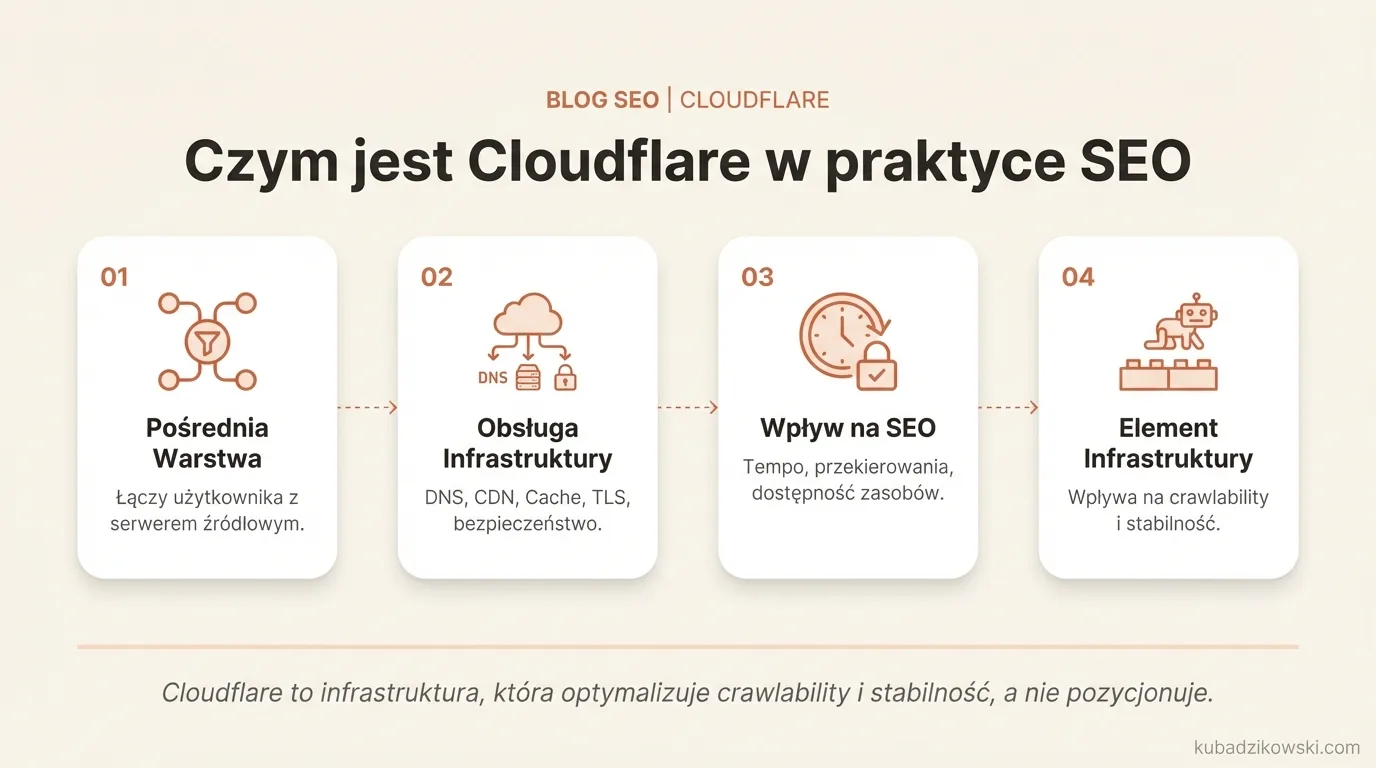

Czym jest Cloudflare w praktyce SEO

W praktyce SEO Cloudflare to pośrednia warstwa między przeglądarką lub botem a serwerem źródłowym, która obsługuje DNS, reverse proxy, CDN, cache, TLS oraz część reguł bezpieczeństwa. W efekcie wiele odpowiedzi HTTP nie dociera do użytkownika bezpośrednio z hostingu, lecz przechodzi przez infrastrukturę Cloudflare. Z perspektywy SEO kluczowe jest to, że ta warstwa może zmieniać tempo dostarczania treści, sposób realizacji przekierowań i dostępność istotnych zasobów.

Dla pozycjonowania Cloudflare nie jest „narzędziem SEO”, lecz elementem infrastruktury wpływającym na crawlability i stabilność serwisu. Ma znaczenie tam, gdzie liczy się czas odpowiedzi, poprawna obsługa HTTPS, statusy 200, 301, 302, 404 i 5xx oraz dostęp do robots.txt i sitemap.xml. Cloudflare nie pozycjonuje strony, ale może realnie poprawić albo pogorszyć warunki indeksacji.

Najczęściej pomaga wtedy, gdy problemem jest wolny serwer, wysokie obciążenie, brak sensownego cache dla plików statycznych albo niespójna obsługa SSL. W takich sytuacjach potrafi skrócić czas dostarczania zasobów, odciążyć origin i ograniczyć skutki chwilowych przeciążeń. To bywa korzystne dla użytkownika, a pośrednio także dla sygnałów technicznych mających znaczenie w SEO.

Może też zaszkodzić, jeśli reguły wdrożono bez odpowiedniej kontroli. Błędny cache HTML potrafi serwować nieaktualną wersję strony, zła konfiguracja przekierowań może tworzyć pętle, a zbyt agresywne zabezpieczenia bywają w stanie blokować crawlery. Jeśli Cloudflare zwraca inną odpowiedź niż origin powinien zwrócić, problem SEO zwykle zaczyna się właśnie tutaj.

W praktyce warto więc traktować Cloudflare jako wykonawczą warstwę SEO technicznego. Liczy się nie to, że usługa jest włączona, tylko to, czy kluczowe URL-e zwracają właściwą treść, właściwy status i właściwe nagłówki. Dobrze skonfigurowany bywa dużym wsparciem, a źle ustawiony potrafi zamaskować problemy albo dołożyć nowe.

Jak działa Cloudflare dla SEO

Cloudflare w kontekście SEO działa w ten sposób, że przejmuje obsługę DNS oraz część ruchu HTTP, po czym rozstrzyga, czy odpowiedź ma zostać podana z cache edge, czy bezpośrednio z serwera źródłowego. W praktyce zmienia to trasę żądania i sposób realizacji certyfikatów, przekierowań, kompresji oraz reguł bezpieczeństwa. Z perspektywy SEO liczy się nie tyle samo „przyspieszenie”, ile to, czy cały mechanizm kończy się poprawną odpowiedzią dla użytkownika i bota.

Pierwszym krokiem jest podpięcie domeny pod DNS Cloudflare i włączenie proxy. Od tej chwili Cloudflare staje się publiczną warstwą dostępu do serwisu, więc jego ustawienia wpływają na to, w jaki sposób bot dociera na stronę. Na tym etapie warto dopilnować spójności hosta i protokołu, ponieważ błędy DNS lub nieprawidłowe rekordy potrafią zatrzymać indeksację szybciej niż problem w samym CMS-ie.

Kolejna warstwa dotyczy TLS i HTTPS. Cloudflare obsługuje certyfikat po swojej stronie, ale jednocześnie musi prawidłowo łączyć się z originem, dlatego znaczenie ma tryb połączenia oraz zgodność certyfikatów. Gdy ustawienia nie grają ze sobą, pojawiają się pętle przekierowań, błędy certyfikatu, mixed content albo niezamierzone przejścia między HTTP i HTTPS, co bezpośrednio odbija się na SEO technicznym.

Następnie wchodzi w grę cache i dostarczanie zasobów. Pliki statyczne, takie jak obrazy, CSS czy JavaScript, mogą być serwowane z najbliższego węzła edge, co zazwyczaj skraca czas dostarczenia. Z HTML-em trzeba postępować ostrożniej, bo nie każda podstrona powinna być cachowana identycznie. Najczęstszy błąd to zbyt agresywny cache HTML, który pokazuje Google lub użytkownikom nieaktualną albo niewłaściwą wersję strony.

Po drodze Cloudflare potrafi też nakładać reguły odpowiedzi, takie jak przekierowania, normalizacja adresów, nagłówki cache-control, kompresja, minifikacja i inne modyfikacje wykonywane na edge. Właśnie tu najłatwiej o tarcia między logiką Cloudflare a logiką serwera lub aplikacji. Jeśli oba poziomy próbują robić to samo, pojawiają się łańcuchy przekierowań, duplikacja URL-i albo rozjazd między canonicalem a adresem końcowym.

Osobnym obszarem jest bezpieczeństwo i filtrowanie ruchu. WAF, rate limiting oraz mechanizmy ochrony botów pomagają przy atakach i nadużyciach, ale powinny mieć wyjątki dla legalnych crawlerów i zasobów potrzebnych do renderowania. Jeśli Googlebot dostaje challenge, 403 albo nie może pobrać CSS, JS, robots.txt lub sitemap.xml, problem dotyczy indeksacji, a nie tylko bezpieczeństwa.

Na końcu zostaje monitoring i bieżące korekty. Warto kontrolować statusy HTTP, błędy 4xx i 5xx, zachowanie cache, odpowiedzi dla kluczowych URL-i oraz to, czy origin nadal wyrabia pod obciążeniem. Cloudflare może przykryć część objawów wolnego serwera, ale nie naprawi samej aplikacji ani zbyt wolnego generowania HTML, dlatego analiza powinna obejmować zarówno edge, jak i origin.

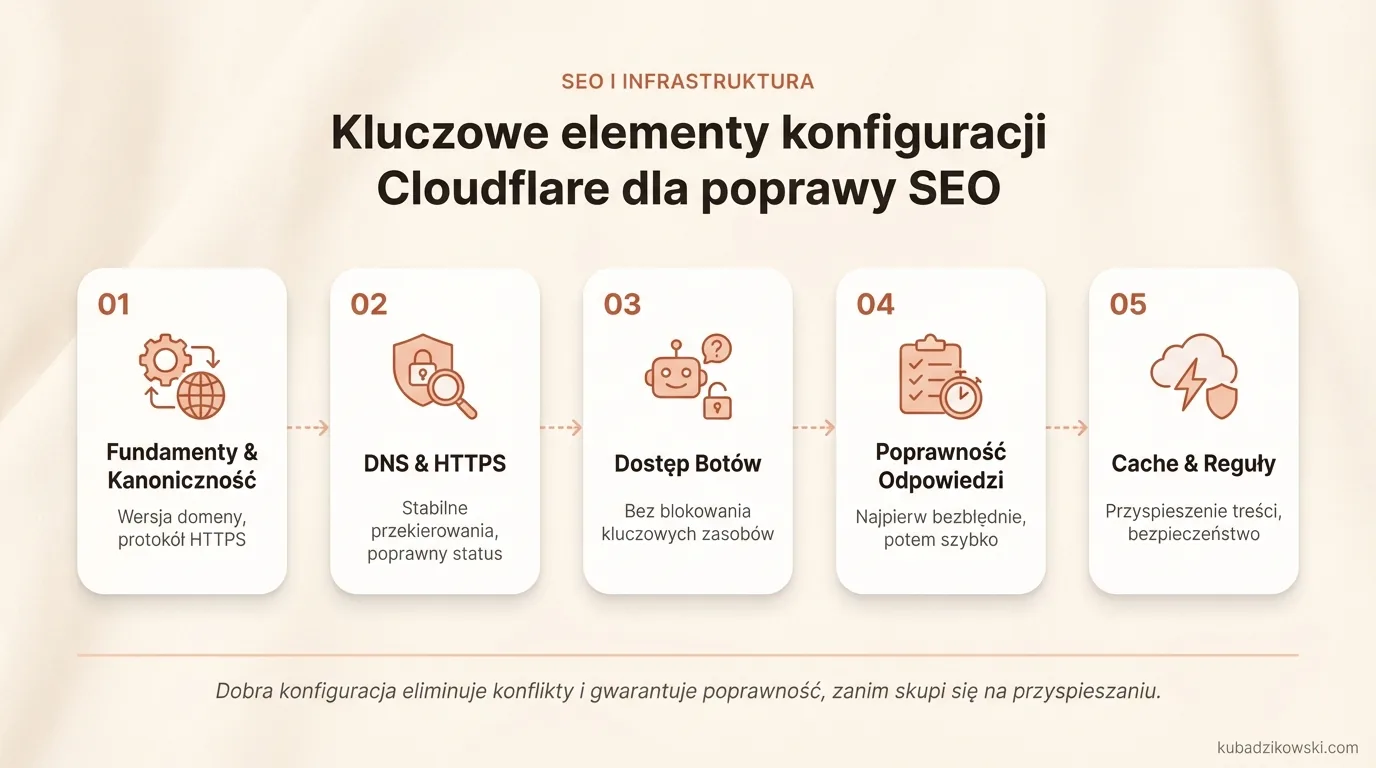

Kluczowe elementy konfiguracji Cloudflare dla poprawy SEO

W konfiguracji Cloudflare pod kątem SEO najwięcej znaczą: DNS, HTTPS, przekierowania, cache, reguły bezpieczeństwa oraz prawidłowy dostęp botów do istotnych zasobów. To te elementy przesądzają, czy Google widzi właściwy wariant strony, dostaje poprawny status HTTP i nie traci czasu na niepotrzebne opóźnienia. Kłopoty zwykle nie wynikają z samego Cloudflare, tylko z tarcia między jego ustawieniami a logiką serwera źródłowego. Dobra konfiguracja powinna najpierw gwarantować poprawność odpowiedzi, a dopiero potem je przyspieszać.

Na start warto uporządkować wersję domeny i protokołu. Strona powinna działać w jednej wersji kanonicznej, czyli na przykład wyłącznie https i tylko non-www albo tylko www. Gdy Cloudflare i origin równolegle wymuszają przekierowania, łatwo o pętle, łańcuchy 301 oraz rozjechane canonicale, co utrudnia crawl i osłabia indeksację.

Równie istotna jest konfiguracja TLS i SSL. Certyfikat musi być poprawny zarówno po stronie użytkownika, jak i na odcinku Cloudflare–serwer źródłowy. Źle dobrany tryb SSL potrafi wywołać pętle przekierowań, błędy certyfikatu albo mieszanie wersji HTTP i HTTPS. Z punktu widzenia SEO oznacza to niestabilny dostęp do URL-i i problemy z pobieraniem stron.

Cache ma przyspieszać zasoby, ale nie powinien serwować nieaktualnej lub niewłaściwej treści. Najczęściej bezpiecznie cachuje się pliki statyczne, takie jak CSS, JS, obrazy i fonty, natomiast HTML wymaga większej ostrożności oraz jasno opisanych wyjątków. Nie warto cachować na edge stron logowania, koszyka, checkoutu, wyników wyszukiwania wewnętrznego ani treści zależnych od użytkownika. Nieprawidłowo ustawiony cache HTML może podać botowi lub użytkownikowi starą albo nieodpowiednią wersję strony.

Reguły bezpieczeństwa powinny wzmacniać ochronę serwisu, ale nie mogą blokować indeksacji. WAF, rate limiting i ochrona botów muszą przepuszczać legalne crawlery do HTML, CSS, JS, obrazów, robots.txt i sitemap.xml bez challenge oraz bez przypadkowych blokad 403. W praktyce po wdrożeniu trzeba testować konkretne URL-e i sprawdzać, czy Googlebot oraz inne istotne boty dostają takie same odpowiedzi jak zwykły użytkownik.

Na koniec pozostaje kontrola nagłówków oraz sposobu odświeżania cache. Kluczowe są cache-control, vary, statusy 200 i 301, a także szybki purge po publikacji zmian. Jeśli nie masz wpływu na to, kiedy Cloudflare usuwa stare wersje, możesz opóźniać aktualizację treści w Google. Ma to szczególne znaczenie w dużych serwisach, e-commerce i na stronach często aktualizowanych.

Znaczenie Core Web Vitals i jak Cloudflare może pomóc

Core Web Vitals mają znaczenie dla SEO, bo oddają jakość faktycznie odczuwaną przez użytkownika, a Cloudflare wspiera przede wszystkim warstwę dostarczania zasobów i ograniczania opóźnień sieciowych. W praktyce chodzi o szybsze serwowanie plików, niższy TTFB, sprawniejsze zestawianie połączeń i lepszą dostępność serwisu pod obciążeniem. To typowo wsparcie infrastruktury, a nie substytut optymalizacji front-endu. Cloudflare może poprawić warunki techniczne, ale nie naprawi ciężkiego HTML, złego JavaScriptu ani słabego renderowania aplikacji.

W przypadku LCP kluczowe jest szybkie dostarczenie głównego dokumentu oraz zasobów potrzebnych do wyrenderowania widocznej części strony. Cloudflare pomaga tu przez CDN, edge caching, kompresję Brotli, HTTP/2 lub HTTP/3 oraz krótszą trasę do użytkownika. Różnica będzie najbardziej zauważalna, gdy zasoby statyczne są poprawnie cachowane, a serwer źródłowy nie przeciąga generowania HTML.

Dla INP wpływ Cloudflare jest raczej pośredni. Może ograniczyć opóźnienia przy pobieraniu skryptów i innych plików, ale nie rozwiąże problemu, jeśli interakcje blokuje ciężki JavaScript, nadmiar skryptów zewnętrznych albo nieudana architektura frontu. Gdy strona długo mieli kod po stronie przeglądarki, sama warstwa edge niewiele tu wskóra.

Przy CLS Cloudflare zwykle nie jest pierwszym narzędziem do naprawy, bo przesunięcia układu najczęściej wynikają z błędów w samym interfejsie. Może jednak pośrednio pomóc, gdy szybciej dostarcza style, fonty i obrazy, przez co spada ryzyko późnego dorysowywania elementów. Warto uważać na automatyczne transformacje, minifikację i skrypty edge, bo czasem potrafią wprowadzić regresje pogarszające stabilność układu.

Najrozsądniej rozdzielić to, co Cloudflare jest w stanie poprawić, od tego, co trzeba skorygować w aplikacji. Cloudflare dobrze sprawdza się w skracaniu czasu dostarczania, stabilizowaniu ruchu i ochronie serwera, ale wynik Core Web Vitals nadal zależy od wagi strony, kolejności ładowania zasobów, jakości kodu i wydajności urządzenia użytkownika. Dlatego po wdrożeniach warto porównywać nie tylko dane laboratoryjne, lecz także realne zachowanie kluczowych typów stron, takich jak strona główna, kategorie, produkty i artykuły.

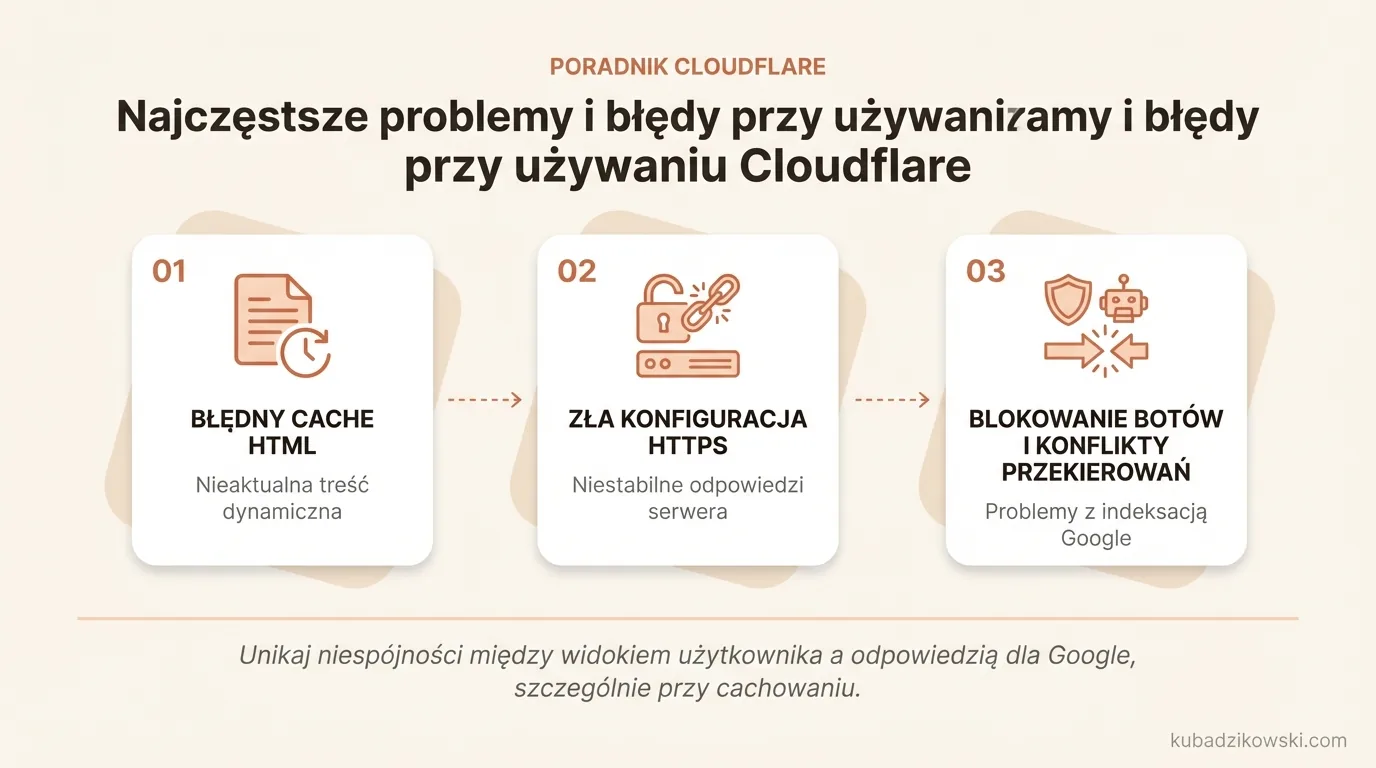

Najczęstsze problemy i błędy przy używaniu Cloudflare

Do najczęstszych problemów przy używaniu Cloudflare należą błędny cache HTML, blokowanie botów, konflikty przekierowań oraz źle skonfigurowany HTTPS. Te błędy nie zawsze od razu rzucają się w oczy użytkownikom, ale szybko wychodzą w indeksacji, spadku częstotliwości crawlu albo przy niestabilnych statusach HTTP. Najgroźniejsze są sytuacje, w których Google dostaje inną odpowiedź niż użytkownik lub dostaje ją niestabilnie.

Jednym z najczęstszych błędów jest zbyt agresywne cachowanie stron HTML. Najmocniej uderza to w serwisy dynamiczne, e-commerce i wdrożenia headless, gdzie część treści zależy od sesji, parametrów albo bieżącego stanu aplikacji. Gdy edge serwuje starszą wersję strony, Google może zobaczyć nieaktualny content, błędne canonicale albo wygaszone produkty, mimo że origin ma już poprawne dane.

Druga kategoria trudności dotyczy reguł bezpieczeństwa. WAF, rate limiting i mechanizmy antybotowe potrafią odciąć nie tylko ruch spamowy, ale również legalne crawlery, w tym dostęp do robots.txt, sitemap.xml, plików JS i CSS albo istotnych ścieżek kategorii i produktów. Jeśli bot dostaje challenge, 403 albo timeout, problemem nie jest SEO on-page, tylko warstwa dostępu.

Często dochodzi też do tarć między Cloudflare a serwerem źródłowym w zakresie logiki HTTPS i przekierowań. Klasyczny scenariusz to podwójne wymuszanie http do https, osobne reguły dla www i non-www albo nieprawidłowy tryb TLS, który kończy się pętlami lub błędami certyfikatu. Z punktu widzenia SEO liczy się jedna, spójna wersja URL oraz krótka ścieżka przekierowania, najlepiej bez łańcuchów.

Kłopotliwe potrafią być również automatyczne optymalizacje. Minifikacja, przepisywanie zasobów, transformacje obrazów czy modyfikacje na edge mogą rozjechać front-end, zakłócić działanie skryptów analitycznych albo zmienić sposób renderowania strony. Cloudflare może przyspieszyć dostarczanie plików, ale nie powinien zmieniać logiki strony bez kontroli skutków.

Osobny temat to brak procesu odświeżania cache po publikacji zmian. Kiedy redakcja, CMS albo wdrożenie aktualizują treść, a edge wciąż podaje starą wersję, Google i użytkownicy trafiają na różne stany strony w różnym czasie. To samo dotyczy zmian meta danych, przekierowań, nagłówków i plików sitemap.

Praktyczne wskazówki dotyczące optymalizacji z Cloudflare

Praktyczna optymalizacja z Cloudflare sprowadza się do tego, by przyspieszać i stabilizować stronę bez naruszania poprawności odpowiedzi dla Google i użytkownika. Najpierw warto określić, które elementy można bezpiecznie obsługiwać na edge, a które zawsze powinny iść z originu. W praktyce największy efekt daje uporządkowanie reguł, a nie liczba włączonych funkcji.

Zacznij od podziału adresów i zasobów według ich funkcji. Inaczej traktuje się stronę główną, kategorie, produkty, artykuły, paginację, robots.txt i sitemap.xml, a inaczej koszyk, checkout, logowanie czy wyszukiwarkę wewnętrzną. Najbezpieczniejszy model to cache dla statycznych assetów i ostrożne, świadome podejście do HTML.

- ustal jedną wersję kanoniczną hosta i protokołu oraz sprawdź, czy nie ma pętli lub łańcuchów 301,

- upewnij się, że robots.txt i sitemap.xml zwracają poprawny status 200 i są dostępne bez blokad,

- wyłącz challenge oraz agresywne reguły ochrony dla ścieżek i zasobów potrzebnych crawlerom,

- sprawdź nagłówki Cache-Control, Vary oraz to, jak strona zachowuje się po aktualizacji treści,

- testuj konkretne URL-e w przeglądarce, crawlerze oraz w narzędziach do analizy nagłówków HTTP.

W dynamicznych serwisach warto wyraźnie oddzielić treści wspólne od tych zależnych od użytkownika. Kategorie, artykuły czy część stron produktowych często da się realnie przyspieszyć, natomiast koszyk, konto, ceny zależne od segmentu albo wyniki wyszukiwania powinny omijać cache edge. Zmniejsza to ryzyko podawania niewłaściwych wersji strony i kłopotów z indeksacją parametrów.

Kontroluj również to, co Cloudflare robi z zasobami potrzebnymi do renderowania. Google musi móc pobrać HTML, JS, CSS, fonty i obrazy bez blokad oraz bez niestabilnych odpowiedzi. Jeżeli strona wygląda poprawnie dla użytkownika, a crawler nie jest w stanie pobrać części plików, ocena wydajności i renderowania będzie niemiarodajna.

Po wdrożeniu nie kończ pracy na samym uruchomieniu reguł. Warto śledzić błędy 403, 404 i 5xx, zmiany w czasie odpowiedzi, dostępność mapy witryny, spadki crawlu oraz rozjazdy między tym, co zwraca edge i origin. Najlepsze rezultaty daje stały monitoring i drobne korekty, a nie jednorazowa konfiguracja pozostawiona bez nadzoru.

Jak monitorować i korygować konfigurację Cloudflare

Konfigurację Cloudflare monitoruje się przez regularne sprawdzanie rzeczywistych odpowiedzi URL-i, logów, błędów HTTP, cache oraz dostępu botów, a następnie koryguje się reguły tam, gdzie edge zmienia zachowanie strony. Kluczowe jest to, czy Google i użytkownik dostają ten sam kod odpowiedzi, tę samą treść oraz ten sam zestaw zasobów. W praktyce nie wystarczy opierać się wyłącznie na panelu Cloudflare, bo część problemów wychodzi dopiero w Search Console, logach serwera i testach konkretnych adresów. Dobry monitoring zaczyna się od stałej listy krytycznych URL-i, które weryfikujesz po każdej zmianie konfiguracji.

Taka lista powinna obejmować stronę główną, kluczowe kategorie, przykładowe produkty lub artykuły, paginację, robots.txt, sitemap.xml, ważne zasoby CSS i JS oraz strony z przekierowaniami. Dla każdego adresu sprawdzaj status HTTP, nagłówki cache, canonical, finalny URL po przekierowaniach oraz czas odpowiedzi. Jeśli serwis jest dynamiczny, testuj też zachowanie z parametrami, bez cookies i z różnymi user-agentami.

Najwięcej o problemach SEO mówi analiza błędów 403, 429, 5xx oraz nagłych zmian w częstotliwości crawlu. Jeżeli po wdrożeniu nowych reguł rośnie liczba błędów pobrania mapy witryny, soft 404 albo spada liczba crawlowanych stron, trzeba od razu sprawdzić, czy nie zablokowano botów albo nie zmieniono odpowiedzi edge. Wzrost 403 lub 429 na robots.txt, sitemap.xml i stronach HTML to sygnał alarmowy, nawet jeśli zwykły użytkownik nie widzi problemu.

Warto równolegle zestawiać dane z Search Console, logów serwera oraz samego Cloudflare, bo dopiero ich korelacja daje pełny obraz sytuacji. Search Console pokazuje skutki dla indeksacji i pobierania, logi ujawniają realne wejścia botów, a Cloudflare wskazuje, które reguły, challenge lub cache mogły wpłynąć na odpowiedź. Jeśli masz dostęp do logów originu, porównuj, czy ruch botów faktycznie dociera do serwera, czy urywa się wcześniej na edge.

Osobno warto trzymać rękę na pulsie w obszarze cache, bo potknięcia w tej części często wyglądają jak przypadkowe problemy z SEO. Weryfikuj, czy po publikacji zmian HTML i kluczowe zasoby odświeżają się wtedy, kiedy powinny, oraz czy nagłówki cache-control i vary pasują do logiki serwisu. Jeśli nie masz jasnego procesu purge po wdrożeniu treści lub kodu, Cloudflare może podawać Google stare wersje strony mimo poprawnego stanu na originie.

Korekta konfiguracji powinna wynikać z konkretnego objawu, a nie z ogólnego „dokręcania” ustawień. Jeśli widzisz nieaktualny HTML, ograniczaj cache do bezpiecznych ścieżek, wyłączaj sesje, cookies oraz strony zależne od użytkownika. Jeżeli boty trafiają na challenge albo 403, dopracuj wyjątki w WAF i regułach bezpieczeństwa dla zweryfikowanych crawlerów oraz dla ścieżek potrzebnych do indeksacji.

Jeżeli problemem są przekierowania lub HTTPS, prześledź cały łańcuch między przeglądarką, Cloudflare i originem. Pętle najczęściej wynikają z mieszania reguł na kilku warstwach albo z niedopasowania trybu SSL/TLS do konfiguracji serwera źródłowego. Najstabilniej działa jedna, spójna logika przekierowań oraz jeden jasno ustalony wariant hosta i protokołu.

Po każdej zmianie zrób krótki retest tych samych adresów i porównaj wynik z poprzednim stanem. Nie oceniaj wdrożenia wyłącznie po poprawie szybkości, bo równie istotne są stabilne statusy, dostępność zasobów i brak rozjazdów między wersją dla użytkownika a wersją dla bota. Dobrą praktyką jest wdrażać zmiany etapami, bo wtedy łatwiej wskazać, która reguła faktycznie pomogła, a która pogorszyła indeksację lub renderowanie.