Google Florida należała do pierwszych aktualizacji, po których branża SEO na szeroką skalę przekonała się, że mechaniczna optymalizacja potrafi przestać działać niemal z dnia na dzień. Zmianę wdrożono w 2003 roku i wyraźnie przetasowała wyniki, zwłaszcza dla zapytań komercyjnych. Nie znamy pełnej specyfikacji technicznej, bo Google nie opublikowało wszystkich wykorzystanych sygnałów. Mimo to da się dość jasno wskazać, które typy stron traciły i z jakich powodów. Najważniejszy wniosek z Florida jest prosty: sama obecność słów kluczowych nie wystarcza, jeśli strona sprawia wrażenie sztucznie dopieszczonej pod algorytm i słabo odpowiada na intencję użytkownika. Właśnie dlatego ta historyczna aktualizacja wciąż pozostaje istotnym punktem odniesienia w praktycznym SEO.

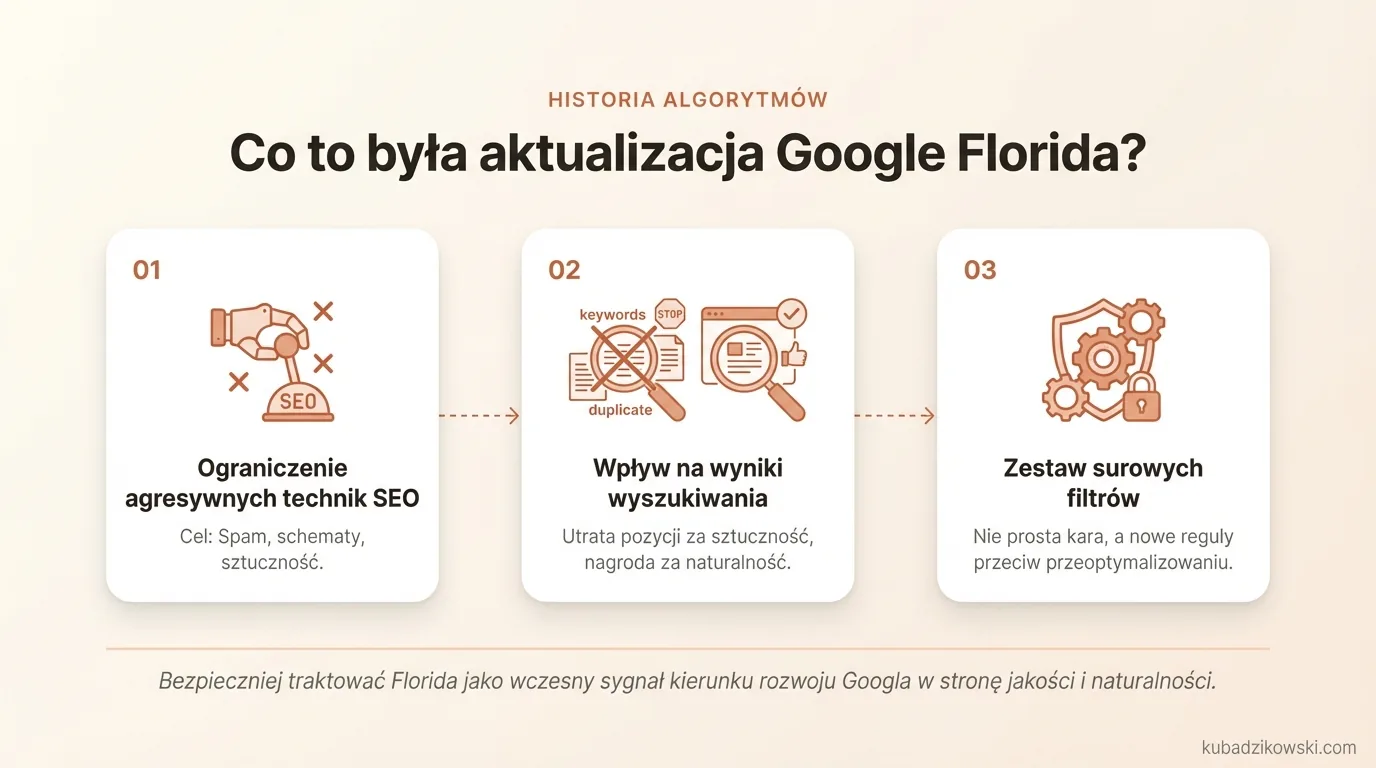

Co to była aktualizacja Google Florida?

Google Florida była dużą, historyczną aktualizacją algorytmu z 2003 roku, która ograniczyła skuteczność agresywnych technik SEO i mocno wpłynęła na wyniki wyszukiwania dla fraz komercyjnych. Najbardziej odczuły ją serwisy budujące widoczność na powtarzaniu fraz, schematycznych podstronach oraz sztucznych sygnałach dopasowania. Z kolei witryny wyglądające bardziej naturalnie i faktycznie użyteczne częściej utrzymywały swoje pozycje.

Nie była to jedna prosta „kara za optymalizację”, lecz raczej zestaw filtrów, które surowiej podchodziły do przewidywalnych wzorców spamu i przeoptymalizowania. Google nie ujawniło pełnego mechanizmu działania, dlatego ocena Florida opiera się głównie na efektach obserwowanych po wdrożeniu. Bezpieczniej traktować Florida jako wczesny sygnał kierunku rozwoju Google niż jako pojedynczy, łatwy do opisania czynnik rankingowy.

Z dzisiejszej perspektywy Florida jest ważna, bo pokazała zmianę sposobu myślenia o SEO. Wcześniej wielu właścicieli stron koncentrowało się na tym, by „wcisnąć” frazę w możliwie największą liczbę elementów witryny. Po aktualizacji stało się jasne, że algorytm zaczyna oceniać nie tylko dopasowanie słów, ale też naturalność języka, spójność dokumentu i realną wartość strony dla użytkownika.

Jakie techniki SEO zostały ograniczone przez Google Florida?

Google Florida ograniczyła przede wszystkim podejścia oparte na przeoptymalizowaniu treści, sztucznym dopasowaniu fraz oraz tworzeniu stron bardziej „pod algorytm” niż pod człowieka. Najmocniej traciły metody, które wcześniej dawały szybki efekt rankingowy, ale nie dostarczały realnej jakości. Problemem nie było samo użycie słów kluczowych, lecz ich nienaturalne zagęszczenie oraz schematyczny sposób wykorzystania.

- upychanie słów kluczowych w tytułach, nagłówkach i treści,

- powielanie tych samych lub bardzo zbliżonych anchorów,

- tworzenie wielu niemal identycznych podstron pod warianty jednej frazy,

- budowanie doorway pages i stron nastawionych wyłącznie na przechwycenie ruchu,

- stosowanie cienkich treści o niewielkiej wartości informacyjnej,

- schematycznych układach treści, w których brzmienie frazy liczyło się bardziej niż realna odpowiedź na zapytanie.

W praktyce szczególnie ryzykowne okazywały się strony exact match, wyglądające jak zlepek sygnałów SEO: fraza w title, fraza w H1, fraza wielokrotnie powtórzona w tekście oraz podobne anchory prowadzących linków. Taki układ mógł wcześniej przynosić efekty, ale po Florida zaczynał budzić podejrzenia, jeśli nie stała za nim faktyczna jakość dokumentu. To aktualna lekcja także dziś: zbyt „książkowe” dopasowanie pod słowo kluczowe często wypada gorzej niż naturalna, wyczerpująca odpowiedź na temat.

Warto też podkreślić, że Florida nie „karała” każdej formy optymalizacji. Dobrze przygotowany title, sensowny nagłówek czy przejrzysta struktura treści same w sobie nie stanowią problemu. Kłopoty zaczynają się wtedy, gdy optymalizacja jest mechaniczna, powtarzalna i podporządkowana wyłącznie rankingowi. Granica przebiega w miejscu, w którym strona przestaje służyć użytkownikowi, a zaczyna jedynie udawać trafność.

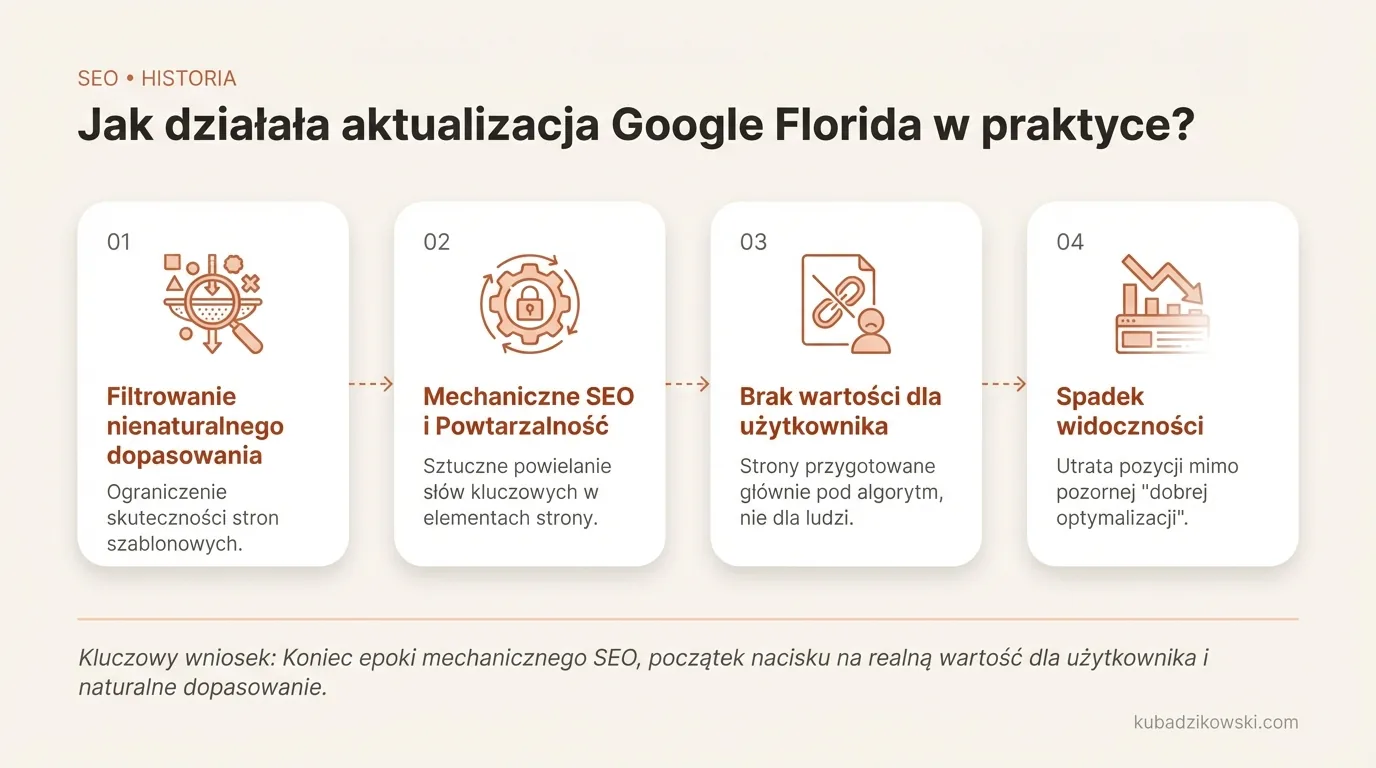

Jak działała aktualizacja Google Florida w praktyce?

Aktualizacja Google Florida działała w praktyce jak zestaw filtrów ograniczających skuteczność stron opartych na nienaturalnym dopasowaniu fraz i szablonowej optymalizacji. Najwyraźniej widać było to tam, gdzie te same słowa kluczowe powtarzano w tytule, nagłówkach, anchorach i treści, nie wnosząc przy tym realnej wartości dla użytkownika. Strona mogła być „dobrze zoptymalizowana” według dawnych standardów, a mimo to traciła widoczność, jeśli sprawiała wrażenie przygotowanej głównie pod algorytm.

Algorytm nie patrzył wyłącznie na samą obecność frazy, ale również na sposób jej wykorzystania. Jeżeli dokument składał się z powtarzalnych bloków tekstu, wielu podobnych podstron oraz sztucznie rozstawionych słów kluczowych, ryzyko spadków wyraźnie rosło. To był moment, w którym mechaniczne SEO przestało wystarczać.

Znaczenie miała także zależność między treścią strony a linkowaniem. Gdy anchory, tytuły i tekst były przesadnie spójne i układały się w podręcznikowy wzorzec exact match, algorytm mógł uznać taki zestaw za manipulacyjny. Nie chodziło o jeden detal, lecz o całościowy profil strony i o to, czy dopasowanie do zapytania wygląda wiarygodnie i naturalnie.

Najbardziej narażone były strony komercyjne budowane jako landing pages pod jedną frazę, doorway pages oraz serie niemal identycznych podstron, różniących się wyłącznie wariantem słowa kluczowego. Z kolei serwisy, które pełniej odpowiadały na intencję użytkownika i pisały prościej, częściej utrzymywały pozycje. Florida nie tyle „karała za SEO”, ile osłabiała SEO prowadzone w sposób przewidywalny i sztuczny.

Jaki wpływ miała aktualizacja na wyniki wyszukiwania?

Aktualizacja Google Florida wyraźnie przetasowała wyniki wyszukiwania, zwłaszcza dla zapytań komercyjnych, ponieważ wiele witryn straciło pozycje niemal natychmiast po wdrożeniu zmiany. W praktyce zniknęła część rezultatów, które wcześniej utrzymywały się wysoko głównie dzięki agresywnemu upychaniu fraz i schematycznemu linkowaniu. W ich miejsce częściej pojawiały się strony z bardziej naturalną treścią, mniej „dokręcone” pod SEO.

Dla właścicieli serwisów była to prosta, choć dotkliwa lekcja: wysokiej pozycji nie dało się już utrzymać wyłącznie techniką dopasowania słów kluczowych. Jeśli widoczność opierała się na ubogich treściach, powielanych tytułach i sztucznie rozmnożonych podstronach, spadek potrafił być gwałtowny. Wpływ Florida był więc przede wszystkim biznesowy: strony tracące ranking traciły też ruch z zapytań o wysokiej wartości.

Zmiana odbiła się również na sposobie myślenia o SEO. Od tego momentu trudniej było bronić strategii polegającej na produkowaniu wielu prawie identycznych stron pod kolejne warianty frazy. Znacznie większe znaczenie zyskało przygotowanie jednej sensownej podstrony z jasnym tematem, logiczną strukturą i realną odpowiedzią na potrzebę użytkownika.

Z dzisiejszej perspektywy najważniejsze w Florida nie jest to, że była jednorazowym wstrząsem, lecz że wskazała kierunek rozwoju algorytmów. Google zaczęło wyraźniej premiować trafność oraz jakość odpowiedzi zamiast samego nasycania tekstu słowami kluczowymi. Dlatego Florida nadal pozostaje użytecznym punktem odniesienia przy ocenie przeoptymalizowanych treści także dziś.

Jakie zasady SEO wynikają z aktualizacji Google Florida?

Z aktualizacji Google Florida wynika przede wszystkim zasada, że SEO ma wspierać jakość strony, a nie zastępować ją technicznymi sztuczkami. Ta zmiana pokazała, że samo występowanie frazy w wielu miejscach dokumentu nie daje trwałej przewagi, jeśli witryna słabo odpowiada na zapytanie. Najbezpieczniejsze podejście to budowanie podstron wokół konkretnego tematu i intencji użytkownika, zamiast mechanicznego powielania wariantów słów kluczowych.

Druga istotna zasada dotyczy języka i układu treści. Frazy powinny pojawiać się naturalnie w tytule, nagłówkach i tekście, ale wyłącznie tam, gdzie faktycznie pomagają zrozumieć temat strony. Gdy materiał brzmi nienaturalnie, kręci się wokół tych samych sformułowań i sprawia wrażenie pisanego pod algorytm, rośnie ryzyko, że również dziś zostanie oceniony słabiej.

Florida pokazuje też, że nie ma sensu mnożyć bardzo podobnych podstron tylko po to, aby przechwycić kolejne warianty zapytania. Lepszym rozwiązaniem jest jedna mocna, kompletna i czytelna strona niż kilka niemal identycznych landing page’y różniących się pojedynczym słowem. Google znacznie lepiej interpretuje dokumenty, które mają jasny cel, rozsądny zakres i realną wartość informacyjną.

W praktyce ta aktualizacja dokłada jeszcze jedną zasadę: na SEO trzeba patrzeć szeroko. Znaczenie ma nie tylko sama treść, lecz także sposób linkowania wewnętrznego, jakość anchorów, unikalność podstron oraz dopasowanie oferty do zapytania. Nie chodzi o „karę za optymalizację”, tylko o to, że zbyt schematyczne działania przestają przynosić efekt, jeśli nie idzie za nimi realna trafność.

Jak unikać błędów związanych z nadmierną optymalizacją?

Najprościej ograniczać nadmierną optymalizację, regularnie weryfikując, czy każdy element strony faktycznie pomaga użytkownikowi, czy jedynie sztucznie podbija frazę. Najczęściej problem pojawia się tam, gdzie to samo słowo kluczowe zostało upchnięte w meta title, kilka nagłówków, anchory i akapity bez sensownego powodu. Gdy fraza zaczyna dominować nad treścią, zwykle jest to znak, że optymalizacja poszła za daleko.

Dobrym sprawdzianem jest przeczytanie podstrony tak, jakby SEO w ogóle nie istniało. Jeśli nagłówki brzmią sztucznie, akapity są podporządkowane jednemu słowu, a tekst nie rozwija tematu, warto uprościć przekaz i przepisać stronę. W praktyce lepiej postawić na jeden precyzyjny nagłówek i kilka naturalnych odniesień do zagadnienia niż na siłę powtarzać exact match w każdym bloku.

Drugim obszarem ryzyka są zbiory bardzo podobnych podstron. Jeżeli serwis ma wiele stron o niemal identycznym układzie, tej samej treści i tylko lekko podmienionej frazie, rozsądniej je scalić, rozbudować albo wyraźnie zróżnicować. Masowe powielanie szablonu pod kolejne warianty zapytania często wygląda jak próba przejęcia ruchu, a nie jak realna pomoc dla odbiorcy.

Warto też mieć oko na anchory i linkowanie wewnętrzne. Kiedy każdy link jest opisany dokładnie tą samą frazą komercyjną, całość robi się przewidywalna i nienaturalna. Bezpieczniej rotować anchory opisowe, brandowe i naturalne, tak aby link rzeczywiście tłumaczył, dokąd prowadzi.

Najlepszą kontrolą bywa prosty audyt redakcyjny i strukturalny wykonywany przed publikacją oraz po spadkach widoczności. Sprawdź, czy podstrona ma jeden klarowny temat, czy odpowiada na intencję, czy nie dubluje innych URL-i oraz czy da się ją obronić bez oglądania się na słowa kluczowe. Jeśli strona pozostaje wartościowa także wtedy, gdy wytniesz z niej połowę „optymalizacyjnych” zabiegów, zazwyczaj jesteś na dobrej drodze.

Co warto mierzyć i weryfikować w kontekście Google Florida?

W kontekście Google Florida sensowniej mierzyć przede wszystkim sygnały nadmiernej optymalizacji, zamiast szukać jednego „wskaźnika Florida”. Najwięcej powie analiza, czy widoczność strony była lub jest budowana na mechanicznym powtarzaniu fraz, szablonowych podstronach i sztucznie ustawionych anchorach. Najbardziej użyteczne podejście to wyszukiwanie wzorców, które dobrze wyglądają dla robota, ale słabo pracują na korzyść użytkownika. To właśnie takie układy były najbardziej narażone na utratę pozycji.

Na poziomie treści warto sprawdzić nasycenie i rozmieszczenie słów kluczowych w title, nagłówkach, leadzie, anchorach wewnętrznych oraz w głównych partiach tekstu. Kłopotem nie jest sama fraza, tylko jej sztuczne dublowanie w wielu miejscach naraz. Jeżeli podstrona brzmi tak, jakby powstała przede wszystkim po to, aby wcisnąć frazę w każde dostępne pole, to jest to sygnał ostrzegawczy.

Drugim obszarem jest podobieństwo podstron. Warto zweryfikować, czy serwis nie zawiera wielu landing pages o niemal tym samym układzie, gdzie zmienia się jedynie fraza albo lokalizacja. Taki schemat często wskazuje na próbę przechwycenia licznych wariantów zapytania bez dostarczenia faktycznie innej wartości. W praktyce dobrze zestawić tytuły, nagłówki, śródtytuły oraz pierwszy ekran kilku podstron z tej samej grupy.

Istotna jest także analiza linkowania, szczególnie anchor textów. Gdy profil wewnętrzny lub zewnętrzny jest zdominowany przez exact match i w kółko powtarza te same komercyjne frazy, wiarygodność takiego sygnału staje pod znakiem zapytania. Naturalny profil anchorów zazwyczaj łączy nazwy marki, adresy URL, sformułowania opisowe i tylko w części frazy dokładne. To należy oceniać w skali całego serwisu, a nie przez pryzmat pojedynczego linku.

Osobno warto ocenić jakość strony docelowej w odniesieniu do intencji zapytania. Sprawdź, czy użytkownik dostaje czytelną odpowiedź, sensowną hierarchię informacji, konkretne dane oraz logiczną ścieżkę dalszego działania. Jeśli podstrona istnieje głównie po to, by przechwycić ruch z jednej frazy, a po wejściu nie rozwiązuje problemu odbiorcy, jej słabość będzie widoczna niezależnie od technicznej optymalizacji. Florida przypomina, że dopasowanie do intencji jest trwalsze niż dopasowanie do samego słowa kluczowego.

Przy analizie spadków najlepiej segmentować dane według typu zapytania oraz typu podstrony. Najwięcej widać w porównaniu tego, czy tracą przede wszystkim strony komercyjne, podstrony o bardzo zbliżonej konstrukcji albo URL-e z agresywnie zoptymalizowanymi tytułami. Taka segmentacja ułatwia odróżnienie zwykłych wahań pozycji od problemu jakościowego lub nazbyt schematycznej optymalizacji.

Jeśli robisz audyt dziś, traktuj Florida jako historyczny punkt ostrzegawczy, a nie aktywny filtr do „odhaczenia”. Nie da się wskazać jednego technicznego powodu tej aktualizacji, ale można sprawdzić, czy serwis nie powiela ryzykownych schematów, które Google od lat próbuje ograniczać. Najlepiej mierzyć nie samą obecność SEO, tylko to, czy SEO nie wyparło sensu strony.