Analiza plików logów w kontekście SEO to praktyczny sposób na sprawdzenie, jak boty wyszukiwarek faktycznie poruszają się po serwisie. Nie opiera się na deklaracjach z narzędzi raportowych, lecz na surowych żądaniach HTTP zapisanych przez serwer, CDN albo proxy. Dzięki temu można precyzyjnie ustalić, które adresy są realnie odwiedzane, które są omijane oraz gdzie bot marnuje zasoby na mało istotne URL-e. To jedno z nielicznych źródeł danych, które pokazuje rzeczywiste zachowanie bota na poziomie pojedynczego żądania. W praktyce taka analiza jest szczególnie przydatna przy dużych serwisach, sklepach, migracjach, filtrach i problemach z indeksowaniem. Największa wartość nie polega na wyłapaniu jednego błędnego adresu, lecz na wskazaniu powtarzalnych schematów, które hamują wzrost całych sekcji.

Co to jest analiza plików logów dla SEO?

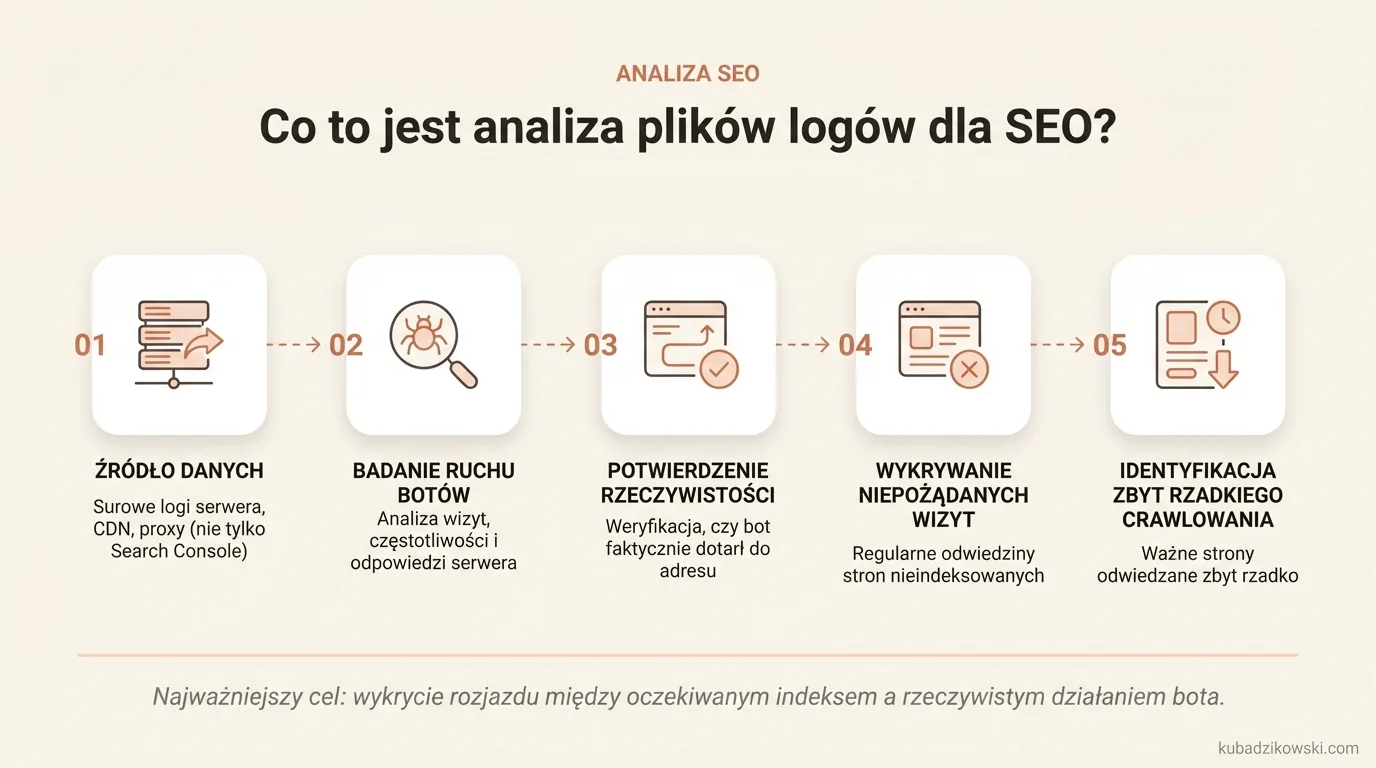

Analiza plików logów dla SEO polega na badaniu surowych logów dostępu, aby ustalić, jakie URL-e boty wyszukiwarek odwiedzają w rzeczywistości, z jaką częstotliwością i jakie odpowiedzi otrzymują od serwera. Chodzi o logi z serwera WWW, CDN, load balancera lub reverse proxy, a nie o dane pochodzące wyłącznie z paneli typu Search Console. To istotne rozróżnienie, ponieważ raport może coś sygnalizować, natomiast log potwierdza, czy bot rzeczywiście dotarł do danego adresu.

W praktyce taka analiza odpowiada na kilka bardzo konkretnych pytań. Czy bot regularnie odwiedza strony, które nie powinny być indeksowane. Czy ważne strony produktowe, kategorie lub artykuły są crawlowane zbyt rzadko. Najważniejszy punkt to wykrycie rozjazdu między tym, co chcesz mieć w indeksie, a tym, co bot rzeczywiście widzi i przetwarza.

Same logi nie wystarczą, jeśli nie zestawisz ich z danymi SEO dotyczącymi URL-i. Dlatego każde żądanie warto powiązać ze statusem indeksowalności, robots.txt, meta robots, canonicalem, sitemapą, typem szablonu, linkowaniem wewnętrznym, parametrami, paginacją czy hreflangiem. Dopiero wtedy widać, czy problem dotyczy stricte crawl budgetu, nieprawidłowej architektury, mylących sygnałów kanonicznych czy technicznej niedostępności.

Efektem solidnej analizy nie jest lista przypadkowych adresów, lecz powtarzalne wzorce widoczne na poziomie sekcji i szablonów. Często wychodzi na jaw, że bot masowo skanuje filtry, parametry i duplikaty, a pomija strony najważniejsze z perspektywy biznesu. To właśnie wzorce, a nie pojedyncze URL, zwykle decydują o skali problemu i o priorytecie napraw.

Końcowy rezultat powinien nadawać się do wdrożenia, a nie ograniczać się do samej diagnozy. Dobra analiza dostarcza mapę problematycznych obszarów serwisu, listę poprawek o najwyższym priorytecie oraz plan weryfikacji, czy po wdrożeniu bot zaczął działać sprawniej. Dzięki temu można nie tylko zidentyfikować problem z indeksowaniem, ale też potwierdzić, że został realnie ograniczony.

Jakie są kluczowe etapy analizy plików logów?

Główne etapy analizy plików logów obejmują zebranie odpowiednich danych, potwierdzenie autentyczności botów, połączenie logów z metadanymi SEO, ocenę wzorców crawlowania, diagnozę problemów, ustalenie priorytetów oraz weryfikację efektów po wdrożeniu. Każdy z tych elementów przekłada się na trafność wniosków. Gdy któryś krok wypadnie z procesu, nietrudno o decyzje oparte na błędnych przesłankach.

- Ustalenie zakresu analizy — na starcie należy określić źródła logów, hosty, środowiska, przedział czasu oraz sekcje serwisu, które mają zostać ocenione. Bez takiego doprecyzowania łatwo wpaść w analizę danych niepełnych albo mało istotnych z perspektywy biznesu.

- Pozyskanie i scalenie logów — logi często spływają z kilku warstw infrastruktury, na przykład z CDN i serwera origin. Trzeba je ujednolicić, uporządkować format i wyrównać strefy czasowe, inaczej interpretacja kodów odpowiedzi oraz częstotliwości odwiedzin może prowadzić na manowce.

- Weryfikacja botów — nie każdy user-agent z nazwą Googlebota faktycznie należy do bota wyszukiwarki. W razie potrzeby autentyczność warto potwierdzić na poziomie DNS lub zakresów infrastruktury, ponieważ opieranie się wyłącznie na user-agencie to częsty i kosztowny błąd.

- Wzbogacenie URL o dane SEO — każde żądanie dobrze jest powiązać ze statusem HTTP, typem strony, canonicalem, noindex, robots.txt, sitemapą oraz linkowaniem wewnętrznym. Dzięki temu widać nie tylko, że bot odwiedza URL, ale również czy te wejścia mają uzasadnienie.

- Analiza wzorców crawlowania — w tym miejscu sprawdza się częstotliwość wizyt, rozkład po katalogach i szablonach, udział odpowiedzi 2xx, 3xx, 4xx i 5xx oraz długość łańcuchów przekierowań. To etap, na którym zwykle ujawniają się parametry, filtry, duplikaty oraz niestabilne odpowiedzi serwera.

- Diagnoza luk indeksowania — należy wskazać ważne URL, które są rzadko odwiedzane lub pomijane, a także strony osierocone oraz zasoby potrzebne do renderowania. Ten krok pozwala zobaczyć, gdzie serwis traci możliwość skutecznego indeksowania.

- Priorytetyzacja napraw — nie wszystkie problemy ważą tyle samo. W pierwszej kolejności usuwa się to, co generuje częste 4xx, 5xx, błędne przekierowania, złe canonicale, noindex na ważnych stronach albo niekończące się kombinacje parametrów.

- Wdrożenie zmian — poprawki mogą dotyczyć robots.txt, meta robots, canonicali, sitemap, statusów HTTP, wewnętrznego linkowania, obsługi parametrów, szablonów lub warstwy CDN. Dobrą praktyką jest przypisanie każdego problemu do konkretnego właściciela wdrożenia.

- Walidacja po wdrożeniu — po zmianach warto wrócić do logów i zestawić wzorce sprzed oraz po wdrożeniu. Dopiero wtedy widać, czy ograniczono niepotrzebne crawlowanie i czy kluczowe sekcje zaczęły być odwiedzane częściej.

Najwięcej kłopotów zaczyna się zazwyczaj już na etapie danych wejściowych. Gdy bierzesz pod uwagę wyłącznie jeden dzień albo logi tylko z jednej warstwy, wnioski potrafią być mylące. Rzetelna analiza wymaga reprezentatywnego okresu oraz jasności, czy oceniasz odpowiedzi z CDN, z originu, czy z obu źródeł jednocześnie.

Drugim kluczowym elementem jest segmentacja. Samo zliczenie hitów bota niewiele wnosi, jeśli nie rozbijesz adresów według typu strony, katalogu, szablonu, parametrów oraz wartości biznesowej. Taki podział ułatwia oddzielenie standardowego crawlowania od technicznego szumu i szybciej wskazuje, które korekty przełożą się na realny efekt.

Ostatni etap powinien kończyć się konkretnym planem działania. Każdy problem warto opisać jako wzorzec: przyczyna, wpływ, rekomendowana zmiana, właściciel wdrożenia oraz sposób potwierdzenia poprawy w kolejnych logach. Dopiero wtedy analiza logów staje się narzędziem do podejmowania decyzji, a nie wyłącznie technicznym raportem.

Jakie problemy z indeksowaniem można wykryć?

Analiza logów pozwala sprawdzić, które problemy z indeksowaniem faktycznie pojawiają się w ruchu botów, zamiast jedynie wyglądać podejrzanie w raportach. Widać, czy bot trafia na właściwe adresy, jak często do nich wraca oraz jakie odpowiedzi otrzymuje po drodze. Najbardziej wartościowy wniosek zwykle dotyczy rozjazdu między stronami kluczowymi dla biznesu a stronami, które bot rzeczywiście crawluje.

Często wychodzi na jaw marnowanie crawl budgetu na URL, które nie powinny absorbować uwagi wyszukiwarki. Zwykle są to filtry, parametry, wyniki wyszukiwania, puste listingi, duplikaty, strony techniczne albo nieskończone kombinacje adresów. Jeżeli takie obszary generują dużą liczbę żądań, ważne kategorie, produkty lub artykuły bywają odwiedzane zbyt rzadko.

Logi potrafią też dobrze ujawnić luki w pokryciu istotnych stron. Chodzi o przypadki, w których adres jest indeksowalny i powinien być widoczny w Google, a mimo to bot niemal go nie odwiedza albo nie dociera do niego w ogóle. W praktyce przyczyną bywa słabe linkowanie wewnętrzne, błędna paginacja, strony osierocone, nieprawidłowy canonical albo zmiany po migracji.

Kolejną grupę stanowią problemy techniczne, które utrudniają lub wręcz blokują przetwarzanie strony. W logach widać wysoki udział odpowiedzi 4xx i 5xx, chwilowe awarie, timeouty, niestabilne statusy oraz długie łańcuchy przekierowań. Jeżeli ważna sekcja regularnie zwraca błędy albo po drodze pojawia się kilka przekierowań, indeksowanie spowalnia nawet wtedy, gdy treść pozostaje poprawna.

Da się również wyłapać konflikty między sygnałami SEO. Typowy przypadek to strony często odwiedzane mimo noindexu, adresy blokowane w robots.txt, które wciąż są intensywnie linkowane, albo URL z canonicalem wskazującym inną wersję niż ta promowana w sitemapie. Takie niespójności nie zawsze objawiają się jednym, wyraźnym błędem, ale potrafią rozbić spójność indeksowania całej sekcji.

W praktyce logi ułatwiają również wychwycenie kłopotów z renderowaniem. Dotyczy to przypadków, gdy bot nie pobiera poprawnie zasobów CSS, JS lub innych plików niezbędnych do złożenia widoku strony. To szczególnie istotne w serwisach opartych na JavaScripcie, gdzie brak dostępu do zasobów może spowodować, że bot „zobaczy” stronę inaczej niż użytkownik.

Jakie dane są niezbędne do skutecznej analizy logów?

Aby analiza logów miała sens, potrzebujesz surowych danych żądania HTTP oraz możliwości spięcia ich z metadanymi SEO dla każdego URL. Dane z crawlera, sitemap czy narzędzi dla webmasterów bywają niewystarczające, bo nie pokazują pełnego przebiegu żądania ani tego, jak serwer realnie odpowiada. Bez surowych logów trudno rozdzielić faktyczny problem z crawlowaniem od błędnej interpretacji raportu.

- timestamp, czyli dokładny czas żądania,

- IP klienta,

- metoda HTTP,

- host,

- ścieżka lub pełny URL,

- kod odpowiedzi HTTP,

- user-agent.

To podstawowy zestaw, od którego można wyjść. Dużo wnoszą także referrer, rozmiar odpowiedzi oraz czas obsługi żądania, ponieważ pomagają ocenić przekierowania, opóźnienia i problemy z wydajnością.

Nie mniej ważne jest pochodzenie logów. Jeżeli serwis działa za CDN, WAF, load balancerem albo reverse proxy, trzeba ustalić, czy analizujesz odpowiedź z warstwy edge, z originu, czy z obu jednocześnie. W przeciwnym razie łatwo o mylny wniosek, że bot otrzymuje prawidłowy status, choć kłopot pojawia się na innej warstwie infrastruktury.

Sama lista hitów niewiele da, jeśli nie wiadomo, czym dany adres jest z perspektywy SEO. Dlatego logi warto zestawić z informacjami o indeksowalności, robots.txt, meta robots, canonical, sitemapach, typie szablonu, głębokości kliknięć, linkowaniu wewnętrznym, parametrach, paginacji i hreflang. Same odwiedziny bez kontekstu nie pokażą, czy bot trafia tam, gdzie powinien, czy tylko kręci się wokół technicznego szumu.

Trzeba też dopilnować jakości identyfikacji botów. Sam user-agent nie stanowi wystarczającego dowodu, ponieważ można go bez trudu podrobić. Przy istotnych analizach warto potwierdzać autentyczność bota przez DNS albo zakresy infrastruktury oraz odfiltrować ruch testowy, monitoring i automaty niezwiązane z wyszukiwarkami.

Znaczenie ma również horyzont czasowy. Do rzetelnej diagnozy potrzebny jest reprezentatywny okres, obejmujący typowy ruch oraz momenty zmian technicznych, na przykład migrację, wdrożenie nowych reguł canonical czy przebudowę filtrów. Analiza jednego dnia zwykle daje tylko migawkę i często prowadzi do nietrafionych priorytetów.

Na koniec kluczowa jest kompletność danych o wszystkich ważnych URL. Jeśli nie masz listy stron, które faktycznie powinny być crawlowane i indeksowane, trudno wskazać te pomijane. W praktyce dopiero połączenie logów z pełną mapą istotnych adresów pozwala jasno określić, co naprawić w pierwszej kolejności i jak później potwierdzić efekt w kolejnych logach.

Jakie błędy unikać podczas analizy logów?

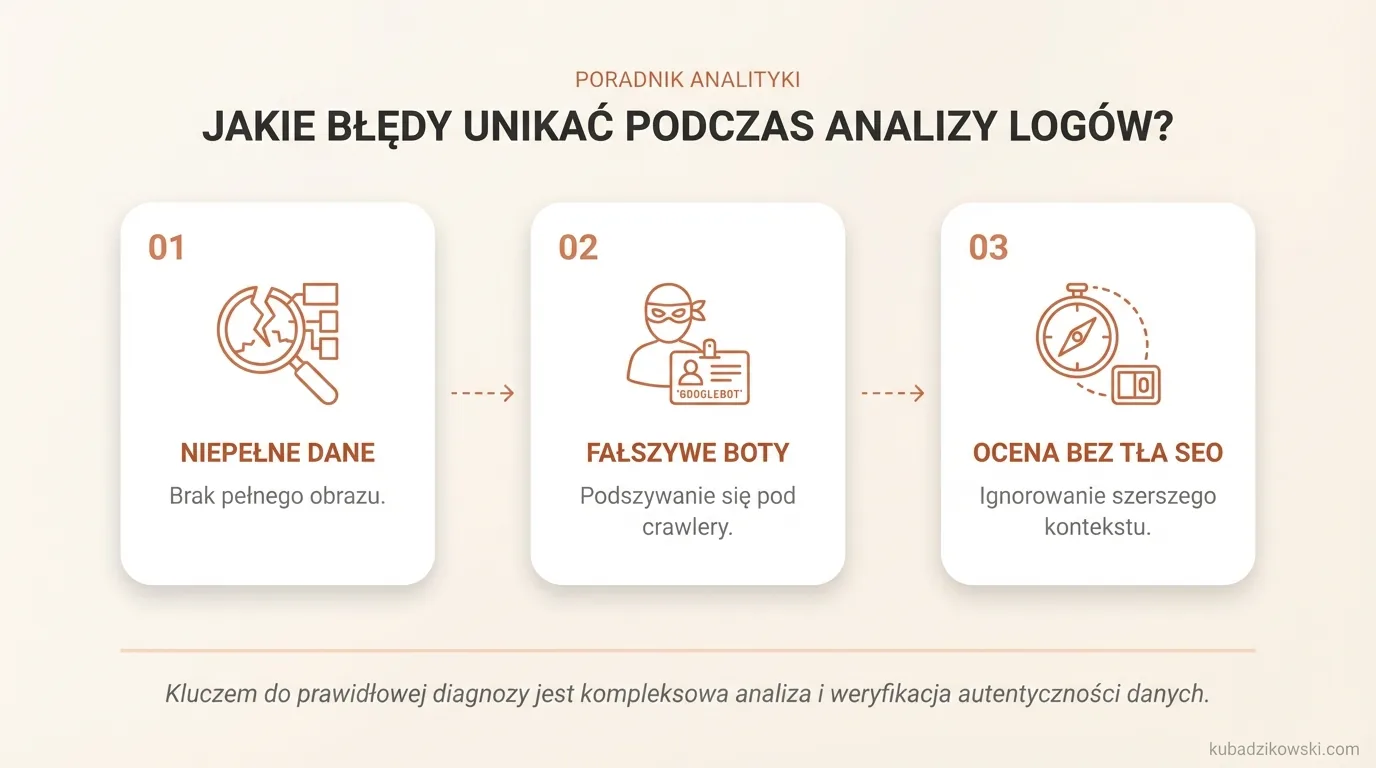

Do najczęściej spotykanych potknięć w analizie logów należą wnioski wyciągane na podstawie niepełnych danych, mylna identyfikacja botów oraz ocenianie samych hitów bez tła SEO. Gdy logi pochodzą wyłącznie z jednej warstwy infrastruktury, łatwo o zniekształcony obraz. Inaczej zachowa się odpowiedź z CDN, inaczej z originu, a jeszcze inaczej w drodze przez WAF lub reverse proxy. Bez ustalenia, która warstwa zapisuje dany status HTTP, nietrudno o błędną diagnozę.

Kolejnym częstym błędem jest opieranie się wyłącznie na user-agencie. W logach regularnie trafia się ruch podszywający się pod Googlebota lub inne crawlery. Jeśli nie odfiltrujesz takich żądań albo przy istotnych analizach nie potwierdzisz autentyczności bota, możesz zawyżyć skalę crawlowania lub szukać problemu w miejscu, w którym go nie ma.

Myląca bywa również analiza zbyt krótkiego wycinka czasu. Jeden dzień albo sam weekend potrafi pokazać przypadkowy wzorzec, zamiast realnego zachowania botów. Do podejmowania rozsądnych decyzji potrzebujesz okresu, który obejmuje typowy ruch oraz momenty zmian technicznych, migracji, wdrożeń lub problemów z dostępnością.

W praktyce szkodzi też traktowanie URL wyłącznie jako pojedynczych adresów. Najbardziej widoczne problemy ujawniają się na poziomie katalogów, szablonów i parametrów, bo to tam najczęściej powstaje nadmiarowe crawlowanie. Gdy patrzysz tylko na pojedyncze strony, łatwo przegapić schemat typu: cały moduł filtrów generuje tysiące żądań, a kluczowe strony kategorii są odwiedzane zbyt rzadko.

Poważnym błędem jest również odrywanie logów od danych o indeksowalności i architekturze serwisu. Sam fakt, że bot odwiedza URL, nie przesądza jeszcze, czy powinien go odwiedzać, czy może go indeksować i czy otrzymuje właściwe sygnały. Warto zestawić logi z informacją o robots.txt, meta robots, canonicalach, sitemapach, linkowaniu wewnętrznym, typie szablonu i statusie odpowiedzi. Dopiero wtedy widać rozjazd między planem SEO a rzeczywistym zachowaniem botów.

Trzeba też uważać na zbyt uproszczone wnioski w stylu „zablokujmy to w robots.txt i problem zniknie”. Blokada może ograniczyć crawl, ale nie naprawi błędnych linków wewnętrznych, duplikacji ani złych statusów HTTP. Podobnie noindex nie zastępuje poprawnego canonicala, a canonical nie rozwiąże serii przekierowań ani błędów 5xx.

Ostatni częsty błąd pojawia się już po analizie, czyli brak walidacji zmian. Jeśli po wdrożeniu nie wracasz do logów, nie masz pewności, czy bot faktycznie przestał marnować zasoby na zbędne sekcje i czy częściej odwiedza strony istotne. Dobra analiza domyka się dopiero wtedy, gdy kolejne logi potwierdzają zmianę wzorca crawlowania.

Jak wdrożyć zmiany po analizie logów?

Zmiany wynikające z analizy logów wdraża się według realnego wpływu na crawl i indeksowanie, a nie według tego, co najprościej „dowieźć” technicznie. W pierwszej kolejności usuwa się bariery, przez które bot marnuje najwięcej żądań albo nie dociera do kluczowych podstron. Najczęściej są to błędy 4xx i 5xx, rozbudowane łańcuchy przekierowań, parametry tworzące nieskończone kombinacje, nieprawidłowe canonicale oraz fragmenty serwisu generujące masowy techniczny szum.

Dobry proces zaczyna się od zamiany wniosków z analizy na konkretny backlog zadań. Każda pozycja powinna opisywać wzorzec problemu, jego źródło, wpływ na SEO, właściciela wdrożenia oraz sposób weryfikacji efektu. Dzięki temu zespół nie dostaje ogólnego zalecenia „ograniczyć crawl filtrów”, tylko precyzyjne zadanie, na przykład zmienić linkowanie do kombinacji parametrów, skorygować reguły canonical, wyczyścić sitemapę i skrócić reguły przekierowań.

Wdrożenia zazwyczaj obejmują równolegle kilka warstw. Część zmian leży po stronie SEO i CMS, takich jak meta robots, canonicale, sitemapy czy linkowanie wewnętrzne. Inne wymagają pracy backendu, DevOps lub administratora CDN, na przykład korekty statusów HTTP, cache, routingu, WAF albo obsługi błędów. Jeśli nie przypiszesz zmian do właściwych właścicieli, nawet trafna diagnoza pozostanie wyłącznie raportem.

W praktyce lepiej wdrażać poprawki etapami, zamiast uruchamiać wszystko jednocześnie. Gdy w tym samym czasie zmienisz robots.txt, przekierowania, sitemapę i logikę parametrów, trudno później ocenić, co faktycznie przyniosło efekt. Sprawdzają się krótsze serie wdrożeń z pomiarem przed i po, szczególnie w dużych serwisach, sklepach i portalach.

Dobór poprawki powinien wynikać bezpośrednio z rodzaju problemu. Jeśli bot regularnie trafia na nieistniejące adresy, trzeba usunąć źródła tych URL z linkowania, map witryny i nawigacji, a nie wyłącznie zwracać 404. Jeśli intensywnie crawlowane są filtry i kombinacje parametrów, potrzebna jest korekta generowania linków, logiki indeksowalności oraz kanonikalizacji. Jeśli ważne strony są odwiedzane sporadycznie, warto skrócić ich ścieżkę kliknięć, wzmocnić linkowanie wewnętrzne i upewnić się, że nie blokują ich sprzeczne sygnały.

Po wdrożeniu należy ocenić nie tylko sam rezultat, ale również potencjalne skutki uboczne. Zdarza się, że po ograniczeniu crawlu filtrów spada widoczność wartościowych listingów, bo reguły ustawiono zbyt szeroko. Bywa też odwrotnie: usunięto noindex, ale pozostawiono błędny canonical, więc bot odwiedza stronę, jednak nadal nie dostaje jednoznacznego sygnału, co ma indeksować.

Końcowy etap to ponowna analiza logów na tym samym poziomie szczegółowości co wcześniej. Weryfikujesz wtedy, czy spadł udział niepotrzebnych żądań, czy ubyło błędów, czy skróciły się łańcuchy przekierowań oraz czy ważne sekcje są odwiedzane częściej. Najlepszym potwierdzeniem jakości wdrożenia nie jest sama zmiana konfiguracji, tylko nowy wzorzec zachowania botów w logach.

Jakie są najlepsze praktyki walidacji po wdrożeniu zmian?

Najbardziej miarodajna walidacja po wdrożeniu to zestawienie logów sprzed i po zmianie dla tych samych sekcji serwisu, tych samych botów oraz porównywalnego okna czasowego. Dopiero wtedy da się ocenić, czy bot faktycznie przestał przepalać budżet crawlowania i czy częściej dociera do istotnych URL. Najczęstszy błąd to wyciąganie wniosków na podstawie pojedynczych dni albo samego wzrostu liczby hitów. Większa liczba odwiedzin nie musi oznaczać poprawy, jeśli nadal dotyczą filtrów, parametrów lub adresów niekanonicznych.

W porównaniu warto ująć nie tylko wolumen żądań, ale również ich charakter. W praktyce dobrze działa analiza udziału odwiedzin w kluczowych sekcjach, rozkładu kodów 2xx, 3xx, 4xx i 5xx, długości łańcuchów przekierowań oraz tego, czy bot częściej niż wcześniej trafia na strony indeksowalne. Jeżeli po zmianach maleje liczba wejść na śmieciowe wzorce URL, a rośnie pokrycie ważnych stron, jest to realny sygnał poprawy.

Walidację należy prowadzić na tych samych warstwach infrastruktury, z których pochodziła analiza wyjściowa. Jeżeli wcześniej oceniałeś logi z CDN i originu, a po wdrożeniu analizujesz już tylko jedną warstwę, obraz może być zafałszowany. Ma to szczególne znaczenie przy zmianach w przekierowaniach, cache, WAF i regułach bezpieczeństwa, bo każda z tych warstw potrafi zmienić odpowiedź widzianą przez bota.

Warto sprawdzić nie tylko to, co wypadło z crawlowania, ale też to, co zaczęło pojawiać się częściej. Po poprawie linkowania wewnętrznego, sitemap lub usunięciu błędnych canonicali bot powinien szybciej wracać do stron ważnych biznesowo i sięgać głębiej położonych adresów. Jeżeli poprawki ograniczyły crawl w jednej sekcji, a jednocześnie odcięły dostęp do zasobów potrzebnych do renderowania albo do ważnych podstron, wdrożenia nie można uznać za udane.

Dobrym nawykiem jest zestawienie logów z aktualnym stanem SEO dla URL. Trzeba potwierdzić, że adresy częściej odwiedzane po zmianach są indeksowalne, mają właściwy canonical, nie są blokowane przez robots.txt i nie wysyłają sprzecznych sygnałów. Sama poprawa wzorca w logach nie wystarczy, jeśli bot częściej odwiedza strony, które nadal nie powinny trafiać do indeksu albo są technicznie wadliwe.

Podczas walidacji trzeba też oddzielić efekt wdrożenia od czynników niezależnych. Na wzorce w logach wpływają migracje, wdrożenia CMS, sezonowość, duże zmiany w ofercie, awarie serwera i aktualizacje reguł bezpieczeństwa. Dlatego każdą analizę po wdrożeniu warto zestawić z kalendarzem zmian technicznych, aby nie przypisać sukcesu lub problemu niewłaściwej przyczynie.

Najbardziej użyteczny rezultat walidacji to nie ogólnikowe stwierdzenie, że „jest lepiej”, lecz precyzyjna informacja o tym, które problemy zniknęły, które się zmniejszyły, a które nadal występują. W praktyce sprowadza się to do krótkiej listy: wzorzec URL, spodziewany efekt, odczyt z logów oraz decyzja, czy sprawę domknąć, wprowadzić poprawkę, czy prowadzić dalszą analizę. Taka walidacja zamienia analizę logów z jednorazowego audytu w ciągły proces nadzorowania skutków wdrożeń.