White Hat SEO to praktyczna metoda budowania widoczności organicznej bez ryzykownych skrótów i bez działań „pod roboty” kosztem użytkownika. W tym podejściu liczy się techniczna dostępność strony, trafnie dobrana treść, przemyślana struktura serwisu oraz wiarygodne sygnały zewnętrzne. Nie przynosi rezultatów „od ręki”, ale zazwyczaj lepiej trzyma się w dłuższym horyzoncie i łatwiej je skalować. Kluczowe jest to, że White Hat SEO zaczyna się od diagnozy problemów i ustalenia priorytetów, a nie od przypadkowego pisania tekstów czy kupowania linków. W praktyce to proces, który łączy analizę danych, wdrożenia techniczne, rozwój treści i regularne korekty. Żeby miał sens, trzeba równolegle brać pod uwagę wyszukiwarkę, użytkownika oraz realne ograniczenia serwisu.

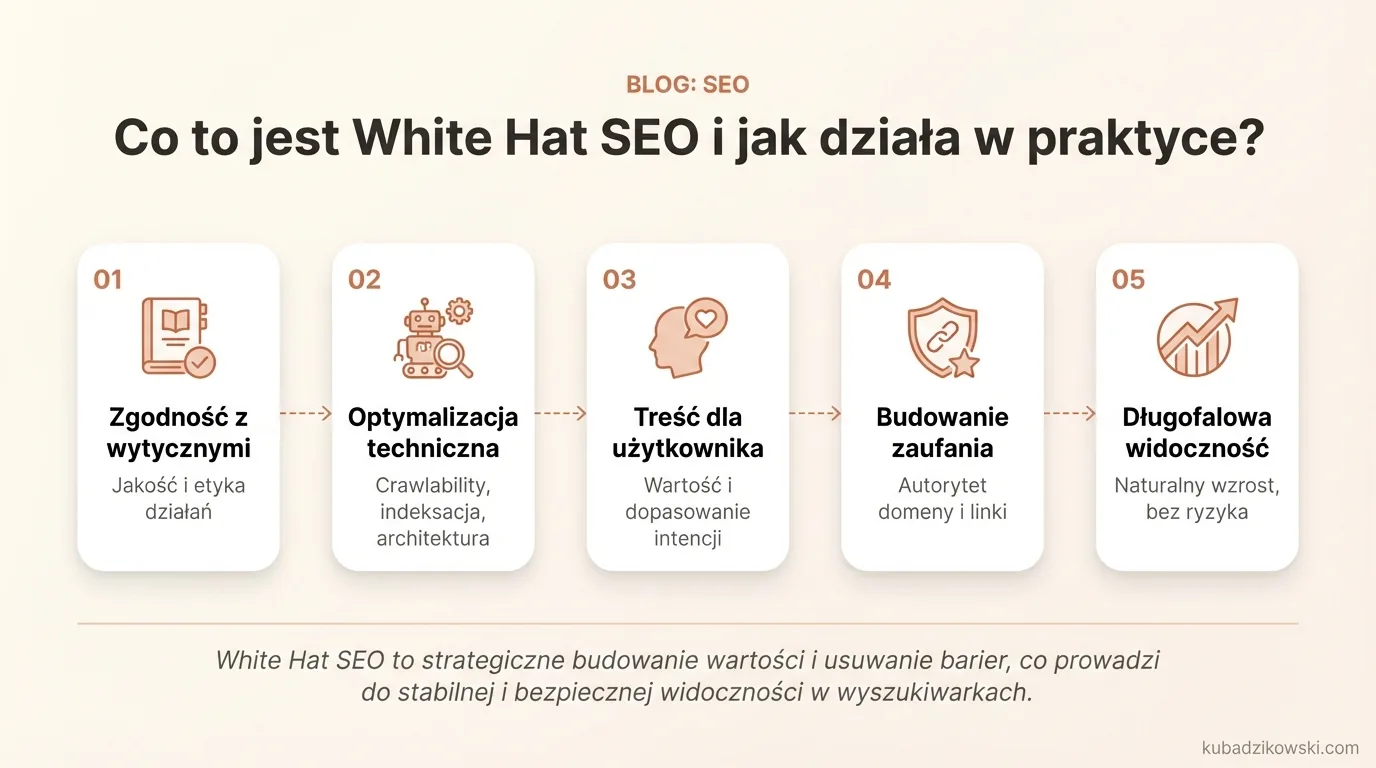

Co to jest White Hat SEO i jak działa w praktyce?

White Hat SEO to sposób prowadzenia działań SEO zgodnie z wytycznymi wyszukiwarek, z naciskiem na jakość strony, użyteczność oraz dopasowanie treści do intencji użytkownika. W praktyce sprowadza się to do poprawiania elementów, które realnie budują widoczność: crawlability, indeksację, architekturę informacji, jakość treści i zaufanie do domeny. Nie chodzi o „sprytne obejścia”, tylko o usuwanie barier i wzmacnianie sygnałów, które wyszukiwarka potrafi rozpoznać jako wartościowe.

Zakres White Hat SEO jest szerszy niż sama optymalizacja tekstu. Obejmuje analizę techniczną serwisu, mapowanie zapytań do konkretnych podstron, dopracowanie on-page, linkowanie wewnętrzne oraz bezpieczne działania wokół linków i wzmianek. Jeśli ważna podstrona nie jest poprawnie indeksowana albo nie odpowiada jednoznacznie na intencję wyszukiwania, nawet dobry content nie pokaże pełni swoich możliwości.

W praktyce proces zaczyna się od diagnozy wejściowej. Trzeba sprawdzić, które typy stron generują ruch, co jest zaindeksowane, gdzie pojawiają się błędy techniczne, jak wygląda struktura URL i które sekcje serwisu mają znaczenie biznesowe. Dopiero później ustala się priorytety, bo problem z canonicalem, blokadą w robots albo nieprawidłowym renderowaniem zwykle jest pilniejszy niż dopisywanie kolejnych akapitów do artykułu.

Po diagnozie przychodzi etap wdrożeń. Usprawnia się elementy techniczne, porządkuje strukturę strony, aktualizuje treści, wzmacnia linkowanie wewnętrzne i planuje rozwój tematów tak, aby każda istotna strona miała jasno określoną rolę. Dla każdej ważnej podstrony warto ustalić jeden główny cel, jedną główną intencję oraz czytelny zestaw elementów, które użytkownik powinien na niej znaleźć.

White Hat SEO nie obejmuje ukrywania treści, automatycznego spamu, masowego tworzenia stron bez wartości ani kupowania słabych linków wyłącznie po to, by sztucznie podbić pozycje. Takie działania mogą czasem dać krótkotrwały efekt, ale zwykle podnoszą ryzyko problemów z widocznością i utrudniają późniejszą naprawę serwisu. W modelu White Hat ważniejsza jest powtarzalność procesu niż jednorazowy skok.

- analiza techniczna i kontrola indeksacji,

- przypisywanie tematów i intencji do konkretnych podstron,

- dopracowanie treści, nagłówków oraz linkowania wewnętrznego,

- uporządkowanie architektury informacji i rodzajów podstron,

- bezpieczne budowanie autorytetu poprzez wartościowe wzmianki i linki,

- systematyczny pomiar efektów oraz korekty oparte na danych.

Rezultaty White Hat SEO zawsze są zależne od kontekstu. Liczy się stan wyjściowy serwisu, poziom konkurencji w tematach, tempo wdrożeń, jakość treści, dostęp do dewelopera oraz regularność pracy. Z tego powodu sensowne SEO bardziej przypomina zarządzanie backlogiem zmian niż jednorazową „optymalizację strony”.

Aktualne wyzwania i trendy w White Hat SEO

Wśród aktualnych wyzwań i trendów w White Hat SEO na pierwszy plan wysuwają się trafność odpowiedzi, jakość treści, doświadczenie użytkownika oraz wiarygodność źródła. Sama obecność słów kluczowych w tekście przestała wystarczać. Strona powinna odpowiadać na konkretne pytanie lepiej niż konkurencja i robić to w formie czytelnej, pełnej oraz praktycznej.

Coraz gorzej wypadają treści zduplikowane, zbyt ogólne albo pisane wyłącznie po to, by „zająć” pozycję w wynikach wyszukiwania. Problem stanowią też masowo publikowane strony bez własnej wartości, które powielają ten sam schemat odpowiedzi. Jeżeli kilka podstron w serwisie mówi prawie o tym samym, lepiej je scalić, rozdzielić intencje albo jasno określić rolę każdej z nich.

Dużym wyzwaniem wciąż pozostaje techniczna dostępność strony dla robotów. JavaScript, renderowanie, błędna kanonikalizacja, źle ustawione meta robots, niepotrzebnie indeksowane filtry oraz problemy mobilne nadal potrafią zatrzymać wzrost nawet wtedy, gdy treści są solidne. W praktyce wiele projektów nie przegrywa przez „słabe SEO”, tylko przez to, że Google nie widzi lub błędnie interpretuje kluczowe podstrony.

Istotnym trendem jest też coraz lepsze rozumienie encji i typów treści przez wyszukiwarki. Dane strukturalne pomagają opisać stronę, produkt, usługę, artykuł czy FAQ, jednak same nie naprawią problemu niskiej jakości treści. Schema może ułatwić interpretację strony, ale nie zastąpi sensownej struktury, aktualności informacji i realnej użyteczności.

Rosną również wymagania po stronie analityki. Trafne decyzje SEO coraz częściej wymagają zestawienia danych z Google Search Console, analityki, crawlera oraz ręcznej oceny stron docelowych. Sam wykres ruchu nie odpowie na pytanie, czy problemem jest spadek indeksacji, nietrafiona intencja strony, kanibalizacja, zmiana CTR czy techniczna blokada po wdrożeniu.

Zmiany algorytmiczne są stałym elementem krajobrazu, ale fundamenty pozostają zbliżone. Nadal wygrywają serwisy, które są technicznie dostępne, logicznie poukładane, mają wartościową treść i naturalny profil linków. Najbezpieczniejszy kierunek to nie „zgadywanie algorytmu”, tylko konsekwentne podnoszenie jakości strony w obszarach, które da się zweryfikować i usprawnić.

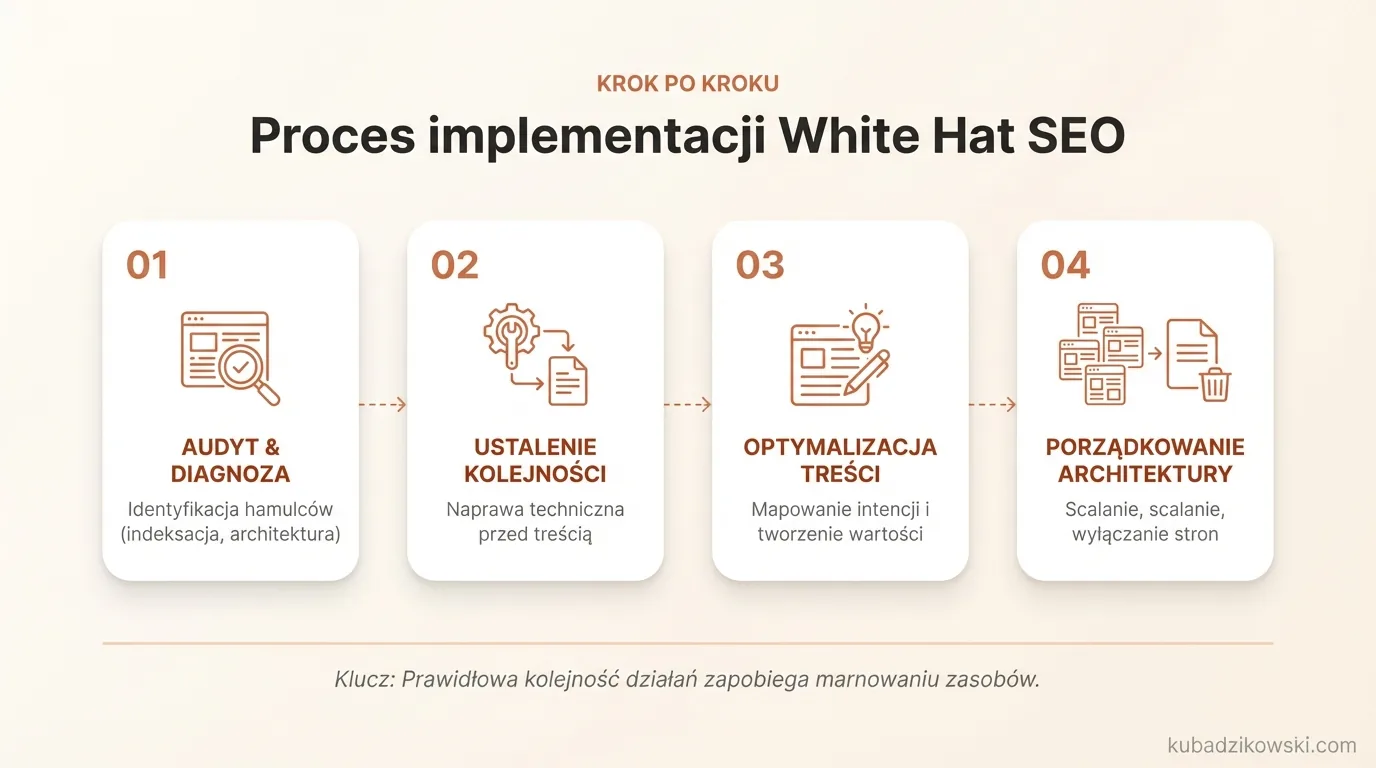

Proces implementacji White Hat SEO krok po kroku

Wdrożenie White Hat SEO zwykle startuje od audytu i przechodzi w stałą, cykliczną iterację opartą na danych. Na początku warto precyzyjnie ustalić, co faktycznie hamuje wzrost: indeksacja, architektura, treść, linkowanie czy ograniczenia po stronie wdrożeń. Najczęstszy błąd na wejściu to rozbudowa contentu zanim znikną problemy techniczne i zanim intencje zostaną rzetelnie zmapowane. Bez właściwej kolejności łatwo wytwarzać podstrony, których robot nie potrafi poprawnie odczytać, nie indeksuje ich albo sprowadza na nie niewłaściwy typ ruchu.

- Diagnoza wejściowa: przegląd Search Console, analityki, crawlera, typów stron, usterek technicznych oraz priorytetów biznesowych.

- Mapowanie intencji: przypisanie zapytań i tematów do konkretnych podstron oraz wyraźne rozdzielenie stron informacyjnych, usługowych, kategorii i transakcyjnych.

- Ocena architektury: weryfikacja struktury URL, nawigacji, linkowania wewnętrznego, paginacji, filtrów oraz głębokości, na jaką dociera robot.

- Naprawy techniczne: uporządkowanie indeksowalności, robots.txt, meta robots, sitemap, canonicali, przekierowań, błędów 4xx/5xx, wersji mobilnej i renderowania.

- Wdrożenia on-page i content: dopracowanie title, nagłówków, sekcji treści, semantyki, FAQ, danych strukturalnych oraz linków wewnętrznych.

- Monitoring i korekty: śledzenie zapytań, kliknięć, stron wejścia, błędów, zmian w indeksacji oraz reakcji użytkowników po wdrożeniu.

Po diagnozie trzeba rozstrzygnąć, które strony rozwijać, a które scalić, przepisać lub wyłączyć z indeksu. Ma to szczególne znaczenie w serwisach z duplikacją, starymi landing page’ami, filtrami i podobnymi podstronami usług. W White Hat SEO nie chodzi o mnożenie adresów, tylko o to, by każda istotna strona miała czytelny cel, własną rolę i była spójna z intencją wyszukiwania.

Potem przychodzi pora na warstwę techniczną, która nierzadko przesądza o tym, czy wyniki w ogóle się pokażą. Nawet dobre treści nie pomogą, jeśli serwis ma błędne canonicale, blokady indeksacji, słabe linkowanie wewnętrzne albo ciężki JavaScript utrudniający renderowanie. W praktyce najlepiej zaczynać od poprawek kluczowych dla crawlability i indeksacji, a dopiero w następnej kolejności przechodzić do optymalizacji jakościowej.

Kolejny krok obejmuje on-page i content, ale nie jako odseparowane obszary. Podstrona powinna mieć spójny tytuł, nagłówek, URL, treść główną, sekcje wspierające oraz linki wewnętrzne. Gdy temat jest rozległy, lepiej ułożyć go w klaster powiązanych stron niż próbować upchnąć całość pod jednym adresem. Taka konstrukcja ułatwia zrozumienie zagadnienia zarówno użytkownikowi, jak i wyszukiwarce.

Na finiszu wchodzi budowanie autorytetu oraz stałe mierzenie rezultatów. Bezpieczne linkowanie opiera się na jakości źródeł, materiałach nadających się do cytowania, relacjach branżowych i odzyskiwaniu utraconych wzmianek, zamiast na masowych publikacjach. Jeśli monitoring nie pokazuje, które wdrożenia przełożyły się na widoczność i zachowanie użytkowników, trudno oddzielić działania skuteczne od pracy wykonywanej dla samej aktywności. Dlatego White Hat SEO powinno działać w pętli: wdrożenie, pomiar, korekta priorytetów.

Jakie decyzje są kluczowe dla efektywności White Hat SEO?

O efektywności White Hat SEO przesądzają decyzje dotyczące priorytetów, doboru stron docelowych, kontroli indeksacji oraz jakości wdrożeń. To one rozstrzygają, czy budżet i czas napędzają wzrost, czy rozpraszają się na zadania o niewielkim wpływie. W praktyce kluczowe bywa szybkie oddzielenie problemów krytycznych od tych, które mogą poczekać.

Pierwsza istotna decyzja dotyczy tego, które adresy URL mają być widoczne w wyszukiwarce, a które powinny pozostać poza indeksem. Strony filtrów, wyniki wewnętrznej wyszukiwarki, techniczne warianty i duplikaty często pochłaniają budżet crawlowania i rozmywają sygnały jakości. Dobra kontrola indeksacji zwykle przynosi większy efekt niż dokładanie kolejnych słabych podstron.

Druga decyzja dotyczy mapowania intencji na strony. Jedna podstrona powinna odpowiadać na jeden główny typ potrzeby użytkownika, zamiast jednocześnie sprzedawać, edukować i pozycjonować się na kilka różnych tematów. Gdy kilka stron rywalizuje o ten sam zestaw zapytań, pojawia się kanibalizacja, a wyniki zaczynają się wahać.

Trzecia decyzja dotyczy tego, co odświeżać, a co usuwać lub scalać. W wielu serwisach szybszy wzrost daje uporządkowanie istniejących zasobów niż tworzenie nowych materiałów od zera. Dotyczy to szczególnie starych artykułów, opisów kategorii, stron usług oraz treści skopiowanych w obrębie serwisu. Usunięcie lub połączenie słabych stron bywa trafniejszym wyborem niż ich kosmetyczna optymalizacja.

Równie ważna jest decyzja organizacyjna: kto odpowiada za wdrożenia i w jakim terminie są dowożone. Nawet dobry audyt nie przełoży się na efekt, jeśli firma nie ma dostępu do CMS, dewelopera, właściciela backlogu i procesu akceptacji zmian. W SEO często wygrywa nie najlepsza strategia na papierze, lecz ta, którą da się wdrożyć szybko, poprawnie i bez tarć z innymi zespołami.

Osobną kategorię stanowią decyzje o linkach i sygnałach zewnętrznych. W White Hat SEO liczy się selekcja źródeł, sens publikacji oraz spójność z marką, a nie sama liczba odnośników. Zbyt agresywne anchory, schematy wymiany i publikacje na przypadkowych stronach mogą osłabić efekt całej pracy wykonanej w serwisie. Profil linków powinien wyglądać jak naturalny skutek wartościowej obecności marki, a nie jak osobny system manipulacji.

Na koniec warto rozstrzygnąć, w jaki sposób mierzyć postęp. Same pozycje to metryka zbyt wąska, bo nie oddaje jakości ruchu, stanu indeksacji, skuteczności stron wejścia ani konsekwencji zmian technicznych. Rozsądniej śledzić zestaw wskaźników: kliknięcia z organicu, liczbę i jakość zaindeksowanych stron, widoczność zapytań, zachowanie użytkowników na landing page’ach oraz tempo wdrażania poprawek. Taki pomiar pozwala ocenić nie tylko to, czy coś rośnie, lecz także skąd bierze się wzrost albo dlaczego dynamika zaczyna siadać.

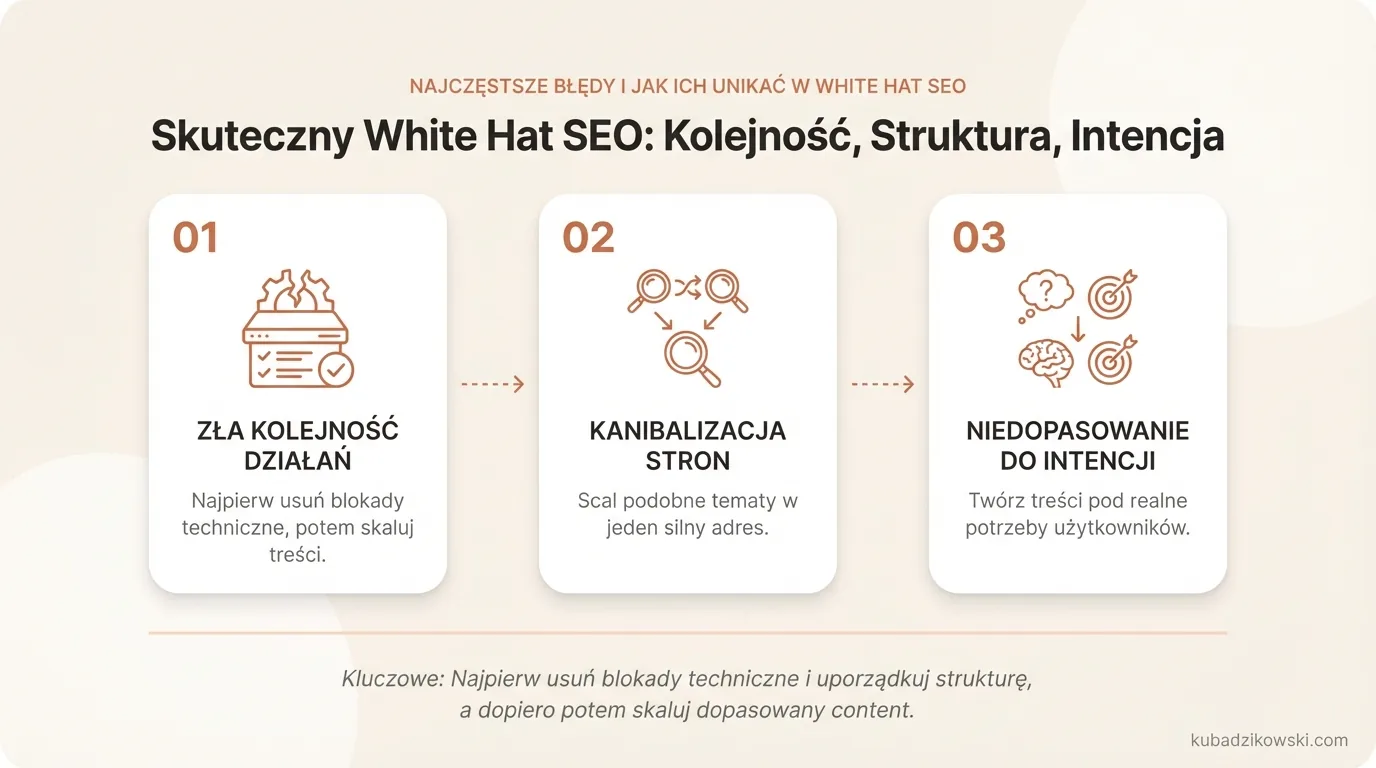

Najczęstsze błędy i jak ich unikać w White Hat SEO

Do najczęstszych błędów w White Hat SEO należą zła kolejność działań, nietrafione decyzje dotyczące indeksacji oraz publikowanie treści bez realnego dopasowania do intencji użytkownika. W praktyce wiele firm startuje od pisania nowych tekstów, mimo że serwis ma problemy z canonicalami, przekierowaniami, renderowaniem albo linkowaniem wewnętrznym. W takiej sytuacji nawet dobra treść nie pracuje tak, jak powinna. Najpierw usuwa się blokady techniczne i porządkuje strukturę, a dopiero potem skaluje content.

Bardzo częsty błąd to tworzenie kilku podstron na ten sam temat lub pod bardzo zbliżone zapytania. Kończy się to kanibalizacją, rozproszeniem linków wewnętrznych i nieczytelnym sygnałem dla wyszukiwarki, która strona ma być wyświetlana. Zamiast mnożyć podobne adresy, lepiej scalić temat w jedną mocną stronę albo jasno przypisać role poszczególnym podstronom.

Równie kosztowne bywa pomijanie kwestii indeksacji. Serwisy często indeksują filtry, wyniki wewnętrznej wyszukiwarki, warianty parametrów i inne strony techniczne, które nie mają wartości dla użytkownika z Google. Efekt jest prosty: budżet crawlowania się rozmywa, a kluczowe strony dostają mniej uwagi. Jeśli podstrona nie ma samodzielnej wartości w wynikach wyszukiwania, zwykle nie powinna być indeksowana.

Problemem bywa też przesadna optymalizacja on-page. Zbyt agresywne upychanie fraz w title, H1, anchorach i treści obniża czytelność i wygląda nienaturalnie. Zamiast „dopchać” słowo kluczowe w każdym elemencie, lepiej dopracować pełną odpowiedź na intencję, uporządkować nagłówki i zadbać o sensowne linkowanie wewnętrzne.

- Nie publikuj strony, dopóki nie masz jasności, na jaką intencję odpowiada i z jakimi innymi URL-ami może konkurować.

- Nie kopiuj opisów producenta, kategorii ani usług między sekcjami serwisu, ponieważ duplikacja osłabia trafność i utrudnia ranking właściwej strony.

- Nie traktuj schema jako zamiennika jakości treści. Dane strukturalne pomagają w interpretacji, ale nie naprawiają słabej strony.

- Nie buduj profilu linków przez masowe publikacje niskiej jakości i powtarzalne anchory, bo to daje mizerny efekt i zwiększa ryzyko problemów historycznych.

Osobną kategorię błędów stanowią zaniedbania po zmianach w biznesie. Oferta ewoluuje, część produktów znika, usługi są przebudowywane, a na stronie zostają stare materiały, które przestają pasować do aktualnego stanu serwisu. To odbija się na jakości wejścia, konwersji i zaufaniu. Treści SEO trzeba aktualizować po zmianach oferty, nie tylko po spadkach ruchu.

W White Hat SEO problemem bywa też brak właściciela procesu po stronie firmy. Kiedy nie ma osoby decyzyjnej, poprawki techniczne potrafią czekać tygodniami, briefy contentowe nie trafiają do wdrożenia, a priorytety przestawiają się bez wyraźnego powodu. W rezultacie projekt wygląda na „prowadzony”, ale w praktyce stoi w miejscu. Sprawdza się prosty schemat: backlog, odpowiedzialność, termin oraz kontrola wpływu wdrożenia.

Jak mierzyć i optymalizować efekty działań White Hat SEO?

Efekty działań White Hat SEO najlepiej oceniać, łącząc dane o widoczności, indeksacji, jakości stron wejścia oraz wyniku biznesowym. Sama pozycja frazy to za mało, bo nie mówi, czy serwis pozyskuje właściwy ruch i czy ten ruch realizuje cel. Najbardziej użyteczne jest zestawienie Google Search Console, analityki, crawlera i ręcznej oceny kluczowych landing pages. Najlepszy raport SEO odpowiada nie tylko na pytanie „czy rośnie ruch”, ale też „dlaczego rośnie albo nie rośnie”.

W Search Console warto obserwować kliknięcia, wyświetlenia, CTR oraz zapytania przypisane do konkretnych typów stron. Dzięki temu łatwiej rozdzielić problem treści od problemu ekspozycji w wynikach wyszukiwania. Jeżeli wyświetlenia rosną, a kliknięcia nie, zazwyczaj do poprawy są title, meta description, dopasowanie do intencji lub sam typ strony, który rankuje na dane zapytanie.

Analityka pokazuje, czy ruch organiczny trafia na właściwe podstrony i co robi użytkownik po wejściu. W e-commerce będą to zwykle przychody, transakcje oraz wspomagane ścieżki, a w usługach leady, połączenia, formularze lub inne mikro- i makrokonwersje. Ruch bez jakości wejścia i bez wyniku biznesowego nie jest celem, tylko sygnałem do dalszej analizy.

Crawler i audyt techniczny są potrzebne do mierzenia elementów, których sama analityka nie pokaże. Chodzi m.in. o statusy odpowiedzi, błędy 4xx i 5xx, redirect chains, nieprawidłowe canonicale, blokady w meta robots, osierocone strony, głębokość kliknięć czy kłopoty z renderowaniem JavaScript. Gdy widoczność stoi w miejscu mimo rozbudowy treści, bardzo często przyczyna leży właśnie tutaj.

- Monitoruj oddzielnie strony usługowe, kategorie, artykuły i strony transakcyjne, bo każdy typ ma inną rolę i inne KPI.

- Porównuj dane po wdrożeniu na poziomie konkretnego URL-a lub klastra, a nie wyłącznie całego serwisu.

- Sprawdzaj, które strony zdobywają nowe zapytania, a które tracą je po zmianach w treści, linkowaniu lub szablonie.

- Analizuj także strony, które mają dużo wyświetleń i niski CTR, bo tam często najszybciej widać efekt poprawek.

Optymalizacja efektów to proces oparty na regularnych iteracjach, a nie jednorazowym „ustawieniu SEO”. Gdy strona jest dobrze zaindeksowana, ale CTR pozostaje niski, skupiasz się na snippecie i lepszym dopasowaniu do intencji. Jeśli ruch jest, lecz konwersja kuleje, warto dopracować układ treści, wiarygodność oferty, linkowanie do kolejnego kroku oraz jakość samej strony docelowej.

W praktyce sprawdza się prosty cykl: obserwacja, hipoteza, wdrożenie, kontrola efektu. Taki schemat porządkuje działania i ogranicza chaos interpretacyjny, szczególnie gdy równolegle zmienia się oferta, serwis albo sezonowość. SEO najlepiej optymalizuje się wtedy, gdy każda większa zmiana ma właściciela, datę wdrożenia oraz jasno określony, mierzalny cel.