W SEO trudno o jedną, uniwersalną odpowiedź na pytanie, czy lepiej sprawdzają się treści dynamiczne, czy statyczne. Efekty zależą od rodzaju strony, źródła danych, intencji użytkownika oraz tego, jak serwis został zbudowany od strony technicznej. Strony usługowe, filarowe i sprzedażowe zazwyczaj wymagają innej strategii niż rozbudowane listingi, lokalizacje czy podstrony oparte na filtrach. Najlepsze rezultaty najczęściej przynosi nie trzymanie się jednego modelu w całej witrynie, lecz świadomy podział: co powinno pozostać stałe, a co można generować na bazie danych. To decyzja o dużej wadze, bo jednocześnie oddziałuje na indeksację, tempo i skalę publikacji, jakość materiałów oraz koszty utrzymania. W praktyce więc nie chodzi o sam format treści, tylko o dopasowanie modelu do roli konkretnej sekcji serwisu.

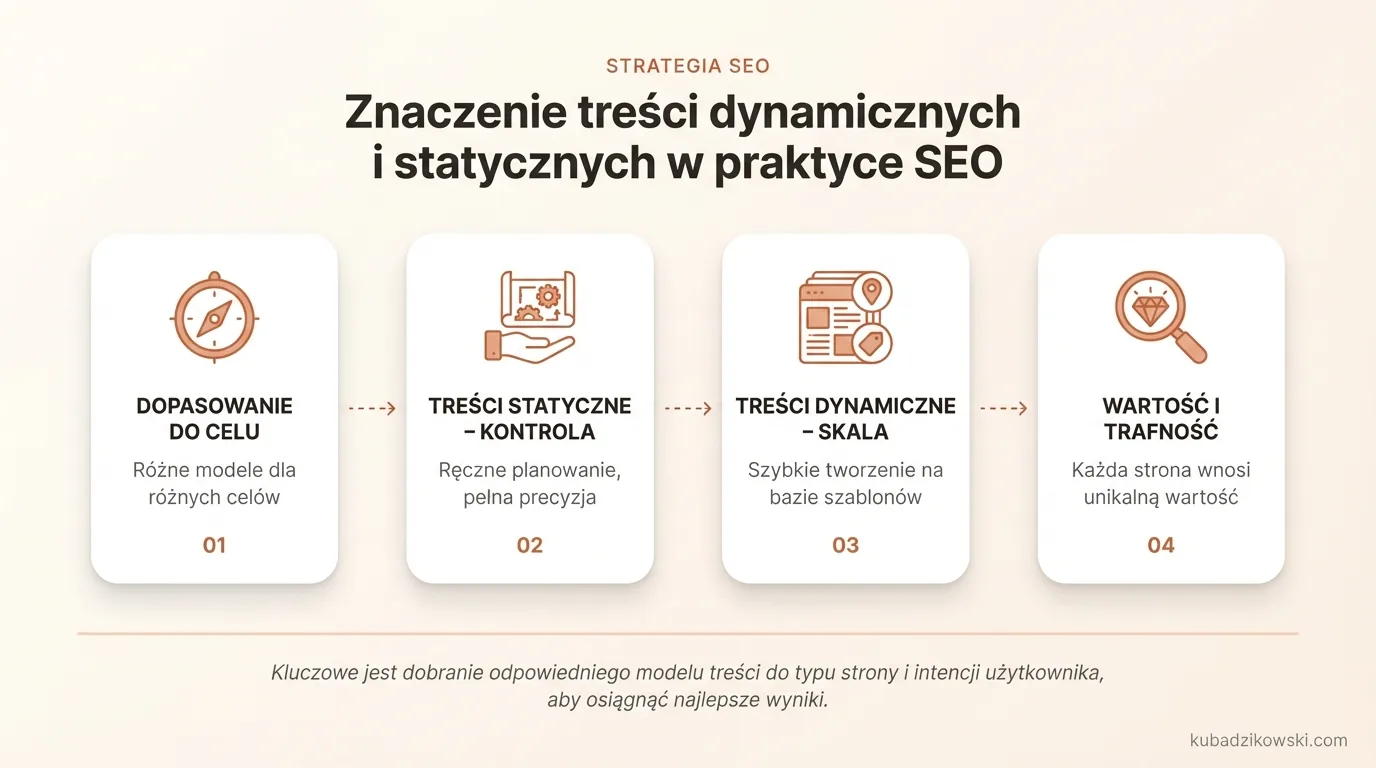

Znaczenie treści dynamicznych i statycznych w praktyce SEO

Rola treści dynamicznych i statycznych w SEO sprowadza się do tego, że każdy z tych modeli lepiej pasuje do innego typu strony i innego celu biznesowego. Treści statyczne są planowane i utrzymywane ręcznie, co daje pełną kontrolę nad przekazem, układem nagłówków, CTA oraz linkowaniem wewnętrznym. Najlepiej sprawdzają się tam, gdzie liczy się precyzja i przewidywalność, na przykład na stronach usług, kategoriach głównych, landing page’ach oraz w treściach evergreen.

Treści dynamiczne powstają na bazie szablonów i zmiennych danych, takich jak produkty, lokalizacje, ceny, dostępność, opinie czy parametry. Pozwala to szybko uruchamiać dużą liczbę podstron odpowiadających na bardziej szczegółowe zapytania. Takie podejście ma sens wtedy, gdy każda strona wnosi realnie odrębną wartość i trafia w konkretną intencję wyszukiwania, zamiast powielać ten sam układ z podmienioną jedną zmienną.

W praktyce wybór między tymi modelami przekłada się na kilka kluczowych obszarów. Treści statyczne zazwyczaj łatwiej utrzymać w ryzach jakościowo i prościej je dopracować pod konkretne frazy. Treści dynamiczne skuteczniej skalują widoczność przy dużych zbiorach danych, ale jednocześnie podnoszą ryzyko duplikacji, cienkich treści oraz problemów z indeksacją. Im więcej automatyzacji, tym większa potrzeba jasnych, twardych reguł jakości i indeksacji.

Dlatego w wielu serwisach najlepiej sprawdza się model hybrydowy. Rdzeń strony pozostaje statyczny, a wybrane moduły aktualizują się automatycznie, na przykład oferta, FAQ, opinie, stany magazynowe lub treści lokalne. Taki układ pozwala zachować kontrolę nad najważniejszą częścią strony, a jednocześnie korzystać ze skali i świeżości danych. Zwykle jest to bezpieczniejsze i bardziej efektywne niż próba oparcia całej witryny wyłącznie na jednym modelu.

Aktualne wyzwania i możliwości związane z dynamicznymi treściami

Dzisiejsze wyzwania związane z treściami dynamicznymi biorą się przede wszystkim z tego, że łatwo je skalować, ale równie łatwo obniżyć jakość SEO, jeśli wdrożenie odbywa się bez nadzoru. Największą zaletą jest szybkie pokrycie szerokiego spektrum zapytań, zwłaszcza w e-commerce, serwisach lokalnych, portalach ofertowych i rozbudowanych bazach danych. Schody zaczynają się w momencie, gdy system generuje podstrony bez dostatecznie unikalnej treści, bez sensownie zdefiniowanej intencji wyszukiwania albo bez realnej wartości dla użytkownika.

Jednym z kluczowych zagadnień technicznych pozostaje renderowanie. Wyszukiwarki potrafią przetwarzać JavaScript, jednak elementy krytyczne dla SEO najbezpieczniej podawać bezpośrednio w HTML po stronie serwera albo korzystać z prerenderingu. Dotyczy to w szczególności tytułu, meta danych, H1, głównej treści, linków wewnętrznych, canonicala i danych strukturalnych. Jeśli te elementy pojawiają się dopiero po opóźnionym wykonaniu JS, zwiększa się ryzyko problemów z indeksacją i spadku widoczności.

Kolejne poważne wyzwanie to nadprodukcja stron generowanych automatycznie. Filtry, tagi, parametry i kombinacje lokalizacji potrafią tworzyć tysiące adresów URL, z których znaczna część nie powinna trafiać do indeksu. Bez jasnych reguł łatwo o puste podstrony, duplikaty, niemal identyczne warianty i pułapki crawl budget. Z tego powodu dynamiczne sekcje muszą działać według precyzyjnych zasad: co indeksować, co kanonizować, a co zostawić wyłącznie do nawigacji.

Warto też mieć na uwadze, że sama świeżość treści nie daje przewagi z automatu. Strona aktualizowana codziennie nie wygra tylko dlatego, że częściej się zmienia, jeśli nadal słabo odpowiada na intencję użytkownika albo nie wnosi nic ponad to, co już widać w wynikach. O efekcie przesądzają przede wszystkim użyteczność strony, jakość danych wejściowych, unikalność treści oraz wewnętrzne linkowanie, które ułatwia odkrywanie tych podstron zarówno robotom, jak i użytkownikom.

Największy potencjał treści dynamicznych pojawia się wtedy, gdy opierają się na solidnych danych i mają przewidziane wyjątki redakcyjne. Szablon nie powinien być jedynie mechaniczną ramą, lecz systemem z obowiązkowymi polami, walidacją danych, opcją ręcznych nadpisań oraz monitorowaniem efektów po publikacji. Dopiero połączenie automatyzacji z kontrolą jakości sprawia, że dynamiczne treści realnie wspierają SEO, zamiast wprowadzać techniczny i indeksacyjny chaos.

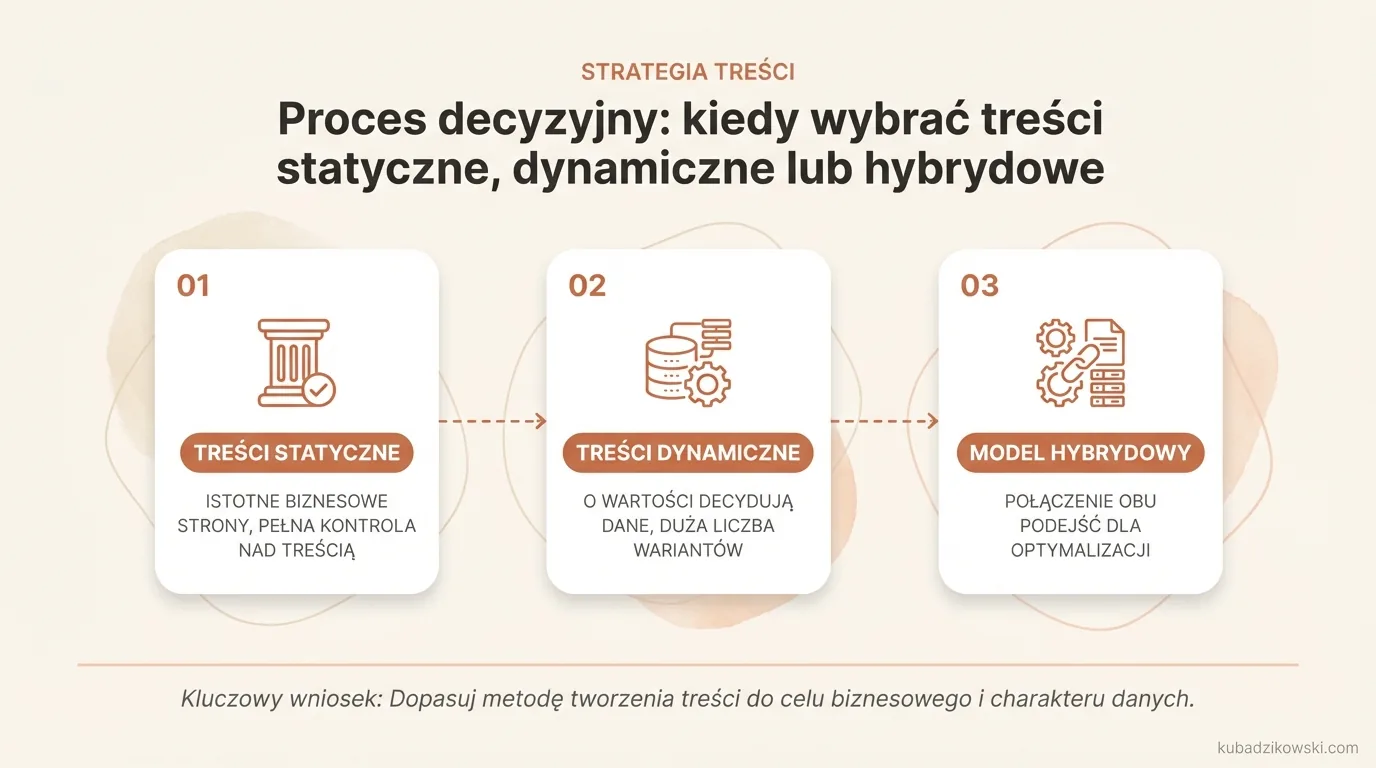

Proces decyzyjny: kiedy wybrać treści statyczne, dynamiczne lub hybrydowe

Treści statyczne wybieraj wtedy, gdy dana strona ma istotne znaczenie biznesowe, powinna precyzyjnie komunikować ofertę i wymaga pełnej kontroli nad treścią oraz linkowaniem. Najczęściej dotyczy to stron usług, głównych kategorii, landing page’y i treści filarowych. W takich obszarach liczy się spójność przekazu, wygodna edycja oraz przewidywalny rezultat po wdrożeniu zmian.

Po treści dynamiczne sięgaj wtedy, gdy o wartości strony decydują przede wszystkim dane, a nie ręcznie dopracowany opis. To trafne podejście dla ofert, lokalizacji, listingów, stron produktów, terminów, parametrów i innych sekcji, w których liczba wariantów jest duża albo zmienia się z czasem. Jeśli każda wygenerowana strona nie wnosi własnej wartości, lepiej jej nie publikować ani nie indeksować.

Model hybrydowy wybierz w sytuacji, gdy fundament strony ma pozostać niezmienny, ale część informacji powinna odświeżać się automatycznie. W praktyce oznacza to stały nagłówek, lead, sekcję ekspercką i kontrolowane linkowanie, a obok moduły z cenami, dostępnością, opiniami, FAQ czy danymi lokalnymi. To zwykle najbezpieczniejszy układ dla SEO, bo łączy kontrolę redakcyjną ze skalą.

Najlepszy wybór wynika z oceny trzech elementów: intencji wyszukiwania, zmienności danych i ryzyka technicznego. Gdy użytkownik oczekuje eksperckiego wyjaśnienia lub porównania, strona powinna pozostać w większości statyczna. Jeśli natomiast szuka konkretnej oferty, lokalizacji albo wariantu zależnego od danych, model dynamiczny będzie bardziej uzasadniony.

- Wybierz model statyczny, gdy priorytetem jest jakość komunikatu, konwersja i ręczna kontrola każdego elementu.

- Wybierz model dynamiczny, gdy dysponujesz dużym zbiorem uporządkowanych danych i istnieje realny popyt na wiele wariantów stron.

- Wybierz model hybrydowy, gdy chcesz jednocześnie skalować sekcję i zachować kontrolę nad kluczowym przekazem.

Przed podjęciem decyzji warto jeszcze zweryfikować, czy system potrafi poprawnie wygenerować HTML, obsłużyć canonicale, filtrowanie, noindex, sitemapy i linkowanie wewnętrzne. Sam fakt, że technicznie da się wytworzyć tysiące adresów, nie oznacza, że wszystkie powinny trafić do indeksu. W SEO wygrywa nie liczba stron, ale jakość stron, które robot i użytkownik naprawdę mają po co odwiedzić.

Jak wdrażać dynamiczne treści bez szkody dla SEO

Dynamiczne treści wdrażaj tak, by kluczowe elementy SEO były dostępne od razu w HTML i nie zależały od opóźnionego działania JavaScript. Dotyczy to przede wszystkim tytułu strony, H1, głównej treści, linków wewnętrznych, canonicala i danych strukturalnych. Jeżeli te elementy pojawiają się dopiero po renderowaniu po stronie przeglądarki, rośnie ryzyko problemów z indeksacją i niepełnego odczytu strony.

Szablon dynamiczny powinien opierać się na jasnych regułach jakości, a nie wyłącznie na polach do automatycznego uzupełniania. Trzeba zdefiniować, które dane są obowiązkowe, w jakich warunkach strona może zostać opublikowana oraz które sekcje można ręcznie nadpisać. Dobre wdrożenie nie polega na generowaniu wszystkiego, tylko na blokowaniu publikacji słabych wariantów.

Szczególną uwagę warto poświęcić indeksacji. Nie każda kombinacja filtrów, parametrów, miast czy tagów powinna lądować w Google. Na start dobrze jest ustalić minimalną „wartość” strony: czy odpowiada na odrębną intencję, czy wnosi unikalne dane i czy broni się biznesowo.

Bezpieczne wdrożenie wymaga także przemyślanego linkowania wewnętrznego. Strony dynamiczne często istnieją od strony technicznej, ale nie dostają wystarczająco wielu sensownych linków z innych sekcji serwisu. Jeśli ważna strona dynamiczna nie jest logicznie podlinkowana, robot może dotrzeć do niej późno albo uznać ją za mało istotną.

- Zadbaj o SSR, prerendering lub inne rozwiązanie, które podaje pełną treść w kodzie HTML.

- Ustal reguły publikacji: minimalna liczba danych, unikalne pola, brak pustych bloków, poprawne meta i H1.

- Określ zasady indeksacji dla filtrów, parametrów, paginacji i wariantów lokalnych.

- Dodaj możliwość ręcznych nadpisań w kluczowych sekcjach szablonu.

- Po wdrożeniu kontroluj render, pokrycie indeksacji, duplikację, logi i zmiany w Search Console.

Najczęstsze potknięcia zwykle się powtarzają: puste strony przy braku danych, niemal identyczne treści dla wielu miast, brak canonicali, noindex ustawiony zbyt szeroko albo wcale, a także publikacja bez testów renderowania. Równie ryzykowne bywa poleganie wyłącznie na świeżości danych. Aktualizowana cena czy liczba ofert nie podniesie widoczności, jeśli strona nadal pozostaje słaba, powtarzalna albo trudno dostępna dla robota.

W praktyce najlepiej sprawdza się proces, w którym współpracują SEO, development i content. Najpierw powstaje mapa typów stron oraz reguły szablonu, potem test na małej próbce, a dopiero później szersza publikacja. Przy dynamicznych treściach jakość kontroli po wdrożeniu jest równie ważna jak sam pomysł na skalowanie.

Najczęstsze błędy przy tworzeniu dynamicznych stron

Najczęstsze błędy przy tworzeniu dynamicznych stron to indeksowanie podstron bez realnej wartości, duplikowanie treści oraz uzależnianie kluczowych elementów SEO od źle obsługiwanego JavaScriptu. W praktyce kłopot nie wynika z samego „dynamicznego” modelu, tylko z tego, że szablon publikuje zbyt dużo, zbyt podobnie i bez spójnej kontroli jakości. Jeśli strona nie ma własnej intencji, własnych danych i własnego sensu biznesowego, nie powinna trafiać do indeksu.

Bardzo częstym błędem jest generowanie stron dla wszystkich kombinacji filtrów, parametrów, lokalizacji lub tagów. Taka sekcja szybko produkuje thin content, strony puste po wyczerpaniu oferty albo warianty różniące się wyłącznie jednym słowem w tytule. W efekcie spadają pozycje, marnuje się crawl budgetu i rośnie bałagan w raportach indeksacji.

Drugi częsty problem to zbyt cienka warstwa unikalności. Sam szablon z podmienioną nazwą miasta, kategorii albo cechy produktu zwykle nie wystarczy, jeśli pozostała część treści pozostaje taka sama. Dynamiczna strona powinna bazować na unikalnych polach danych, a nie tylko na automatycznej podmianie kilku słów.

Kolejny błąd wynika ze sposobu wdrożenia. Jeżeli title, H1, główna treść, linki wewnętrzne lub canonical pojawiają się dopiero po stronie klienta i z opóźnieniem, robot może zobaczyć wersję niekompletną albo zaindeksować stronę w gorszym wariancie. Z tego powodu kluczowe elementy SEO bezpieczniej podać w HTML po stronie serwera albo dostarczyć je przez poprawnie przygotowany prerendering.

- brak reguł canonical i noindex dla filtrów, paginacji i wariantów technicznych,

- publikacja pustych stron przy braku danych lub oferty,

- powielanie treści między miastami, kategoriami lub tagami,

- brak linkowania wewnętrznego do stron dynamicznych, przez co są formalnie opublikowane, ale praktycznie odcięte,

- brak ręcznych nadpisań dla najważniejszych stron szablonowych,

- wdrożenie bez testów renderowania, indeksacji i kontroli jakości danych wejściowych.

Osobny błąd to mylenie skali z jakością. Wygenerowanie tysięcy adresów URL nie oznacza jeszcze, że serwis lepiej odpowiada na popyt, jeśli większość tych stron nie wnosi nic nowego. Lepiej mieć mniej stron, za to z wyraźnie odrębną wartością i sensownym linkowaniem, niż rozdmuchać indeks słabymi wariantami.

Jak mierzyć i monitorować efektywność treści dynamicznych

Efektywność treści dynamicznych ocenia się przez jakość indeksacji, widoczność organiczną, ruch na grupach szablonów oraz realny wkład w cele biznesowe. Największy sens ma porównywanie całych typów stron, zamiast oceniania pojedynczych URL-i w oderwaniu od szablonu. W praktyce sprawdzasz nie tylko, czy strony się wyświetlają, ale też czy do indeksu trafiają właściwe wersje i czy odpowiadają na właściwe zapytania.

Pierwszy poziom to indeksacja. Weryfikujesz, ile stron zostało opublikowanych, ile jest dostępnych dla robotów, ile weszło do indeksu oraz które grupy są odrzucane albo zaczynają kanibalizować się między sobą. Duża liczba wygenerowanych stron nic nie znaczy, jeśli do indeksu trafiają głównie słabe warianty, a wartościowe URL-e są pomijane.

Drugi poziom to widoczność i dopasowanie do intencji. W Search Console warto monitorować kliknięcia, wyświetlenia, średnią pozycję oraz zapytania dla konkretnych katalogów, szablonów lub klas stron, na przykład /miasto/, /oferta/, /filtr/. Jeżeli dynamiczna sekcja zbiera wyświetlenia na zapytania niezgodne z celem strony, zwykle wskazuje to na problem z treścią, nagłówkami, tytułami albo logiką generowania.

Trzeci poziom to kontrola jakości technicznej po renderowaniu. Warto cyklicznie weryfikować, czy w HTML faktycznie pojawiają się title, H1, główna treść, linki wewnętrzne, dane strukturalne, canonical oraz czy po błędach danych nie zostają puste bloki. Ma to szczególne znaczenie po zmianach w szablonie, feedzie produktowym, logice filtrów albo frameworku frontendowym.

- pokrycie indeksacji: liczba URL-i opublikowanych, zindeksowanych i wykluczonych,

- widoczność per typ strony: kliknięcia, wyświetlenia, CTR i pozycje dla katalogów lub szablonów,

- jakość wejść: czy landing pages odpowiadają właściwym zapytaniom i intencjom,

- sygnały techniczne: błędy renderowania, statusy HTTP, duplikacja tytułów, canonicale,

- dane z logów lub crawl stats: czy robot nie traci zasobów na strony śmieciowe,

- wynik biznesowy: leady, sprzedaż, przejścia do kluczowych akcji z ruchu organicznego.

Dużo daje zestawienie grup stron przed i po wdrożeniu albo test A/B na poziomie szablonu, o ile architektura serwisu to umożliwia. Dzięki temu można ocenić, czy nowa logika generowania poprawiła indeksację, snippet i wejścia, czy jedynie podbiła liczbę adresów URL. Ocena skuteczności powinna dotyczyć całego systemu stron dynamicznych, nie pojedynczych „sukcesów”, które mogą być przypadkowe.

Na końcu powiąż SEO z celami biznesowymi. Jeżeli dynamiczne strony przyciągają ruch, ale nie wspierają sprzedaży, leadów ani przejścia do kolejnego kroku, najczęściej oznacza to, że obejmują niewłaściwy typ zapytań albo strona nie dostarcza wartości po wejściu. Dobra sekcja dynamiczna nie tylko rankuje, ale też prowadzi użytkownika do konkretnego działania dzięki lepiej dopasowanej treści i strukturze.

Strategie optymalizacji treści hybrydowych dla lepszych wyników SEO

Strategia optymalizacji treści hybrydowych polega na łączeniu stałego, ręcznie kontrolowanego rdzenia strony z dynamicznymi modułami opartymi na danych. Taki model sprawdza się, gdy jedna strona ma odpowiadać na trwałą intencję wyszukiwania, a jednocześnie musi prezentować elementy zmienne, takie jak lokalizacje, oferty, dostępność, opinie czy FAQ. W praktyce zapewnia to większą kontrolę jakości niż pełna automatyzacja oraz lepszą skalowalność niż całkowicie ręczne tworzenie każdej podstrony. Najważniejsze jest to, żeby użytkownik i robot widzieli na stronie jednocześnie stabilny sens strony i realnie aktualne dane.

Najpierw należy oddzielić elementy, które powinny pozostać stałe, od tych, które mogą aktualizować się automatycznie. Do warstwy statycznej zwykle zalicza się główny temat strony, H1, lead, kluczowe akapity, strukturę nagłówków, podstawowe CTA oraz główne linkowanie wewnętrzne. Do warstwy dynamicznej najczęściej trafiają moduły ofertowe, sekcje lokalne, ceny, terminy, stany magazynowe, opinie, odpowiedzi FAQ i bloki „powiązane”.

Taki podział bezpośrednio przekłada się na SEO, ponieważ wyszukiwarka łatwiej interpretuje stronę, gdy jej główny komunikat nie „pływa” po każdej aktualizacji danych. Gdy rdzeń jest zbyt mocno oparty na automatyce, szybko pojawia się rozjazd między tytułem, nagłówkiem a treścią. W modelu hybrydowym warstwa odpowiadająca za intencję wyszukiwania powinna być przewidywalna i stale obecna w HTML.

Kluczowe elementy SEO najlepiej dostarczać po stronie serwera albo poprzez bezpieczny prerendering. Dotyczy to w szczególności title, meta opisu, H1, głównej treści, canonicala, danych strukturalnych oraz istotnych linków wewnętrznych. Moduły dynamiczne mogą być później odświeżane na podstawie danych, ale nie powinny pozostawać jedynym nośnikiem znaczenia strony.

Dobry szablon hybrydowy potrzebuje reguł jakości, a nie wyłącznie „slotu” na dane. Warto określić pola obowiązkowe, minimalny próg unikalnych informacji, logikę bloków warunkowych oraz sytuacje, w których strony nie należy publikować lub indeksować. Jeżeli dynamiczny moduł sprowadza się wyłącznie do podmiany miasta, ceny albo jednego parametru, taka podstrona najczęściej nie wnosi realnej wartości SEO.

- stały wstęp wyjaśniający temat strony i jej zakres,

- ręcznie przygotowany blok ekspercki lub sprzedażowy,

- dynamiczna sekcja danych aktualnych dla użytkownika,

- warunkowe FAQ lub moduł odpowiedzi oparty na realnych różnicach,

- linki do stron nadrzędnych i powiązanych wariantów.

W treściach hybrydowych istotne jest ręczne nadpisywanie wybranych elementów. Nie każdą stronę trzeba pisać od zera, ale kluczowe podstrony powinny dawać możliwość indywidualnej edycji leadu, akapitów kontekstowych, FAQ czy sekcji lokalnej. To właśnie opcja nadpisania automatyki na stronach o największym potencjale najczęściej odróżnia dobry model hybrydowy od przeciętnego.

Linkowanie wewnętrzne powinno spinać część statyczną z dynamiczną w obu kierunkach. Strony filarowe i główne kategorie powinny przekazywać kontekst oraz autorytet do stron generowanych z danych, a strony dynamiczne powinny prowadzić do nadrzędnych hubów tematycznych. Dzięki temu robot łatwiej odczytuje zależności między podstronami, a użytkownik nie trafia w ślepą uliczkę.

Osobnej kontroli wymaga indeksacja. Nie każda kombinacja filtra, lokalizacji i wariantu powinna być dostępna dla Google, nawet jeśli technicznie da się ją wygenerować. Do indeksu warto wpuszczać tylko te strony hybrydowe, które mają własną intencję, własny zestaw danych i wystarczającą treść, by broniły się jako samodzielne wyniki.

W praktyce oznacza to konieczność jasnych reguł: które adresy dostają self-canonical, które są kanonizowane do wersji nadrzędnej, a które zostają wyłącznie na potrzeby nawigacji. Bez takiej kontroli model hybrydowy szybko zaczyna produkować duplikaty oraz strony zbyt podobne do siebie. Sam fakt, że treść jest częściowo dynamiczna, nie stanowi jeszcze argumentu za indeksacją.

Na finiszu pozostaje monitoring efektów po wdrożeniu. Warto weryfikować, czy dynamiczne moduły rzeczywiście trafiają do renderowanego HTML, czy snippet jest spójny z tematyką strony, czy zwiększa się pokrycie sensownych zapytań oraz czy nie dochodzi do kanibalizacji między wariantami. Najlepsze rezultaty przynosi model hybrydowy, w którym automatyzacja zapewnia skalę, a kontrola redakcyjna konsekwentnie dba o jakość i sens biznesowy każdej indeksowanej strony.